秒级出片的 AI 视频来了!我用它做出最魔性的 Labubu,不会写提示词的小白也秒上手

![]()

今年几乎天天都能看到各路 AI 视频大神刷屏,什么奥特曼对波马斯克,雪王大战东方明珠,切金属切玻璃 ASMR……看得人心痒痒。

![]()

但真轮到自己上手,你就会发现,这玩意儿纯属「开盲盒」,而且是成本巨高的那种。排队几小时是家常便饭,积分烧得比纸快,结果出来的视频要么人物畸变、画风诡异,要么干脆就把你的提示词当成耳旁风。

面对「AI 视频刺客」,还真有「卷王」站了出来。

去年靠「毒液特效」出圈的 PixVerse,今天悄咪咪地放了个大招——PixVerse V5。

他们这次号称搞了一套「准实时生成」的狠活,全面优化了动态、清晰度、一致性和指令理解能力。

![]()

▲ PixVerse 国内版首页

PixVerse V5 这次不光是小修小补,他们直接端出了三个硬菜:

1. 快速生成

这一直是 pixVerse 最大亮点, 他们通过极致的技术蒸馏,把视频生成压缩到了「秒级」。5秒钟出一段360p短片,1 分钟搞定 1080p高清视频。

2. 更少 AI 味儿

V5 通过扩展美学数据和人类偏好拟合(RLHF),让模型更懂「好看」和「真实」。无论是复杂的人物运动,还是光影的真实感,都大幅提升,生成效果更接近真实拍摄。

3. 指哪打哪

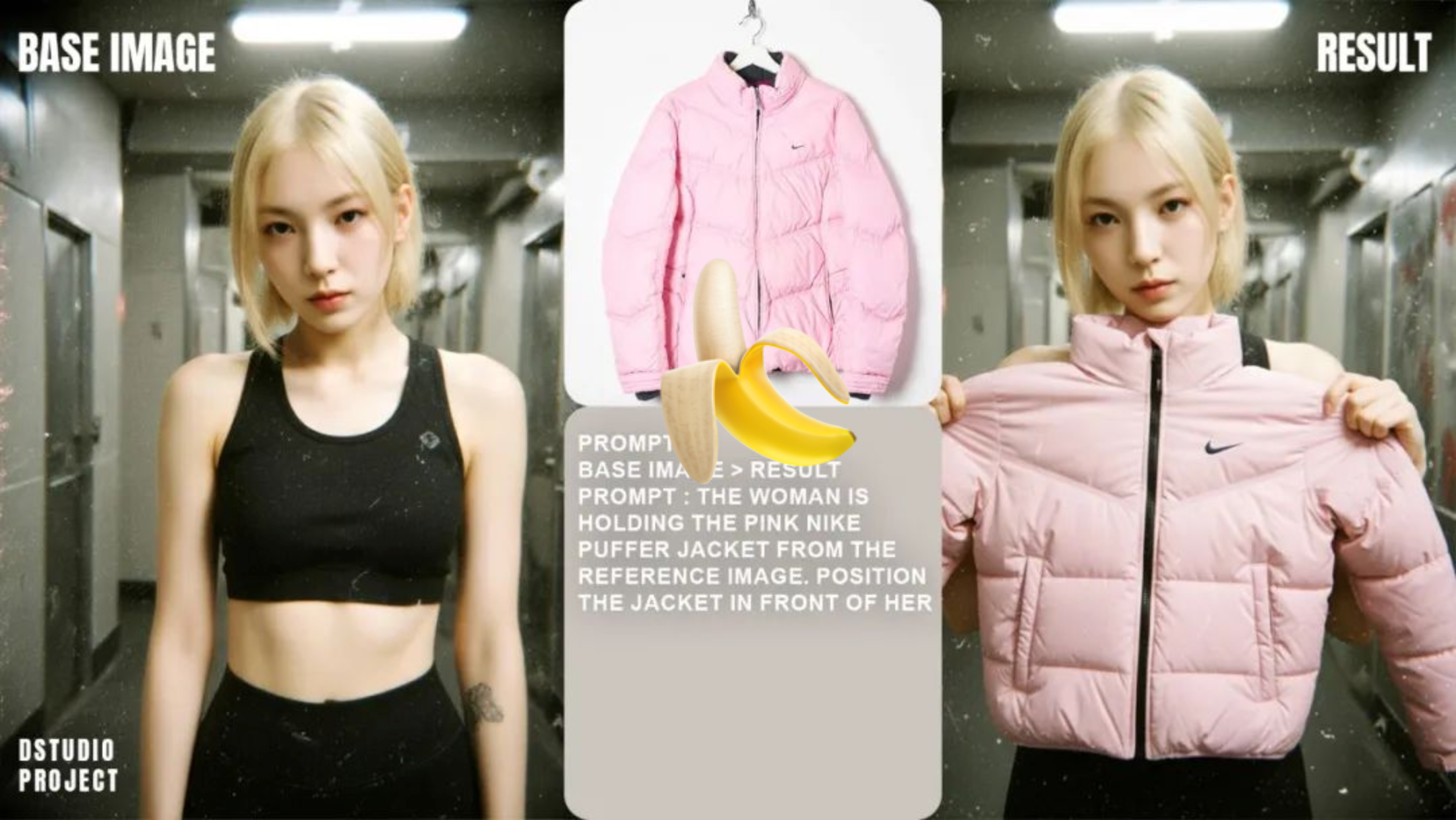

最让人头疼的「AI听不懂人话」问题,他们用「统一特征空间」技术来解决。简单说,就是不管你喂给它的是一句话、一张图,还是一段参考视频,它都能更准确地理解你的意图,实现图、文、视频多模态的复杂创意,让你真正做到精准控制。

话是这么说,是不是吹牛还得拉出来遛遛。我第一时间搞到了内测资格,替大家给它上上强度。

快到离谱,价格感人

快,是 V5 给我的第一印象。

实测下来,一段 8 秒带声音的 360p 视频,从排队到生成完毕,基本都在 30 秒以内,包含排队时间和生成时间;而 1080p 的超高清视频,所需要的时间会长一点,但是基本上也在 2 分钟左右。

![]()

▲ 拿可灵生成视频来对比下,排队的时间是 3 个小时

除了快到离谱,V5 也便宜到感人。每天登录就送 60 积分(生成一段 5 秒 360p 无声视频仅需 20 积分),会员选项也很多,让「抽卡」的成本大大降低。

作为对比,可灵是每个月提供 166 积分,生成一段 5s 标准模式的视频也是 20 积分。目前可灵添加音效是限免,PixVerse 需要再加 10 积分。

时间和金钱这两大核心痛点,PixVerse V5 算是给出了一个相当漂亮的解决方案。 那么,最重要的质量如何?

强度实测:从「开盲盒」到「半开卷考试」

我们直接上硬菜,用几个热门案例来测试它的真实水平。

先来个简单的,生成广州塔的航拍镜头。

![]()

▲ 提示词:电影般的航拍无人机镜头,聚焦广州塔。使用柯达 35 毫米胶片拍摄,带有胶片颗粒感。动态航拍镜头,摄像机环绕移动。保留参考图像的构图、框架和结构细节。

PixVerse 做的确实很好,而且速度还快。此外,不像 Veo 3 目前还是只能生成 16:9 的视频,PixVerse 则可以根据上传的图片自动适应生成视频的比例。

接下来,上点难度,测试它的人物一致性和场景理解能力。

最近 nano-banana 非常火,我们前几天用它生成了非常多有意思的照片,社交媒体上也很多人用它来实现一个完整的故事,凭借着它强大的人物、环境、照片风格内容等一致性保持。

我们找了几组有意思的照片,看看 PixVerse V5 是否有能力可以生成一个视频。

首先是这两个打台球的女生,他们先是站在前面自拍,然后我想让他们走到后面,拿着台球杆开始玩。

![]()

结果有点意外。 场景保持得很好,走路动作和表情也到位。但……它莫名其妙给我多塞了一个路人女孩进来!

看来在理解复杂的双人交互和空间关系上,AI 还是会犯迷糊。不过对比 V4.5(之前会生成一些意义不明的慢镜头),V5 至少更懂「走路」这个意图了。

还有最近非常火的用 nano banana 来做手办图片,有了图片之后,我们又可以生成非常多有意思的视频。

![]()

▲ 提示词:将这张照片制作成一个角色模型。其后放置一个印有该角色图像的盒子,以及一台屏幕显示Blender建模过程的电脑。在盒子前方添加一个圆形塑料底座,角色模型站立在上面。使PVC材质看起来透明,并尽可能设置为室内场景。

我们先用 nano banana 制作了一个像是自己 3D 打印出来的 labubu,接着把这张图片丢给 PixVerse。

![]()

▲ 提示词:棕色的实体手办开始在桌面上探险,它左边走走,右边看看,最后跳回到了原来它旁边的盒子里面;盒子上的 labubu 不要动,保持静态的;电脑上显示的 3d 手办动画处于预览的状态,自动的旋转播放。

还有最近非常火,以假乱真的 AI 夜视镜头视频,我们也用 PixVerse 检验了一下。不得不说,这个效果很真实,小猫趴在熊背上,小心翼翼地跳来跳去,和熊的接触、跳跃的动作,都像是真的。

![]()

如果是处理这种简单的动作还不够上难度,我们直接给他一张滑板的脚步特写,让他完成这些复杂的滑板动作。

![]()

PixVerse V5 也能精准地生成脚部动作,并且不出现差错。 我们用 V4.5 试了一下,有时候是会出现鞋子反穿,还有一些很搞笑的是,看起来滑板很烫,不知道怎么下脚的奇怪动作。

可以说,PixVerse 确实在生成质量上有了很多方面的提升。整体感觉是,V5 版本在一致性和写实感上的提升非常明显,看起来更像真实拍摄,而不是带着浓重 AI 味的画面。

One More Thing,还有 Agent 创作助手

除了图生视频,PixVerse V5 还提供了续写、多主体、Agent 智能体等一堆花哨但实用的功能。

我最喜欢的是「续写」。目前大部分 AI 视频一次只能生成几秒,想做长视频就得手动截取最后一帧再生成,非常繁琐。

而续写功能可以相对丝滑地延长视频,支持 30s 内长度的视频,我用它做了个「猫猫做梦当大厨」的短片,效果很萌。

![]()

看这小猫最后满足的笑容!

而为了解决「不会写提示词」这个终极难题,V5 还上线了 Agent 智能体。这玩意儿就像个创意模板库,你只需要找到喜欢的模板,填入关键词,它就能自动完成意图理解、脚本生成、视频生成等一系列流程。

![]()

目前在 PixVerse 的智能体里面,提供了超过十个的项目。有前段时间很火的兔子蹦床、给角色或物体更换材质、结合多个物体生成一个新物种、甚至还有给宠物穿上蟑螂套装跳芭蕾这样的智能体。

我就把之前我们用的那张 Labubu 的照片上传给它,智能体的流程和模板还是不太一样,模板只是单纯的套用一套提示词,而 PixVerse 的智能体就像我们用 ChatGPT agent 一样,自动化全部的操作,像是省去了我们先去 nano banana 里面生成图片的流程。

![]()

虽然它偶尔也会犯傻,比如把我的 Labubu 手办识别成「穿着棕色蟑螂服装的形象」(我对不起 Labubu!)

但这跳得还不错的芭蕾舞,确实展示了 Agent 功能的潜力——大大降低了普通人的创意实现门槛。

![]()

目前,PixVerse V5 和 Agent 创作助手已经在国际版 PixVerse(https://app.pixverse.ai/)与国内版拍我 AI(https://pai.video/)的网页端、App 及开放平台 API 全面上线。

AI 视频,终于从「豪赌」变成了「刮刮乐」

综合体验下来,PixVerse V5 的这次更新可以清晰地总结为两个词:更快、更好。

它或许还不是最完美的视频模型,处理复杂的多人交互时依然会犯迷糊。但这让我想起了豆包生图,质量可能不如 Midjourney,但它免费、量大、管饱,你可以随便试。

![]()

▲ 豆包一次性能生成 20 张图

PixVerse V5 走的也是这条路。它用「准实时」的生成速度和极低的试错成本,彻底改变了创作的心态。

过去,花几小时排队,烧掉大把积分,最后开出一个不满意的「盲盒」,那种感觉是痛苦和沮丧的。现在,几十秒就能看到结果,不满意就立刻重来,这种体验更像是「刮刮乐」——轻松、高频,且总期待着下一张能中奖。

从这个角度看,PixVerse V5 的核心竞争力,或许不是生成了多么惊艳的视频,而是在于提供了一种无负担、高频率的创作体验。

当开盲盒的成本变得足够低,当 AI 的不稳定不再让你心疼时间和金钱时,AI视频创作,才算真正从少数大咖的神坛,走到了我们每个人的日常里。

文|李超凡、张子豪

原文链接:https://mp.weixin.qq.com/s/Q0_1JM-2tJa9VyMP0LYUBQ

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。