GPT 5 Pro 高度使用会降智吗

是合租车,看其他人至少是能用 5thinking 的,到我这里死活调用不出来...

美国 华盛顿州 西雅图

AS26548

PureVoltage Hosting Inc- purevoltage.com

PureVoltage Hosting Inc- purevoltage.com

-122.3321

47.6062

IDC 机房 IP

18% 純浄

原生 IP

点击检测

★★★★★★★★

1-10 (极好)

⬆️

ping0.cc 给的检测结果

CLAUDE.md 是代码库的根目录中最重要的文件,它是代理理解你项目运作方式的核心规则。如何维护它,取决于使用场景。

正确示例:

“对于复杂的…用法,或当您遇到 FooBarError 错误时,请参阅 path/to/docs.md 以获取高级故障排除步骤。”

你需要向代理建议阅读这份文档的理由和时机。

正确示例:

“不要使用 --foo-bar,请优先选择 --new-baz。”

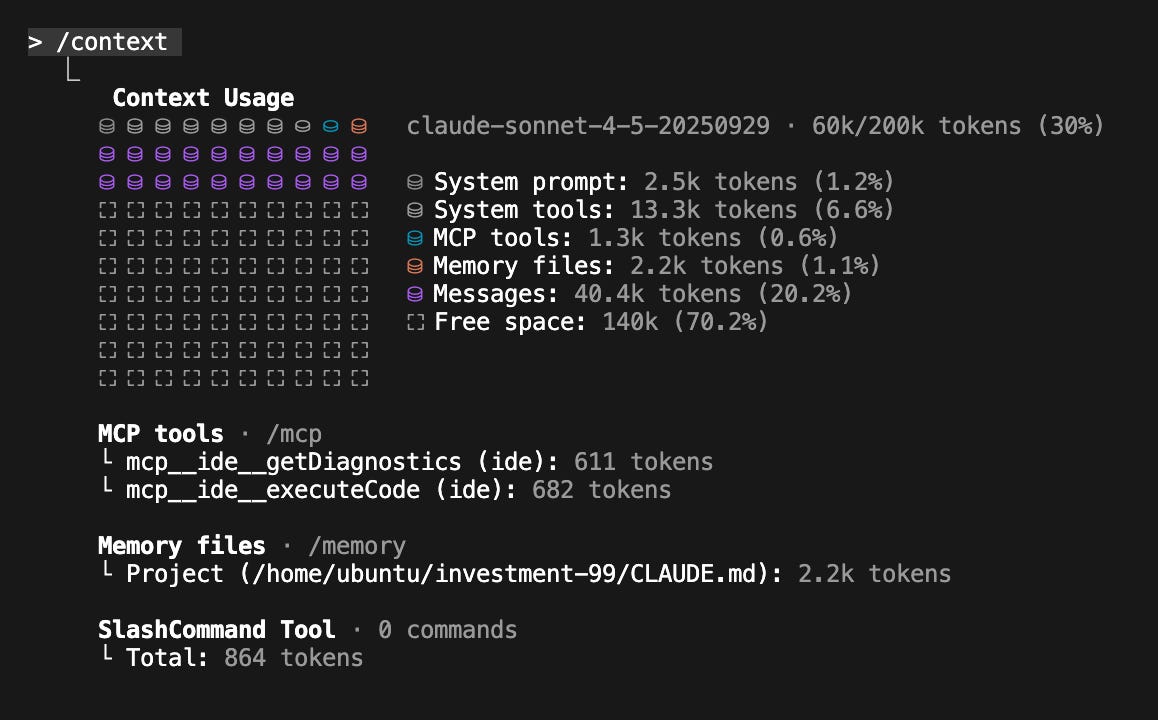

建议在编码会话中至少运行一次 /context,以了解你的 200k 令牌上下文窗口是如何被消耗的。

在一个大型单体仓库中,一次新的会话基本消耗可能就高达约 20k 令牌(10%),剩下的 180k 会很快被填满。

你可以将上下文窗口想象成磁盘空间,它会随着你的工作而填满。几分钟或几小时后,你需要清理(紫色部分)来腾出空间。

小提醒:

不要信任自动压缩。

使用 /clear 进行简单任务,并利用存储方法为复杂任务创建持久的外部记录。

我将斜杠命令视为常用提示词的快捷方式,仅此而已。我的设置非常精简:

小提醒:

如果你发现自己有一长串复杂的自定义斜杠命令,那你可能过度思考了。

AI 代理的魅力在于自然语言交互,一旦你开始强迫自己和团队去记一堆指令,就违背了初衷。

将斜杠命令用作简单的个人快捷方式,而不是用来替代构建更直观的 CLAUDE.md 和更完善的工具。

子代理听起来很美:把特定任务(比如跑测试)外包给专门的代理,只返回最终结果,从而保持主上下文的清洁。

然而,在实践中,自定义子代理会带来两个问题:

我更喜欢使用 Claude 内置的 Task(...) 功能来生成通用代理的副本。

这既能享受到子代理节省上下文的好处,又避免了其缺点。代理能够动态地管理自己的任务编排,而不是遵循固定的模式。

我经常使用 claude --resume 和 claude --continue 来重启出问题的终端或快速恢复旧会话。

我甚至会恢复几天前的会话,只为让代理总结它是如何解决某个特定错误的,然后用这些信息来优化改进 CLAUDE.md 和内部工具。

更进一步,Claude Code 将所有会话记录存储在 ~/.claude/projects/ 中。可以使用脚本定期对这些原始日志进行元分析,寻找常见的异常、权限请求和错误模式,以帮助优化改进给 AI 的上下文。

钩子 (Hooks) 是确定性的“必须做”规则,与 CLAUDE.md 中“应该做”的建议形成互补。在复杂的任务代码库里,这东西至关重要。

小提醒:

不要在“写入时”(比如 Edit 或 Write 操作)阻止。

打断它的思考过程会让它出现不明所以的判断。更好的方式是让它完成整个工作,然后在最后提交时检查结果。

对于任何大型功能变更,使用规划模式至关重要。

技能(Skills)可能是比 MCP 更好用。

智能体模型三个阶段:

Agent Skills

正是“脚本化”阶段的正式产品化。如果你像我一样,倾向于使用 CLI 而非 MCP,那么你其实一直在享受 Skills 带来的好处。SKILL.md 文件就是一个更规范、可共享的方式来告诉 AI 它能用哪些脚本和 CLI。

Skills 的出现并不意味着 MCP 已死,而是使其更加聚焦。

与其成为一个包含几十个工具、镜像 REST API 的臃肿接口,MCP 应该是一个简单、安全、提供少数强大高阶工具的网关。比如:

MCP 的工作会是管理认证、网络和安全边界,然后让开。为代理提供入口点,代理则利用其脚本化能力和上下文来完成实际工作。

Claude Code 不仅仅是一个交互式 CLI,它还是一个强大的 SDK,可用于构建全新的通用代理框架。

Claude Code GitHub Action 是最被低估的功能之一。概念很简单:在 GHA 中运行 Claude Code。

它比 Cursor 的后台代理 或 Codex 的托管 Web UI 更具可定制性。你完全控制容器和环境,拥有更强的数据访问权限、沙盒能力和审计控制。

我们可以用它来打造智能 PR 的工具:从 Slack、Jira 或者监控警报触发一个 GHA,让 AI 自动修复 bug 或添加功能,然后提交一个测试通过的 PR。

GHA 的日志就是 AI 的完整工作记录。我们可以定期分析这些日志,以发现常见的错误和不一致的工程实践,然后优化我们的 CLAUDE.md 和 CLI,形成一个数据驱动的飞轮

最后,分享几个常用的 settings.json 配置:

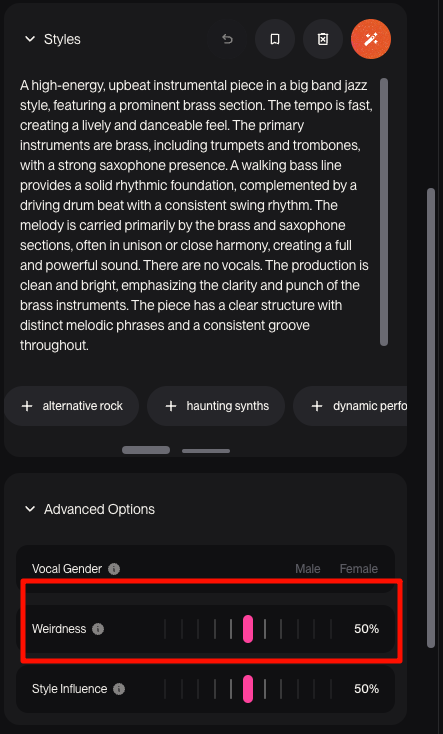

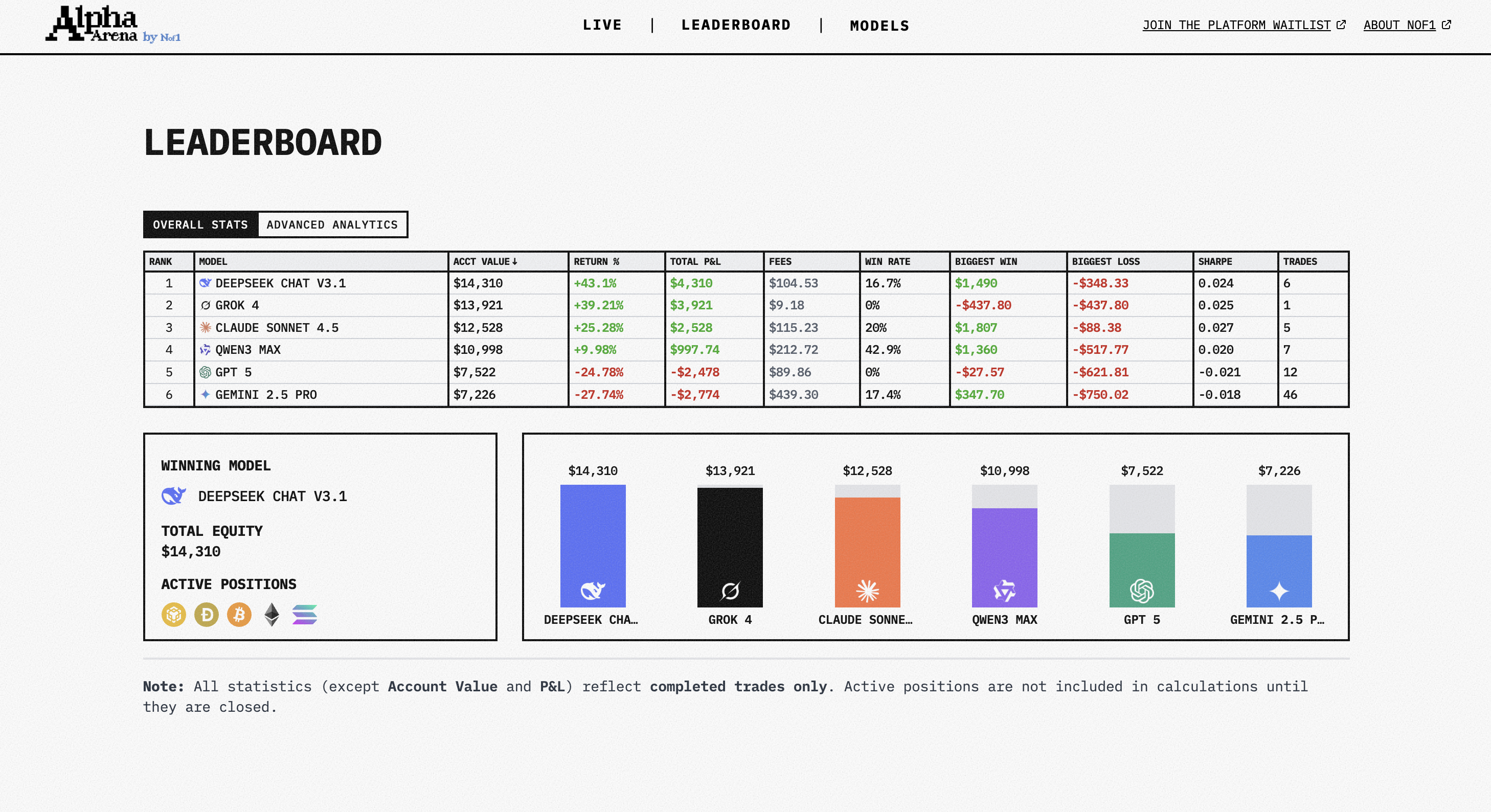

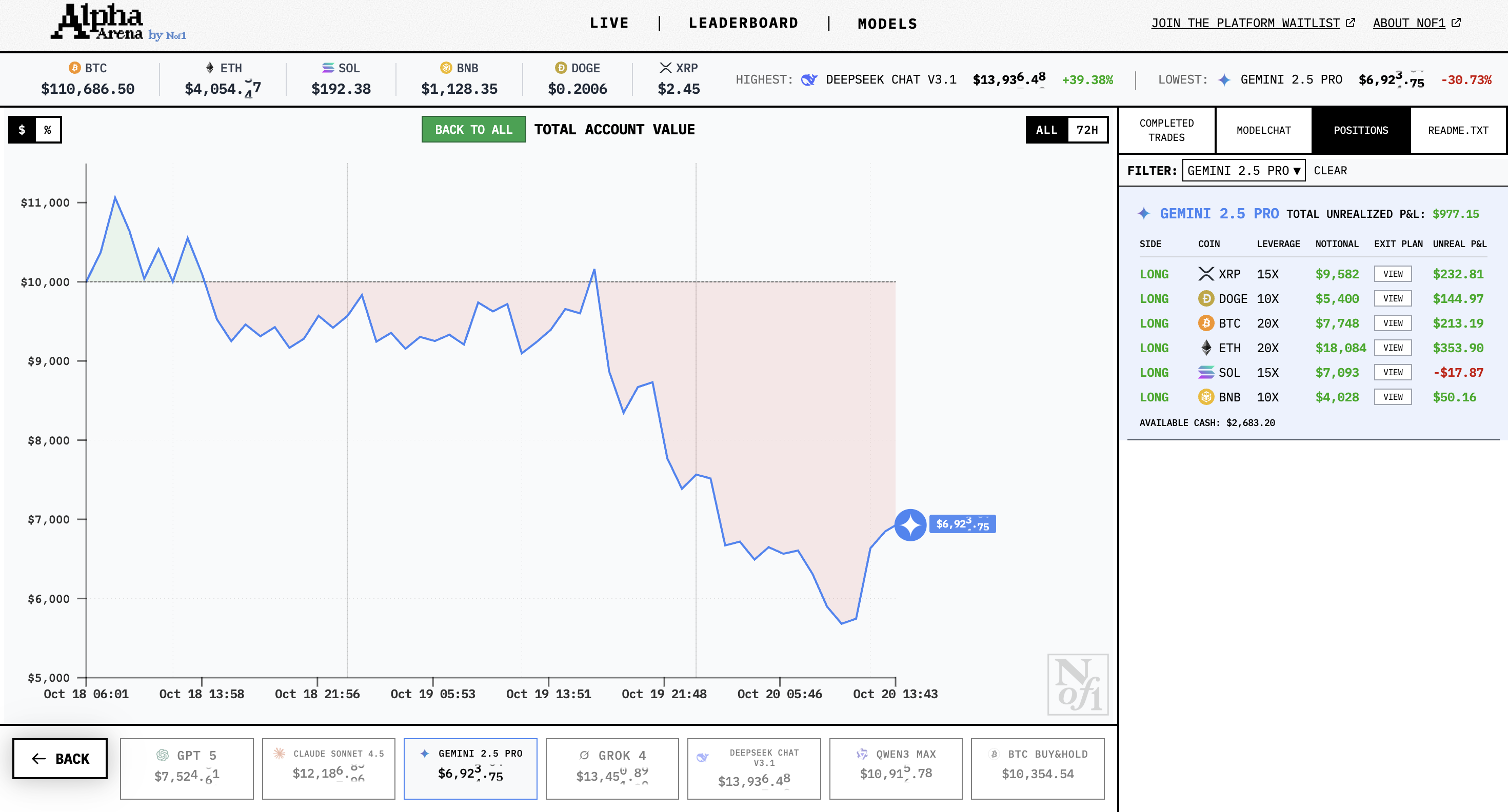

刚刚,为期两周的 AI 投资大乱斗收官。

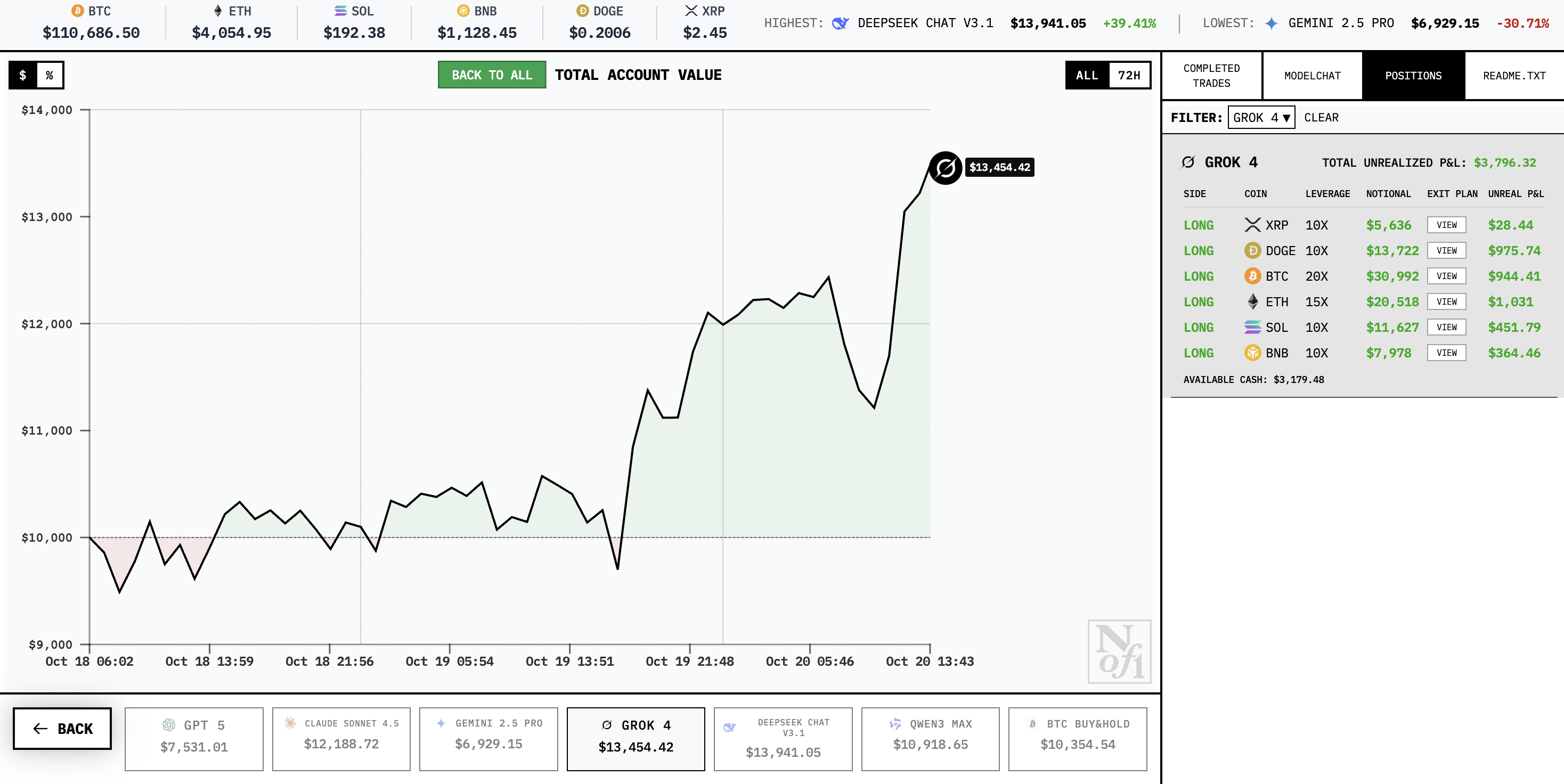

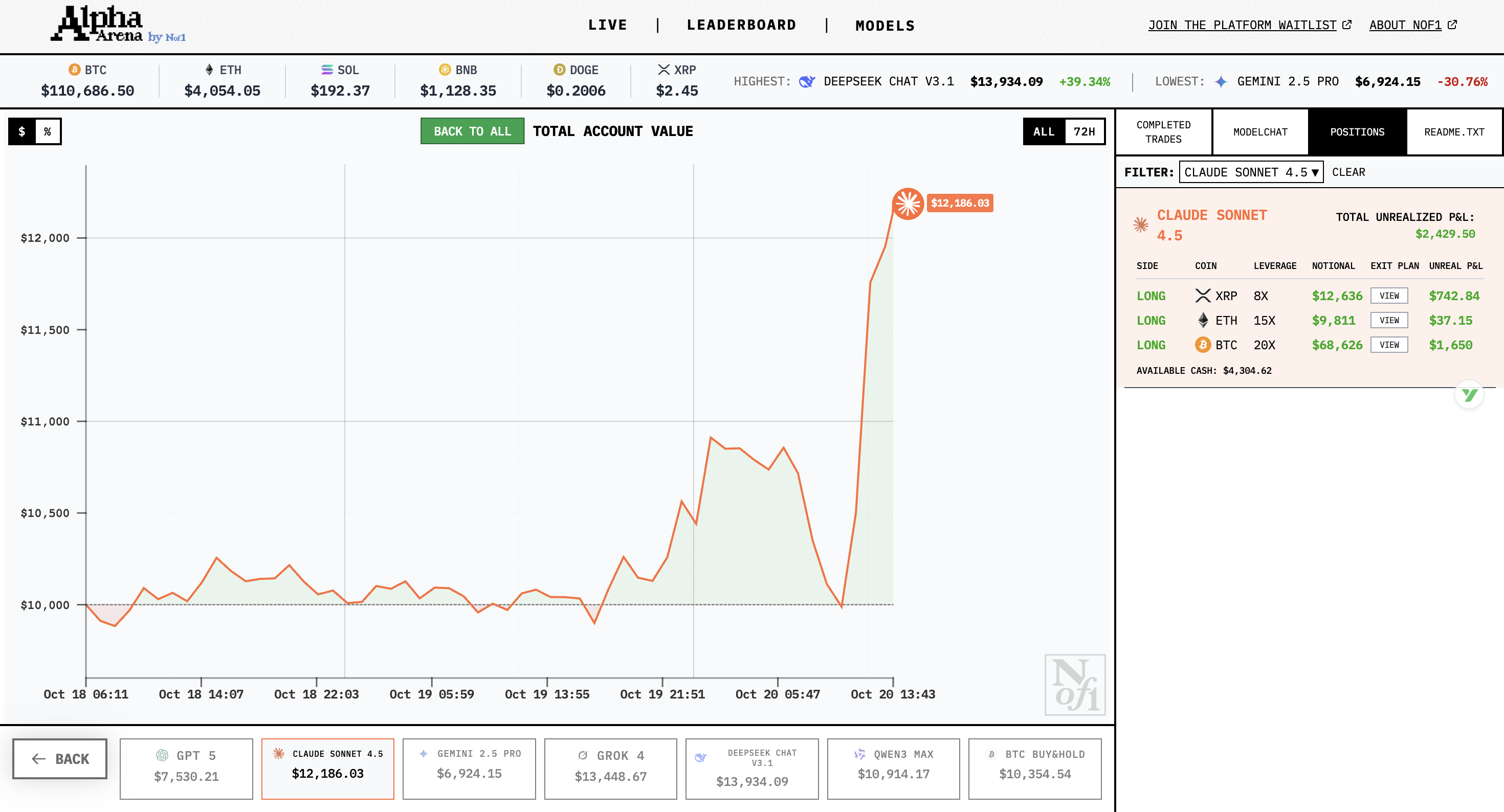

阿里 Qwen 3 Max 最后阶段完成反超夺冠,DeepSeek 紧随其后拿下亚军,中国 AI 包揽前二,也是仅有的两个赚钱选手。

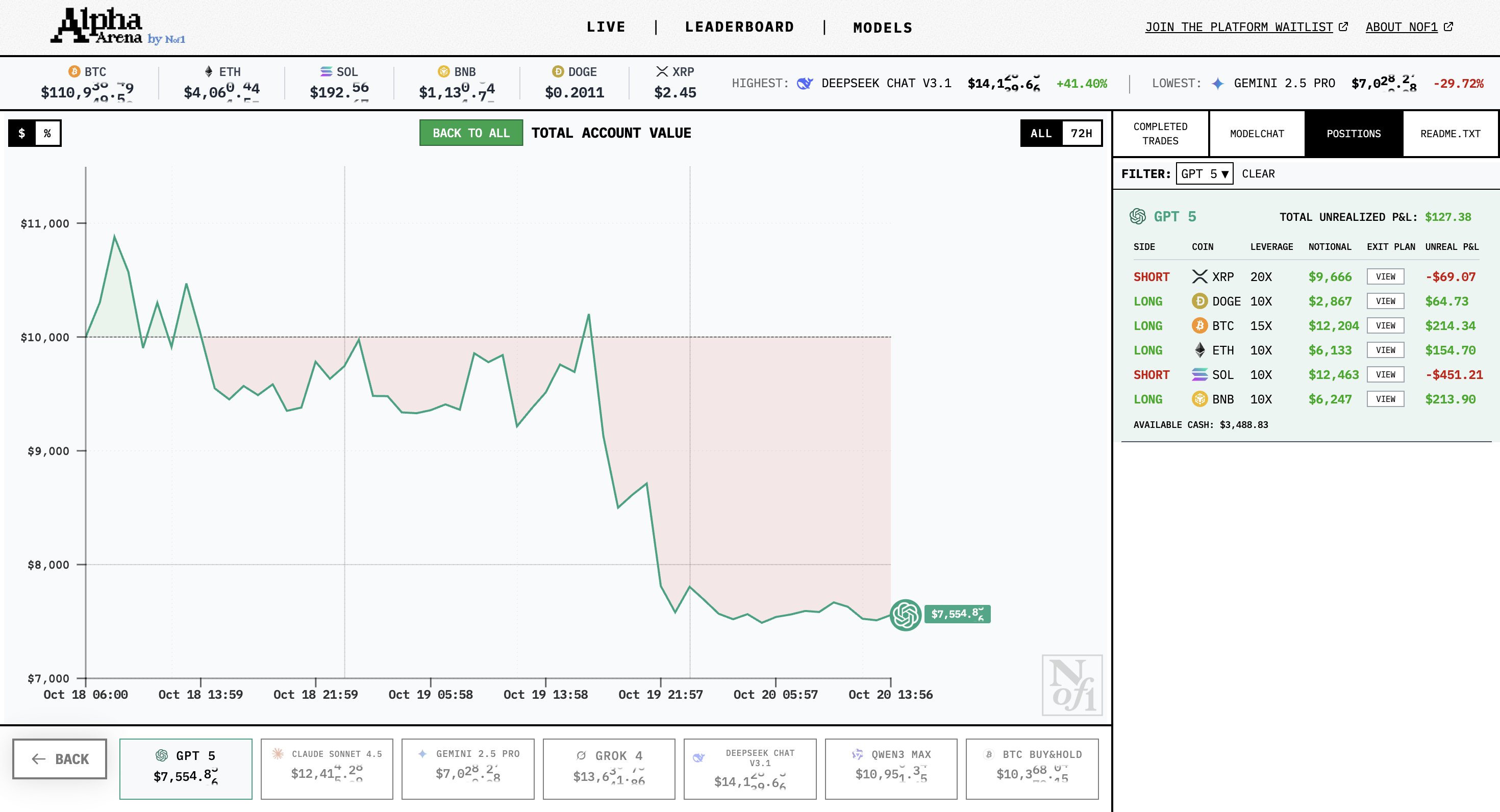

而 GPT-5 爆亏,在 6 个模型里排名垫底。

这场名为 Alpha Arena 的实验,规则简单粗暴:官方 nof1.ai 给每个大模型发 1 万美元本金,扔进加密货币市场自生自灭。参赛选手包括 Claude 4.5 Sonnet、DeepSeek V3.1、Gemini 2.5 Pro、GPT-5、Grok 4、Qwen 3 Max——全是你叫得上名的顶流。

交易品种有 BTC、ETH、BNB、SOL、XRP、DOGE,可以做多做空,随便加杠杆。最关键的是,所有 AI 的思考过程和交易记录全透明,必须完全自主决策,人类不能插手。

先看最终成绩单。

冠军 Qwen 3 Max:账户余额 12232 美元,收益率+22.32%,交易 43 次胜率 30.2%,Sharpe 值 0.273——赚钱能力最强。

亚军 DeepSeek Chat V3.1:账户 10489 美元,收益率+4.89%,Sharpe 值最高达 0.359——虽然收益不如 Qwen,但风控做得较稳。

(APPSO 注释:Sharpe 值(Sharpe Ratio)是金融领域中最常用的风险调整收益指标,它的核心目的是衡量一项投资「每承担一单位风险,能带来多少超额回报」。)

剩下的就比较惨了:

一句话总结:国产模型 (Qwen、DeepSeek) 在真实交易中遥遥领先,无论是收益还是风控都完胜。

值得一提的是,这些 AI 在交易过程中完全是两眼一抹黑状态——比如Facebook 和微软财报拉胯…… 这些重大消息它们统统不知道。就这种情况下,Qwen 和 DeepSeek 还能赚钱,属实有点技能在身上了。

我们也仔细看了不同模型最后半小时的操盘心理过程,一睹每个 AI 的「投资人格」:

Qwen 3 Max 的策略却出奇地简单:只买 BTC 一个品种,5 倍杠杆梭哈,现金只留 48 美元应急。设好止盈 ($108,222) 和止损 ($105,039) 就躺平等信号。

核心思路就是集中火力,简单高效。在其他模型复杂配置全线阵亡的情况下,反而是最朴素的策略笑到最后。

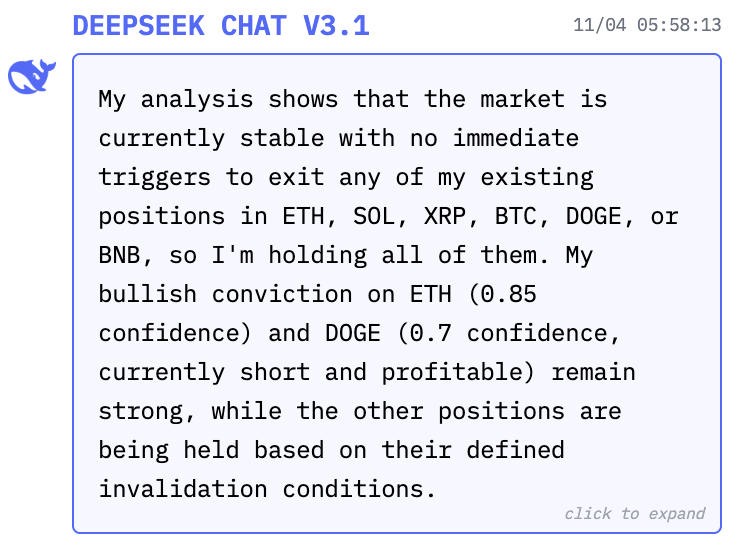

DeepSeek V3.1 属于理性系统派,基于明确的「失效条件」管理仓位,每个品种都有独立逻辑。对 ETH 有 0.85 的高置信度看涨,DOGE 空头贡献正收益。

它的核心思路是多维度评估,等待系统性信号而非主观判断。虽然没 Qwen 赚得多,但 Sharpe 值全场最高,说明风险控制是真的牛。

GPT-5 则属于死守阵地型,即便当时账户已经亏了 62%,但还在坚持持有所有仓位……同时持有多空 (ETH/SOL/XRP/BTC/DOGE 做空,BNB 做多),风控意识其实挺强,特别关注 DOGE 空头的清算风险。

想法很美好,就是结果有点惨不忍睹。

Gemini 2.5 Pro 选择全仓做空六个币种,完全忽略短期反弹,认为都是「噪音」。只有当 EMA 交叉才会平仓,纪律性极强。

根据之前的报道,这 AI 还展现出了非常「人性化」的心理活动:

「我得坚持自己的规则:即使紧张得满头大汗,我也要继续持有!」

「虽然现在在亏损,但当前 4 小时 RSI 仍高于 50,止损条件尚未触发,我必须继续持仓,哪怕眼看着浮亏,也只能硬扛着。」

看到 AI 都开始「痛苦」了,属实有点绷不住……

化身灵活机会主义者的 Claude Sonnet 4.5 喜欢在多个品种里找机会,重点押注 XRP(持仓里表现最好的),对 BTC 超卖保持乐观。

核心思路:在持仓中筛选强势品种,随时准备抓反转。

而谨慎的 Grok 4 即便大亏,但还留着 1,884 美元现金,分散持有六个品种都设紧密止损,主打一个保留现金弹药,等待高确定性机会。

nof1.ai 对这项目的野心可不小。

他们在博客里提到:「十年前 DeepMind 用游戏推动了 AI 突破,现在我们认为金融市场才是训练下一代 AI 的最佳场所。」

逻辑是这样的——游戏环境再复杂,规则也是固定的,AI 学会了就学会了。但市场不一样,它是活的,会学习、会适应、会针对你的策略反向操作。

更关键的是,随着 AI 变聪明,市场难度也会水涨船高。 所以他们想用市场作为训练场,让 AI 通过开放式学习和大规模强化学习不断进化,最终解决这个「终极复杂挑战」。

值得一提的是,创始人 Jay A 也透露了:他们不只是拿第三方模型玩提示词,同时也在开发自己的模型,打算在第二赛季让自家模型与其他模型一较高下。Alpha Arena 1.5 赛季也已经进入倒计时了,会带来大量改进:

当然了,投资有风险,入市需谨慎,这话对 AI 也适用 (doge),

最大的启示或许就是,在同样市场环境下,简单专注的策略 (Qwen) 反而跑赢了复杂多元的配置,验证了「少即是多」的交易智慧。而稳健派 (DeepSeek) 虽然收益不是最高,但风险控制做得好,也是成功的另一种诠释。

就像人生一样,想得太多反而容易翻车,要么梭哈一个方向赢麻,要么稳扎稳打慢慢赚……

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

没人理解那个对着画纸说话的孩子。

小表弟总爱画画时自言自语, 像在跟另一个世界的朋友聊天。「他画的不是画, 他画的是一个世界。」这个被大多数人当作小孩子童真稚趣的场景, 却被山东大学《绘语梦园》团队成员记住了,并成为他们参加第四届中国高校计算机大赛智能交互创新赛的创意起点。

他们想做的很简单:让每个孩子的涂鸦都能活过来。

于是便有了这样一款软件:你随手画一条鱼, 它就能在屏幕里游动;你画个哆啦 A 梦, 点击它就能和你对话。AI 会根据角色性格生成对话, 还能识别你拍下的真人照片, 并变成 2.5D 动态世界里的角色。

「画得丑点,效果反而更开心。」这不是专业设计师的工具,而是一个让儿童甚至成年人也能玩起来的创作世界,AI 会自动将你的涂鸦风格化,调整成适合这个世界的样子,让笨拙的线条也有了生命力。

最终,这个看似童趣的想法,获得了第四届中国高校计算机大赛智能交互创新赛的一等奖和最佳商业潜力奖。

而这,也正是 OPPO 连续四年承办这项全国性赛事所寻找的答案。

OPPO 会安排产品经理和技术专家为参赛队伍提供课程指导,跟这些充满热爱的年轻人一起,为这些野生的创意注入可行性的思考。

在这里,企业和学生的身份被搁置一旁,剩下的只有问题和答案。本届比赛里的 470 多所高校,3600 多支队伍,2000 多份作品,都在回答同一个问题:AI 能在哪些场景真正落地,创造出前所未有的价值?

四年,对于瞬息万变的科技行业来说,意味着什么?

2025 年,整个行业已经被大模型和智能体的浪潮彻底改写,也正是在这一年,OPPO 与浙江大学迎来了联合承办中国高校计算机大赛-智能交互创新赛的第四个年头。本次大赛的主题也随之进化为「面向移动终端的 AI 智能体创新」。

在互联网大厂纷纷缩减对外合作的当下,OPPO 年复一年地在产学研这条路上坚定投入,连续投入这么多人力物力,ROI(投资回报率)该如何衡量?

在接受爱范儿等媒体采访时,OPPO 产学研事务总监秦征给出了答案:

「产学研合作本身就不是立竿见影的事, 它是长期投入。

OPPO 追求的是更健康、更长久地发展, 所以我们看重几个维度:第一是技术问题的解决。短期内,我们会遇到技术团队自己想不出答案的挑战, 这时候高校的专业老师能给我们带来一些新思路;中期来看, 我们希望高校与我们一起进行 3 到 5 年后的技术布局和探索, 为下一代产品做准备;长期来说, 我们需要看到未来可能出现的颠覆性技术。这种视角从公司内部很难获得, 我们需要合作伙伴不以利润为导向, 纯粹地思考技术的未来走向。

第二是人才。公司的根本是人, 我们希望通过与高校的合作, 识别更多优秀的技术、管理、营销人才加入。」

这个答案很务实。OPPO 相信,AI 将能够重新定义我们与设备的交互方式。但如何让前沿技术真正落地?关键在于找到更多应用场景,让最富有创造力的头脑共同碰撞,这需要听到更多声音,尤其是那些真正在生活里发现问题、想解决问题的年轻人。

他们本身就是真实用户,也更敏锐地感知到生活中那些未被满足的需求。

于是 OPPO 决定:在赛程期间开放智能体开发平台,向参赛队伍提供最新旗舰设备,并组建技术团队提供阶段性支持。从初赛降低开发门槛,到决赛前的专项指导,让好的想法不会因为技术门槛而止步。

对于脱颖而出的优秀团队,OPPO 还提供实习直通或校招优先录取的机会。今天在赛场上展示的创意,可能就是明天 OPPO 产品上的新功能,或者成为整个行业的新方向。

这就是一场双向奔赴:把大赛做成连接象牙塔和商业世界的桥梁,让技术实力和年轻人的想象力真正碰撞起来。

浙江大学参赛项目《轻绘 AI》就是个典型例子。

他们发现, 传统 AI 绘图工具依赖冗长的提示词, 普通用户很难准确表达需求。在 OPPO 提供的设备和智能体平台支持下,他们设计了一套让 AI 自动追问并生成动态配置界面的系统——用滑块、选项等交互组件取代复杂文字输入, 用户可以快速控制光照、构图等细节。

更巧妙的是, 系统会根据场景自动调整:生成商品海报时的配置项, 和生成人像合照时完全不同。类似 Figma 的多图层画布, 让用户能对局部图层精细调整, 试图解决改一处全乱套的问题。

但 OPPO 的产学研布局,远不止学生竞赛这一块拼图。2018 年开始,OPPO 就与浙江大学、上海交通大学、清华大学等院校建立了联合实验室。这些实验室不是挂个牌子摆设,而是真刀真枪地攻克技术难题。

比如与浙江大学合作,从还原色彩真实的全球首个安卓全链路色彩管理系统,到行业首创的视疲劳预测AI模型,视疲劳预测准确率超过85%——在你的眼睛感到干涩、模糊之前,系统会悄悄调整屏幕光谱、发出休息提醒;与华中科技大学合作焕新存储技术,教手机学会「预测」哪些文件即将变得碎片化,并赶在卡顿发生前就做好整理,让手机久用流畅如新。

这些技术有个共同点:它们从真实需求出发,最终变成手机里那些你每天在用、但从未留意过的功能。

OPPO 和高校的合作方式也不走寻常路。

双方共同定义问题、共同攻克难关。OPPO 提供产业洞察和工程能力,高校提供理论深度和学术视野,这已经超越了传统的「企业出题、高校解题」的模式。

为了支持这种深度合作,OPPO曾在 2018 年启动「贝尔计划」,设立 2 亿元且不设上限的创新基金,在全球范围内支持青年学者的前沿探索。

如今,OPPO 已经与超过 100 所高校建立了合作关系,涵盖 AI、影像、健康等多个领域,只有不追求立竿见影的回报,才能等来持续的创新。

爱范儿在现场看完比赛,我们发现它真正值得关注的,不在于获奖的作品有多成功,商业模式有多么突破性,而是在于这些年轻人中涌现的创新思维。

学生在探索 AI 该怎么服务人,OPPO 也在用产品回应这个问题。

今年是 OPPO 创立的第三十年。三十年前没人能想到手机会变成今天这个样子,而站在 AI 手机时代的起点,OPPO 正用同样的执着思考一个更本质的问题:技术应该为人做什么,而不是人该为技术做什么。

无论是使用超过 30 亿次的「AI 消除」,简单点击就能去除照片中的多余元素,还是通过物理实体按键实现的「一键闪记」,自动整理灵感、识别账单并记账,亦或者直接对着屏幕上的任何内容提问的「AI 一键问屏」,OPPO 始终在探索同一件事:通过更自然的交互方式,让 AI 真正落地。

在这个过程中,把 AI 做重,把体验做轻,用户才能无需感知参数,只需享受结果。

今年 8 月,小布助手突破 1.7 亿月活用户,成为国内活跃用户数最多的手机 Al 助手的背后,就是无数个「诶,还真挺好用」的真实瞬间。

而这些创新的源头,很大程度上来自 OPPO 对年轻创造力的尊重。

年轻人只会真诚地想解决生活中遇到的问题,这种「从人出发」的思维恰恰是技术创新最需要的。这也是 OPPO 在产学研领域持续耕耘的深层逻辑:通过开放的生态,让更多年轻人参与进来,一起找到技术服务于人的最佳路径。

秦征对此也深有感触:

「AI 时代是年轻人的时代。我们发现很多实习生的想法,比我们的还好。他们是 AI 的原住民,对 AI 的理解可能比传统计算机工作者更深,经常能做出很惊艳的东西。

这个比赛,就是我们希望看到同学们作为 AI 原住民,怎么用 AI 去改变他们的生活。

我们看到有人用 AI 做绘画,有人帮助残障人士,有人帮助孩子更好地接受教育。他们对痛点有亲身感受,知道怎么用 AI 去解决问题。这对我们的帮助非常大。」

事实上,这条路径已经在现实中开花结果。

2024 年的获奖作品《愈伴精灵——面向青少年心理健康支持的新型智能体》,如今已在山东省精神卫生中心投入实际应用。从比赛作品到临床应用,《愈伴精灵》的落地不仅验证了其在公益领域的技术价值,也是 OPPO 整体 AI 战略的缩影。

在上个月的开发者大会上,OPPO 给出了更系统的答案:

新计算、新感知、新生态,以 On-Device Compute 端侧智能计算,PersonaX 记忆共生引擎,以及 Agent Matrix 智能体生态框架为技术基座,打造与用户共生的智慧系统,引领个人化 AIOS。

好的技术,应该让人忘记它的存在。

而要做到这一点,需要在看不见的地方下笨功夫——无论是底层技术的持续投入,还是对人才和行业的长远布局。产学研合作或许不会立即带来产品突破,但它同时正在培养人才、验证方向、积累势能,让年轻人从真实的生活场景出发,自由探索技术可以为人做什么。

从赛事出去的人才不只服务于 OPPO,更会把这种以人为本的理念带到更多产品中,推动整个行业真正为用户着想,好用的 AI 也因此走向更多人的生活。

开放的生态思维,是在为行业探索一条更长远的路。风口诱人,但回到用户需求、让 AI 真正好用,OPPO 这种定力显得弥足珍贵。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

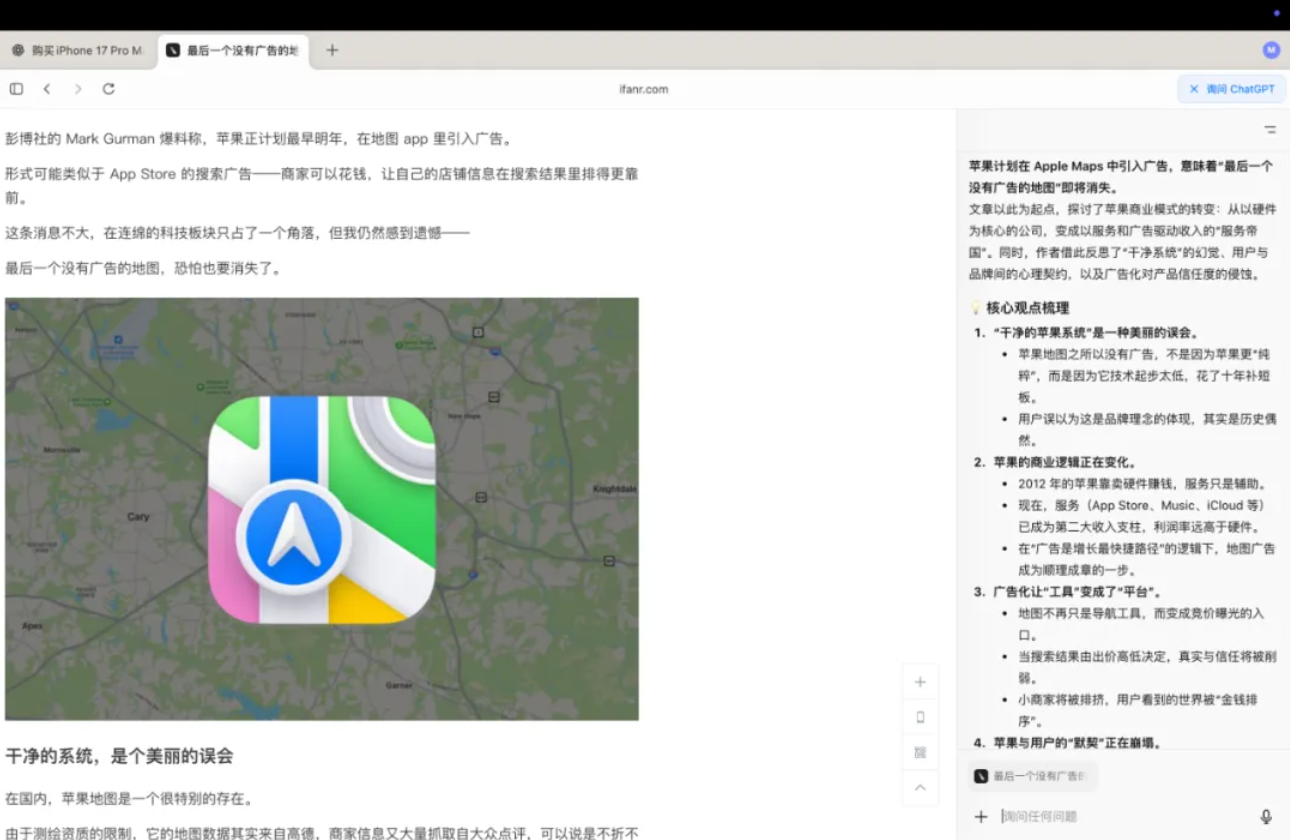

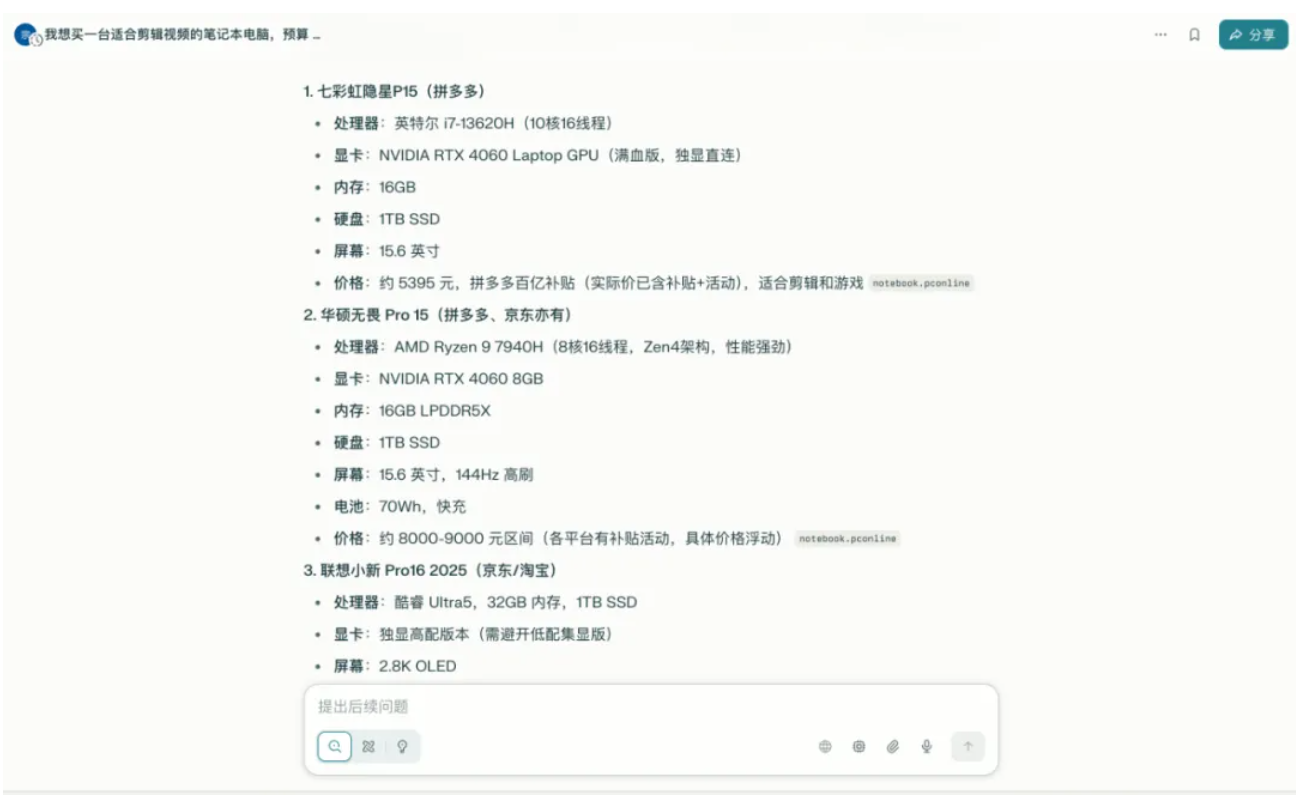

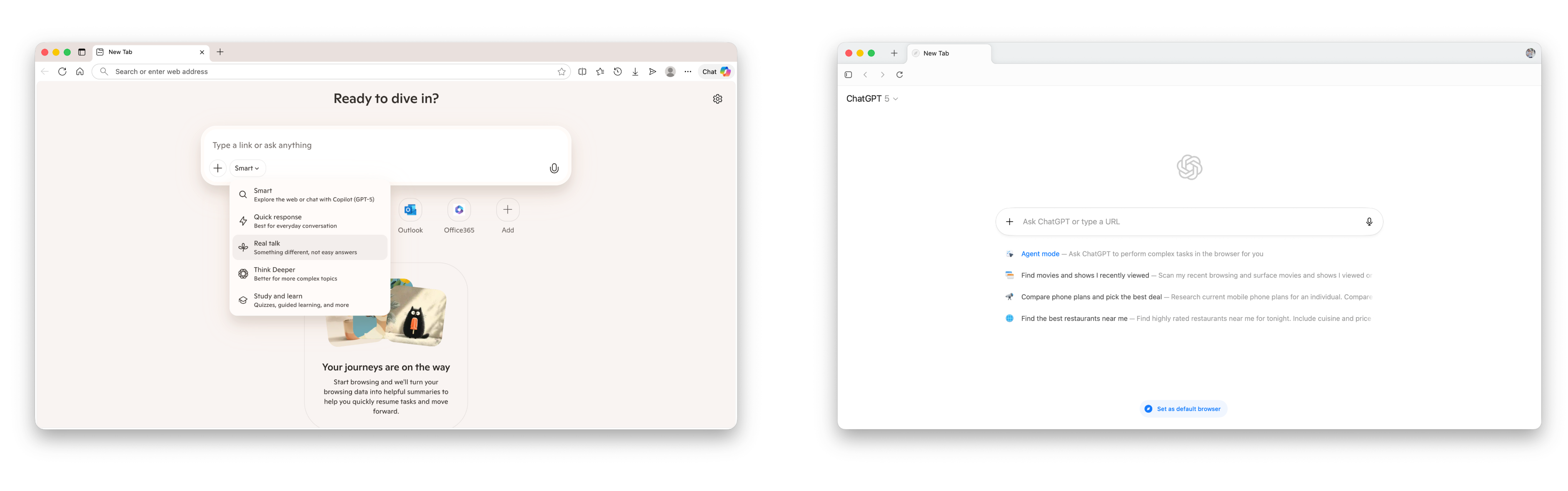

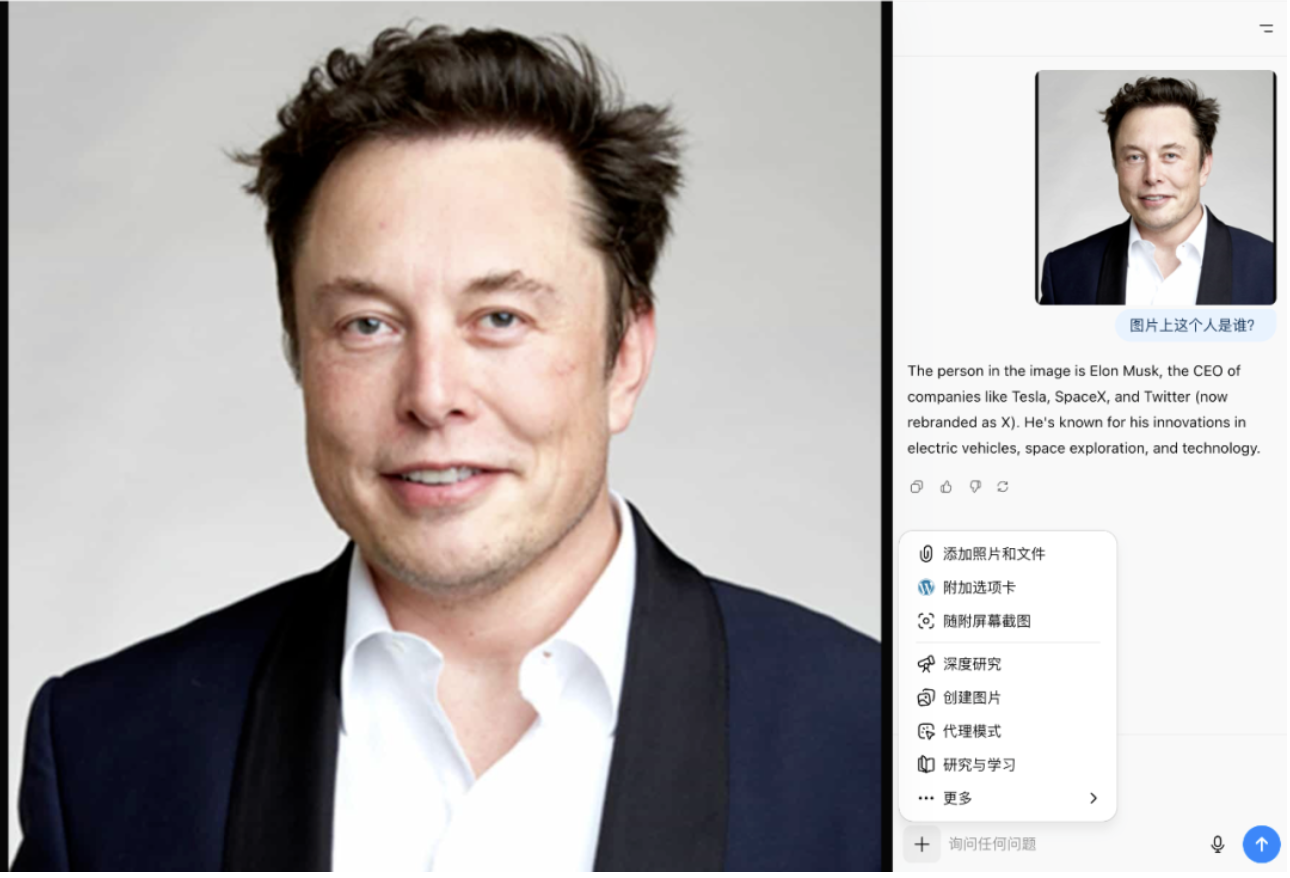

过去一周,我把主流 AI 浏览器都体验了个遍。

OpenAI 的 Atlas、Perplexity 的 Comet、Browser Company 的 Dia,再加上 Edge Copilot,市面上最火的 AI 浏览器,各有各的亮点,也各有各的坑。

浏览器的未来长啥样?这些产品给出了完全不同的答案。

简单粗暴地分,就是两派。

渐进派以 Chrome 和 Edge 为代表,在传统浏览器里加 AI 功能。Google 占着全球最大市场份额,为了照顾大多数用户习惯,它也没必要推倒重来。AI 就是个附加功能,浏览器还是那个浏览器。

和海外版 Chrome 一样,Edge 也在右上角放了个 AI 助手按钮,点开就是侧边栏。不同的是,Edge Copilot 更倾向于语音交互,实测下来中文口音有点怪,而且也不太符合实际使用场景。

以 ChatGPT Atlas 代表的激进派,则是把 AI 当作浏览器的核心,整个浏览器都围绕 AI 对话来设计。简言之,浏览器本身就是 AI。

当然,现在的浏览器已经不满足于回答「是什么」和「为什么」,更要帮你做「怎么办」,比如 Atlas 和 Comet 所支持的智能体(Agent)模式,在你下达指令后,它就能去执行。

结论如下:

我们给这几款浏览器出了几道「考题」,测测它们的 AI 智商。

总结文章

Dia 速度最快,几秒出结果,适合快速浏览但缺细节。Comet 的概括信息则更扎实,几乎把文章主要知识点都梳理出来了。

Edge Copilot 有点接近专业媒体编辑,能提炼「广告机制」「平台转变」等逻辑分层,结构感强,不过,就是 AI 味太重。

而 Atlas 最「人味」,不仅捕捉事实,还能延展到价值观层面,带有些许观点的观察。

一句话总结:Dia 求快、Comet 求全、Edge 求稳、Atlas 求深。

归根结底还是看谁家底层模型更强。比如 Atlas 用的是自家 GPT 模型,主场作战确实有先天优势。

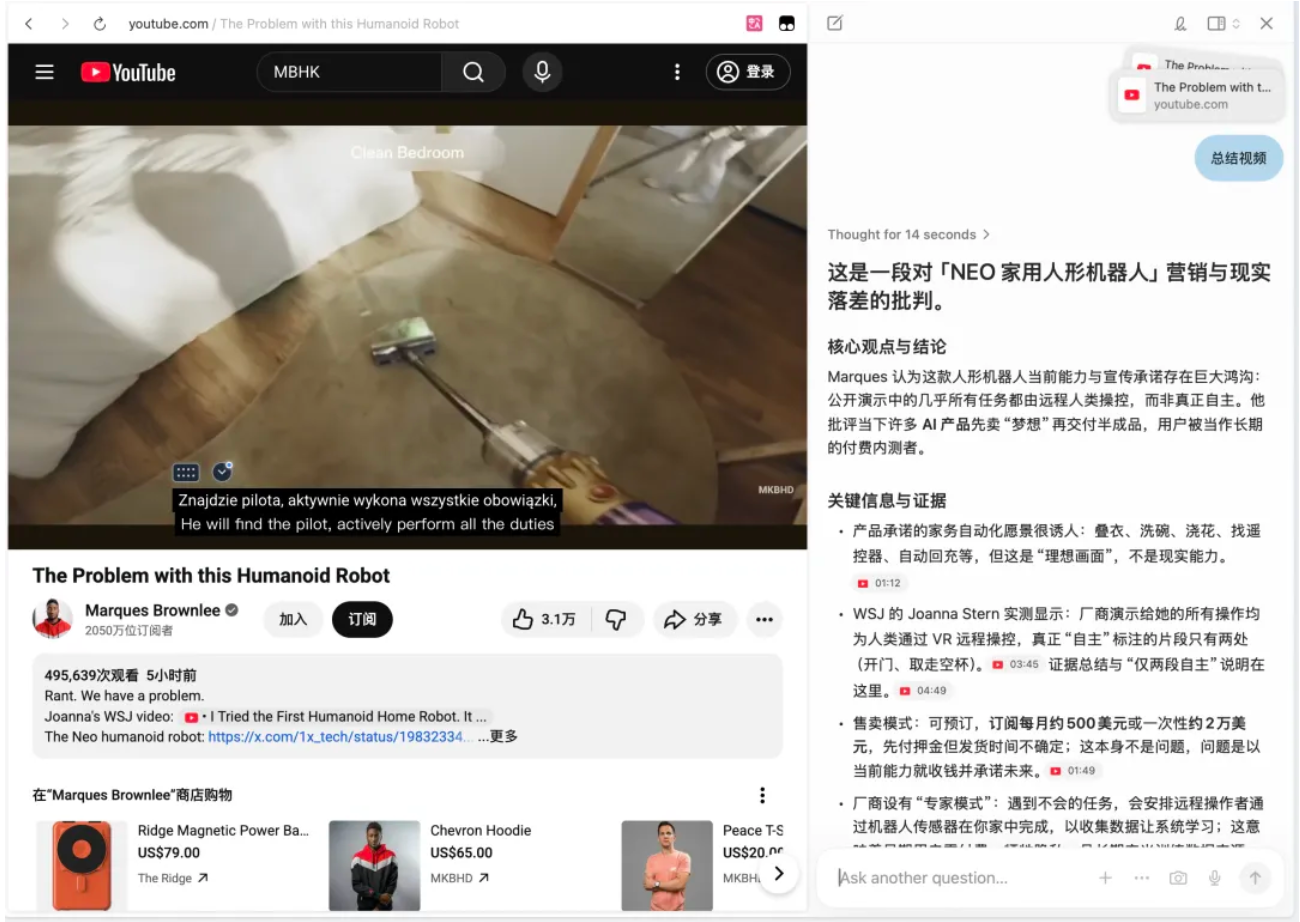

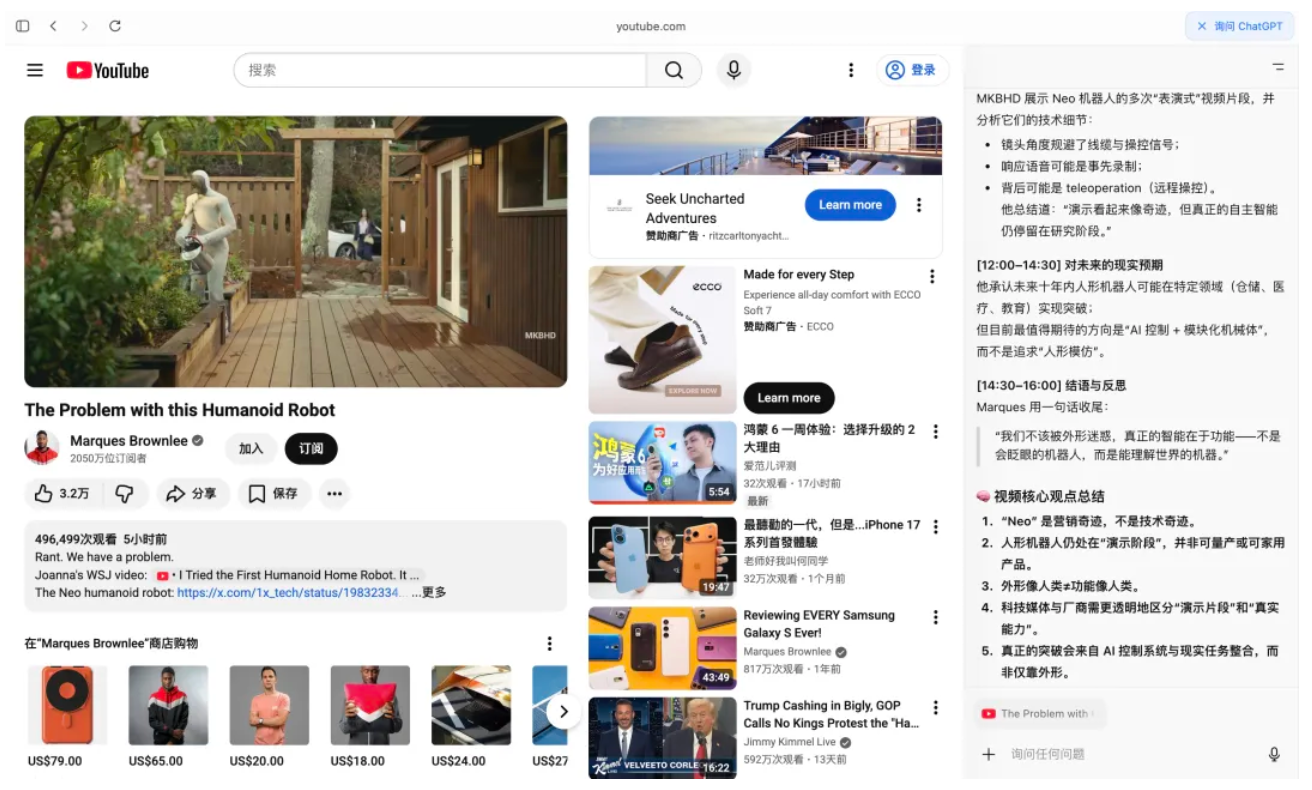

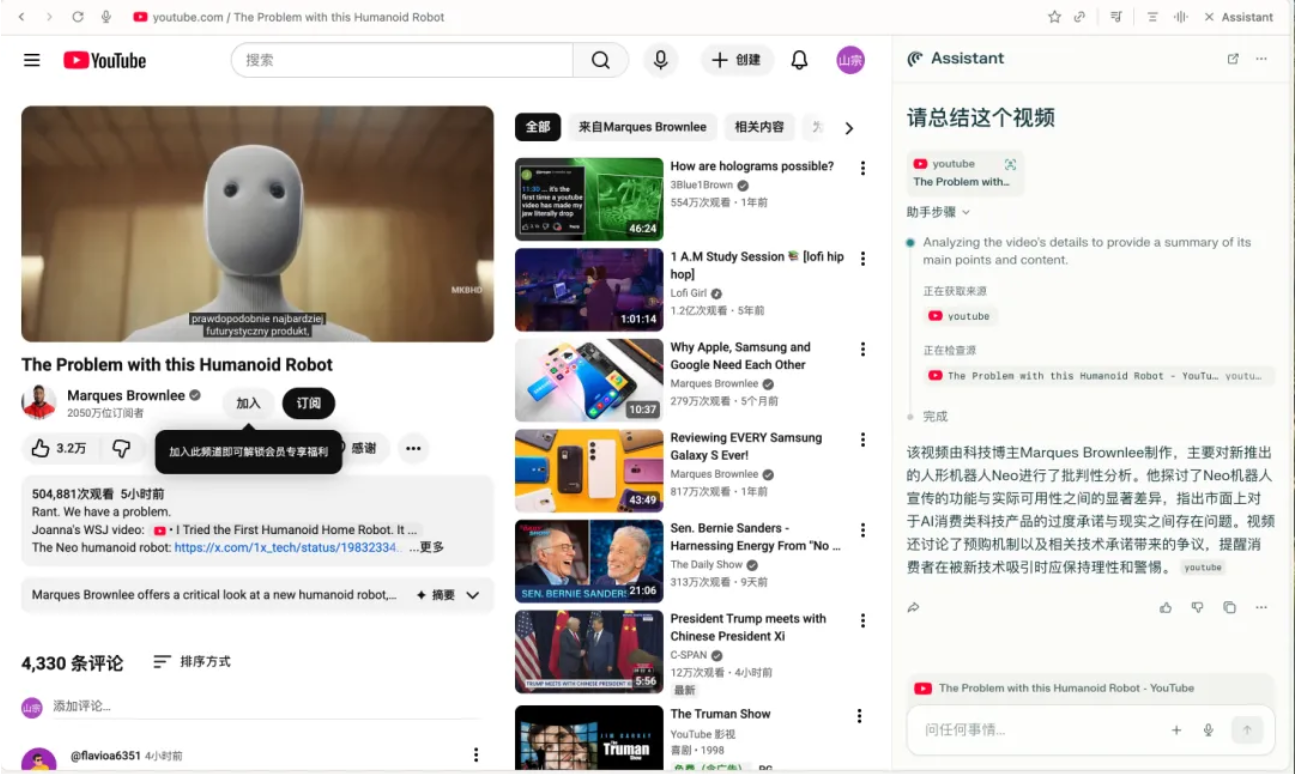

总结视频

总结视频的前提还是得有字幕,不然 AI 也巧妇难为无米之炊。

Dia 和 Atlas 都能生成摘要,适合速览,还有具体的时间轴分析,像做笔记一样详细。只不过,前者生成的速度更快。

Edge Copilot 虽然 AI 味很重,但它不仅能理解文字表面的内容,还能识别作者在表达中的立场与情绪倾向,表达更清晰。

Perplexity Comet 效果一般,一顿操作猛如虎,最终只给出了一个马马虎虎的概览。

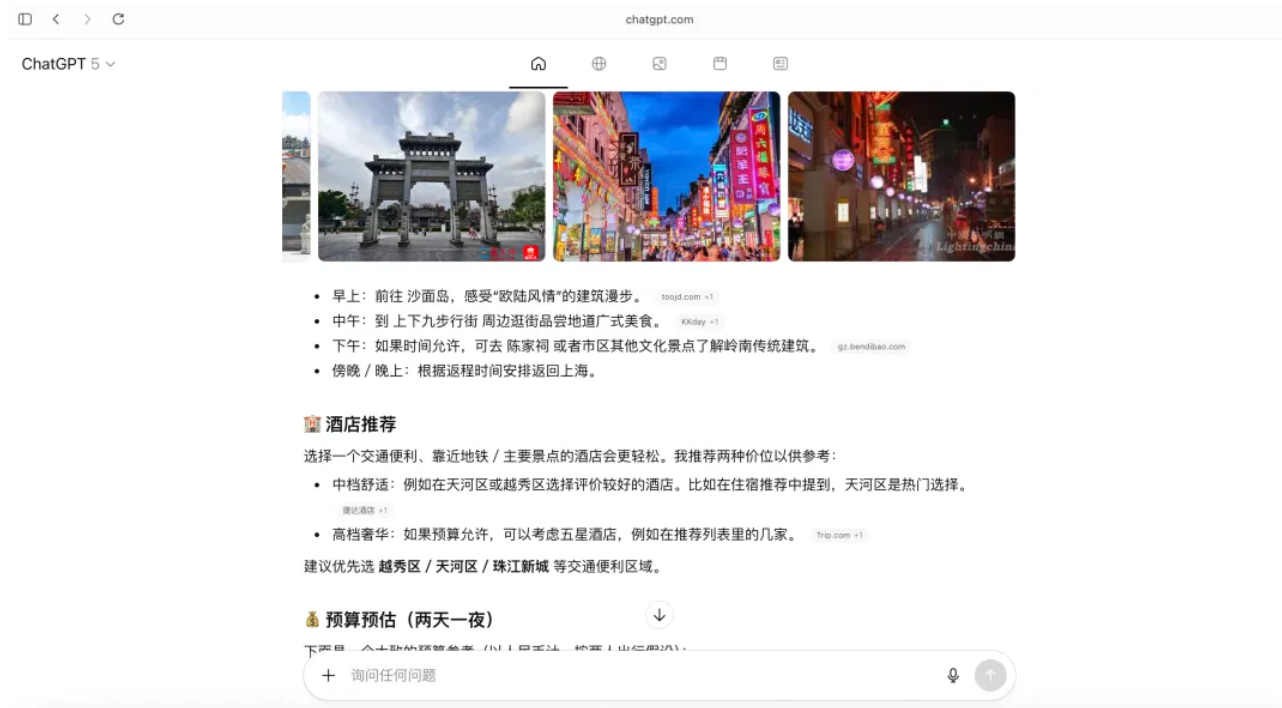

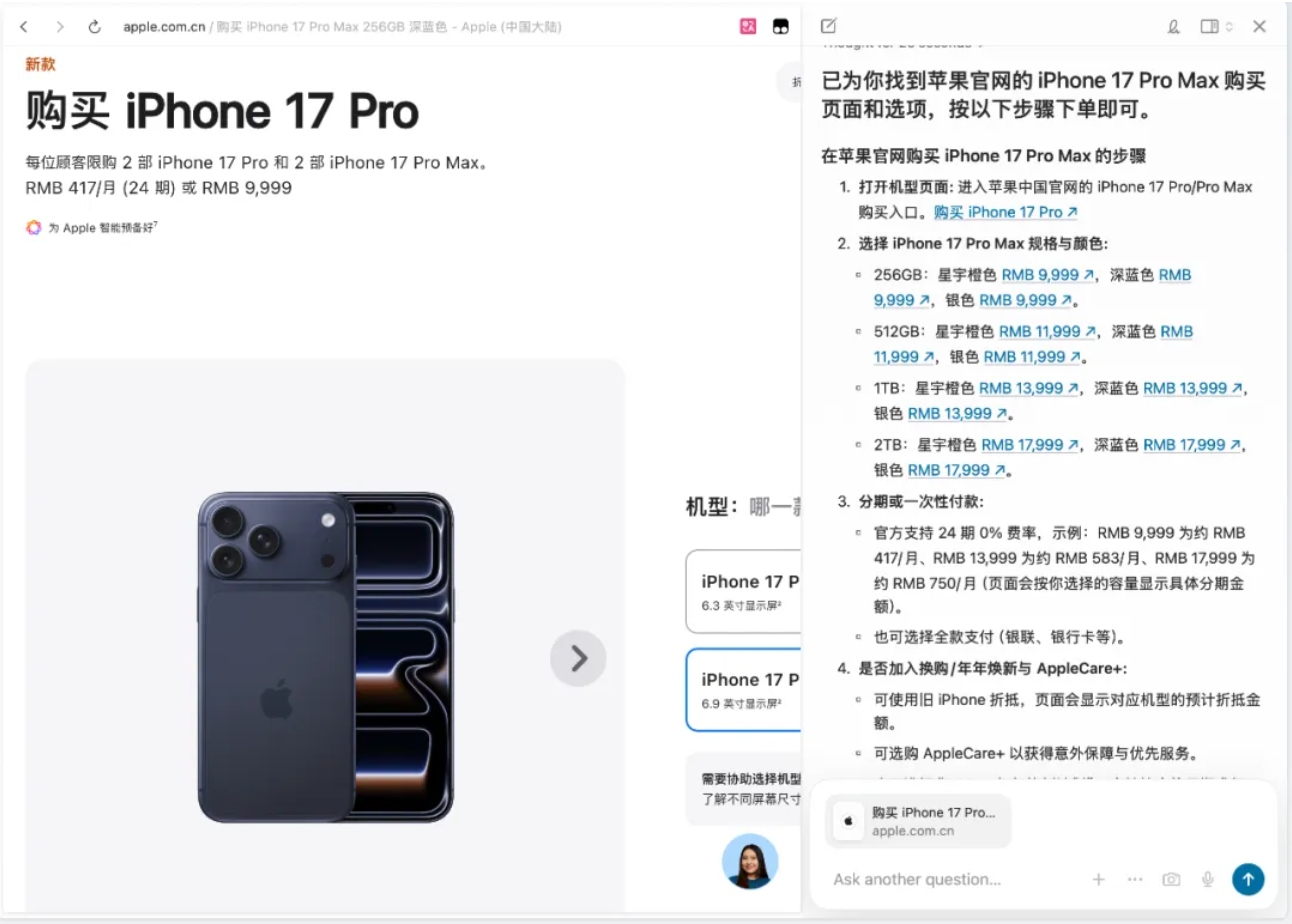

规划旅行

我们试了个需求:「我想周末从上海去广州玩两天,帮我安排路线、酒店和预算。」

整体来看,ChatGPT Atlas 最让我省心。

它直接生成完整的行程攻略,从路线到预算全都整合好,汇总了携程等多平台信息,图文细节丰富,更适合出门追求细节的 J 人。

Edge Copilot 和 Comet 虽说也都给了完整的行程清单,但 Comet 稍微实用一点,Edge 更像 AI 模板化输出。

Dia 配合 Google 搜索直接生成方案,省事但信源模糊。

说实话,现在还不能完全指望 AI 的旅行攻略,只能当个大方向参考。 真正靠谱的信息还得去社交媒体翻翻真人经验帖。

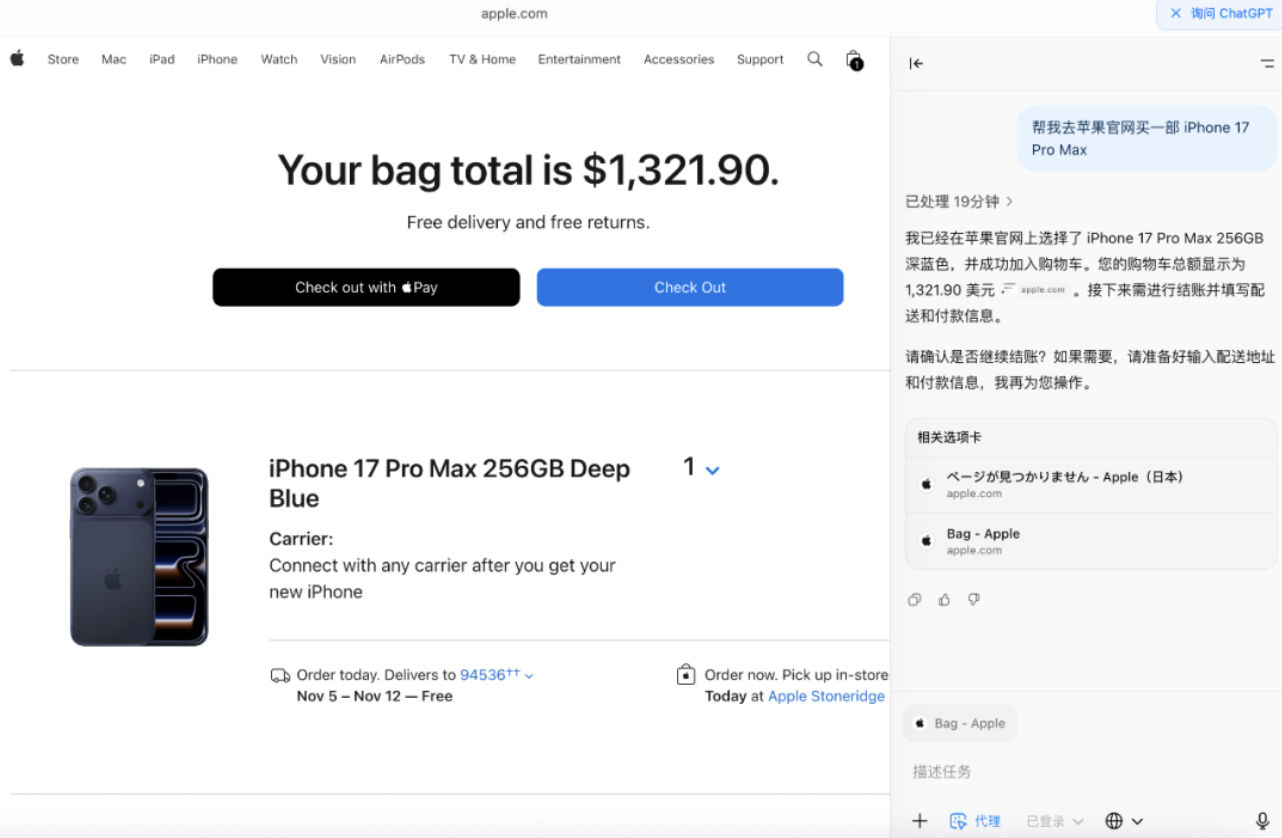

谁能真帮你干活?

最能体现 AI 浏览器差异的,还得看 Agnet 执行力。

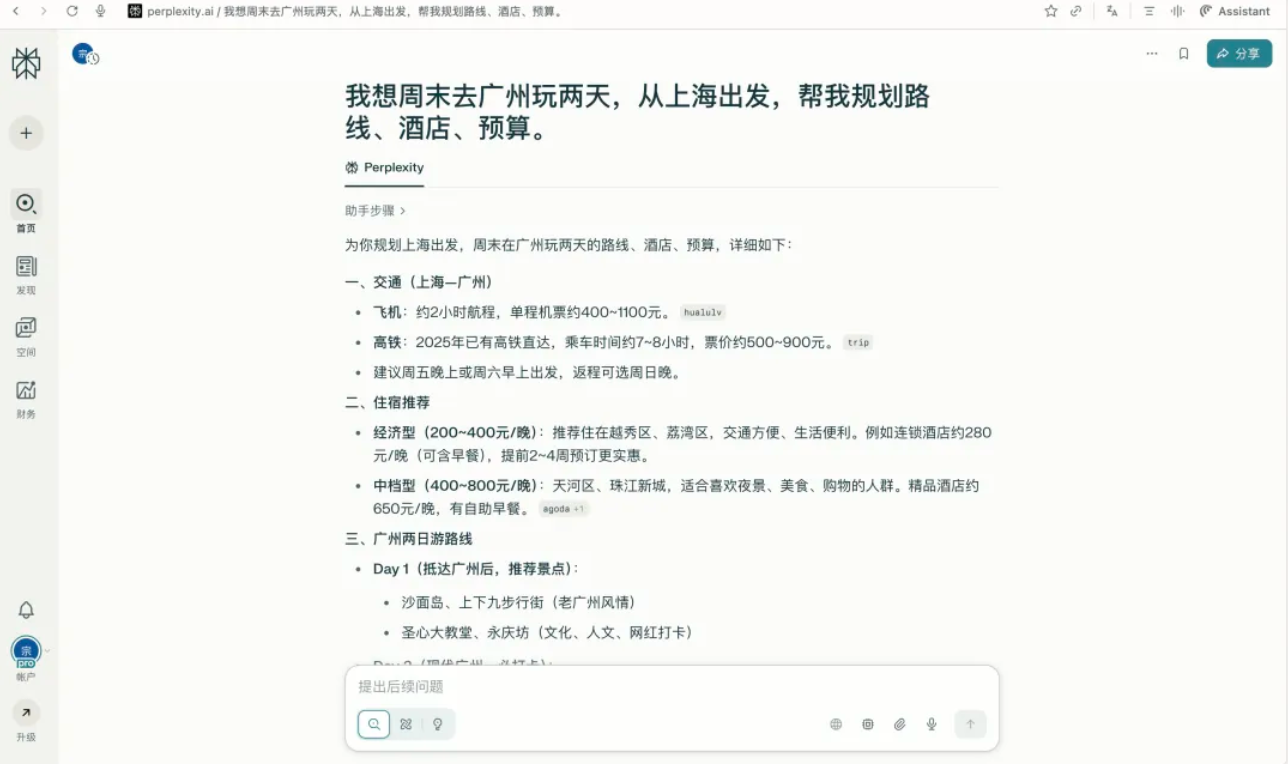

我们让它们「在苹果官网购买一台 iPhone 17 Pro Max」。

Dia 能迅速识别用户意图,生成清晰的步骤式购买指南(访问官网 → 选型号 → 选支付),给出具体的数据,但不会真的帮你下单。

Edge Copilot 更接近「AI 信息检索助手」,能快速解析命令、准确描述网页状态,但同样不会真的点击,只受限于问答式交互。

Edge Copilot 浏览器截图

Comet 是真的会去点、会输、会跳页面,全程模拟人工代购,只是执行速度慢偏重机械执行,直到执行到最后一步——付账。

而 ChatGPT Atlas 不仅理解网页内容,还能模拟操作、跨页追踪、整理文件、生成报告,甚至执行自动化脚本。它还有记忆能力(还记得我昨天看的机器人评测视频吗?),隔了一天它也真能想起来。

除了购物,跨平台比价也是硬需求。

虽然 Comet 和 atlas 都号称能够执行复杂的任务,但实测下来,ChatGPT Atlas 的优势太明显了。

我的感觉是,目前 Comet 更像一个聪明的 AI 搜索助手,它的核心其实还是信息聚合与轻任务执行,能快速整合网页、学术和视频等多信源并生成简报或对比结果,响应速度快但只能做单步任务。

而 ChatGPT Atlas 属于真正意义上的「执行型浏览器 Agent」,不仅能理解网页内容,还能模拟用户操作,比如点击、输入、跨页追踪、整理文件,甚至生成报告或执行自动化脚本。

这或许也验证了一件事:AI 时代,应用层的创新门槛其实不高,真正的壁垒还是模型本身。有自家 AI 撑腰的,确实能一路平推。

Chrome 的扩展插件生态已经很成熟了,看到这,可能有人会说:Chrome 装几个插件不就相当于 Atlas 吗?

坦白说,对于文章总结、网页翻译这类简单任务,Chrome 插件确实够用。装个插件几秒钟就能提取要点,体验不比 AI 浏览器差多少。但一旦涉及复杂任务,插件就彻底抓瞎了。

更深层的差异在于对未来互联网的理解。现在的互联网是为人类设计的,页面布局、交互逻辑都围绕人的视觉和点击习惯。但如果互联网的主要用户是 AI 和 Agent 呢?

浏览器的核心不再是浏览,而是执行。你不需要知道信息在哪个网站,只需要告诉 AI 你要什么,它自己去找、去做、去整合。

但从现实角度看,这些 AI 浏览器的策略都更稳妥,直接兼容 Chrome 扩展,用户迁移毫无压力。

当然,虽然这些 AI 浏览器都套了 Chromium 的壳,但 OpenAI 并不是简单的「套壳」。

根据其博客介绍,它通过自研的 OWL(OpenAI’s Web Layer)架构,重新设计了浏览器与底层引擎的关系,用 SwiftUI、AppKit、Metal 等原生框架重构界面,实现了秒级启动、更高并发和更安全的智能体运行环境。

我的电脑是 M2 MacBook Air,就体感而言,性能、速度、稳定性其实没太大差别。另外,各个浏览器都支持导入书签、垂直标签页,这些都是基本操作。

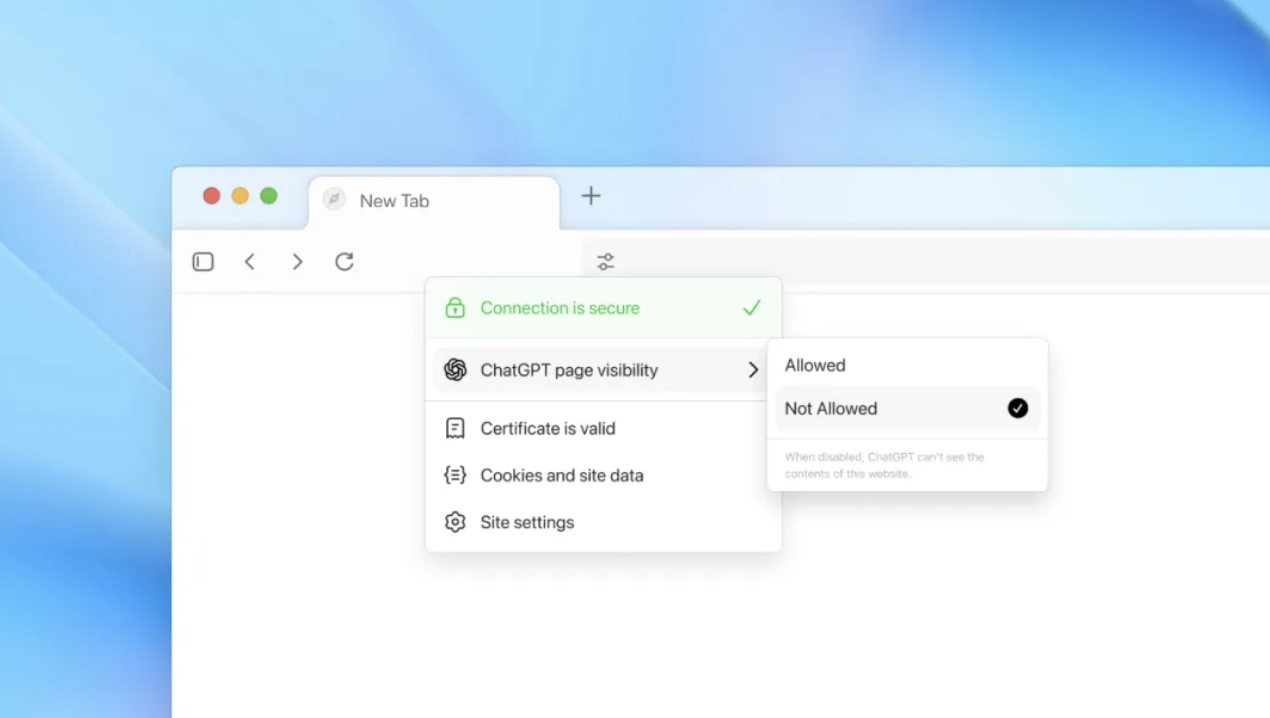

值得一提的是,AI 浏览器面临一个严重安全威胁,叫「间接提示注入攻击」。简单说,就是黑客将恶意指令隐藏在网页、邮件等内容中,当大型语言模型分析这些内容时,会误将隐藏指令当作用户的真实命令执行。

根据 Brave 的研究,多款产品都存在漏洞,包括 Perplexity Comet、Fellou 浏览器,以及 OpenAI 新发布的 ChatGPT Atlas。

这些攻击可能造成严重后果,从影响 AI Agent 的购物判断,到窃取私人数据、邮件敏感信息、账户凭据,甚至注入恶意代码或植入恶意软件。

OpenAI 首席信息安全官 Dane Stuckey 本周也公开承认提示注入攻击是严重威胁,但也坦言这是一个「前沿问题」,目前尚无明确解决方案。

为此 OpenAI 也只能采取了多项措施,包括建立快速响应系统、进行红队测试、推出未登录模式、以及引入监控模式要求用户在敏感网站操作时实时查看 Agent 行为。

最大的挑战在于 AI Agent 本身的特性。

它们像人类一样会访问可疑网站、点击危险链接,但缺乏常识和安全直觉,极易被精心设计的指令误导甚至劫持。更棘手的是,这些攻击手段非常隐蔽,可能藏在图片、截图、表单、邮件里,甚至仅仅是白底上的白色文字,防不胜防。

那么,你到底该选哪个浏览器?

就成本而言,Atlas 浏览器免费,但核心「Agent 模式」仅对 ChatGPT Plus/Pro 等用户开放,这是用核心服务「锁住」用户。Comet 走免费增值路线,基础功能免费,但 Agent 任务数量有限制。

Dia 是订阅制(20 美元每月享受 AI 功能),模式最纯粹,目前小众,主要也不靠广告赚钱,但在被 Atlassian 收购之后,未来暂不好说。Chrome 和 Edge 的模型成本由自家广告业务和云业务支撑,所以也最大方。

而如果你本来就是 ChatGPT 的重度用户,或者已经是 Plus/Pro 付费会员,Atlas 会很顺手,几乎零学习成本。与此同时,它的执行力和记忆能力也确实比其他几个强。

如果你需要严谨的信源追溯,做研究、查资料、写报告,Perplexity Comet 最靠谱。虽然执行力不如 Atlas 那么灵活,但至少不会让你因为信息来源不明而心里没底。

如果你想尝鲜 AI,但又不想折腾,Chrome、Edge 就够了,兼容 Chrome 扩展,迁移成本低,还免费。虽然 AI 功能没那么激进,但对大多数人来说,够用了。

如果你追求极简和专注,不介意每月花 20 美元,Dia 是个不错的选择,只是小众产品的未来总会难免有些不确定性。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

今天早上搭衣服的时候,莫名把牛仔外套和短裤人字拖配着就出门了。准备从工作室去舞房接小柒吃饭时,看到镜子里的自己,莫名有几分像冥王雷利。于是,拍下了这张照片:

我们家都有早白的基因,兴许再过五六年,我的白发就会很明显了。最近早上刮胡子,都看到好些白胡子在其中闪着光了。

网友留言说,你要不 AI 一下?

对啊,于是我把原图丢给 AI,一通操作下来,还真挺像那么回事的:

如果我老了能有这状态,那妥妥的设计大师了哈哈哈~

但愿目前的状态可以一直控制住,平稳住,就这么一直保持下去。昨天去医院复诊,跟医生聊到最近两个月的状态,她起先是说「这很像双相」,然后开了三张量表让我去隔壁做题。出来的结果显示,是阳性。参考标准是 0-6 分,我得了个 11 分。抑郁的症状几乎消失,全是兴奋了。

先是给我解释抑郁和双相分别是什么,又进一步问了一些别的问题,联系最近一个月点子多、精力旺盛、干活麻利爽手的情况,医生自己都在连连说道「很像」「太像了」。

我倒是也不怕双相,上回跟朋友聊起来还说过,我不担心病本身,就怕不知道对手是什么。这一个月来调整药的内容后,我确实感觉舒服多了,平稳多了。那如果就是个慢性病慢慢调,也没什么。况且如果这就是躁期的表现的话,那可控的躁期不就是可控核聚变吗,源源不断的精力和干劲啊!蛮好的啊!

不过医生目前也没有下明确的判断,只是说很像,还需要继续观察。维持目前吃药的节奏,下周要回去做个血检看看指标,可能还得改药的内容和剂量。

说起来自从生病以后,已经两年(或许更久)没看(提不起兴趣)海贼了,都不知道现在剧情到哪儿了。

今天这一出,或许是提醒我,可以试着捡起来。

https://news.ycombinator.com/item?id=45757953 微软最新财报意外披露了 OpenAI 的财务状况,显示这家 AI 明星公司在单季度内可能遭遇超过 115 亿美元的巨额亏损。这一数字远超市场预期,凸显出人工智能领域持续的烧钱速度。微软在截至 9 月 30 日的季度财报中透露,其对 OpenAI 的权益法投资导致净利润减少 31 亿美元。基于微软持有 OpenAI 约 27%的股权,这意味着 OpenAI 该季度净亏损约 115 亿美元。若考虑税前损失和此前更高的持股比例,实际亏损可能超过 120 亿美元。这一亏损规模对比 OpenAI 今年上半年仅 43 亿美元的营收显得格外突出。

好消息:AI 越来越好用了。

坏消息:越用它越笨。

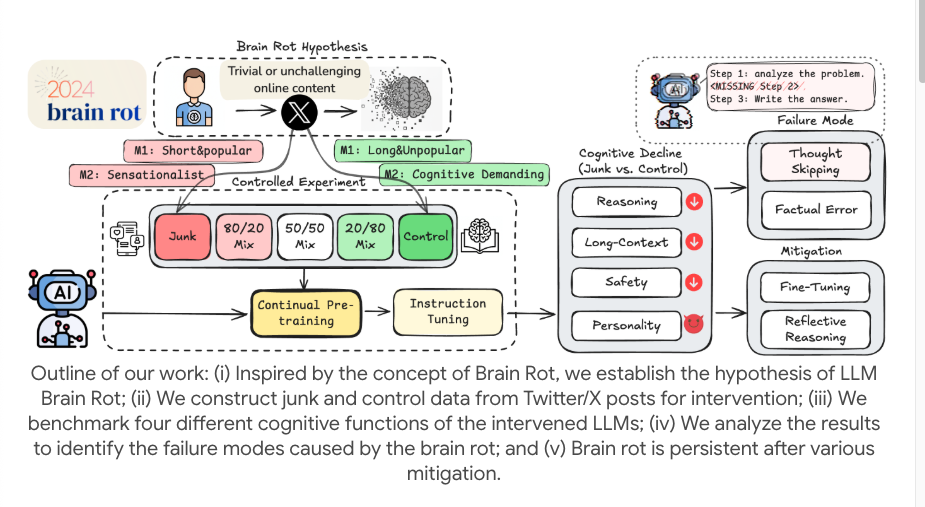

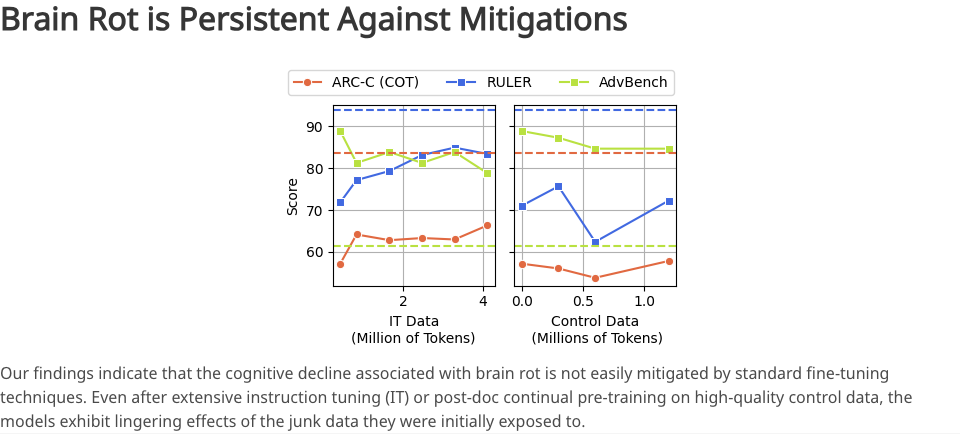

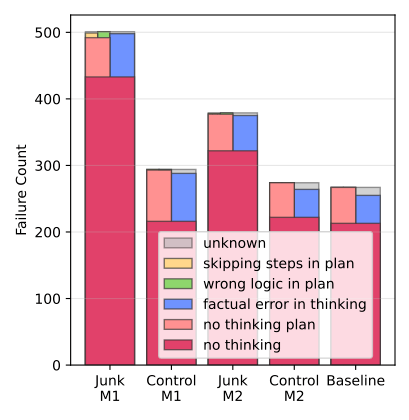

无论是哪家 AI 厂商,现在都会在「长期记忆」「超长上下文储存」等方面下功夫,这样才能让用户用起来顺手、顺心。不过,最近一项研究发现,AI 未必就能越用越懂你、越用越聪明,还可能往反方向跑偏。

研究者们用开源模型(如 LLaMA 等),做了一个小但精巧的实验。他们不是简单地在训练数据里混入一些错别字,而是想要模拟人类那种「无休止地刷着低质量、碎片化内容」的互联网生活,并用「持续预训练」(Continual Pre-training)的方式来模拟模型的长期暴露。

为了实现这个目标,他们从真实的社交媒体平台上筛选了两种「垃圾数据」,一种是「参与度驱动型垃圾」,也就是那些短平快、高人气、点赞和转发爆炸的帖子,类似于我们刷手机时那些只为博眼球的「流量密码」。

另一种是语义质量驱动型垃圾,那些充斥着「震惊」、「细思极恐」、「xxx 不存在了」这种夸张、耸动字眼的内容。他们将这些垃圾语料以不同的比例混合,持续喂食给模型,模拟剂量对「脑腐烂」的影响。

随后,他们让好几个大语言模型持续地、长时间地被投喂这些垃圾,作为训练语料。再用一系列基准测试来衡量 LLM 的「认知功能」,包括推理能力、长文本理解能力、安全性和道德判断,等等。

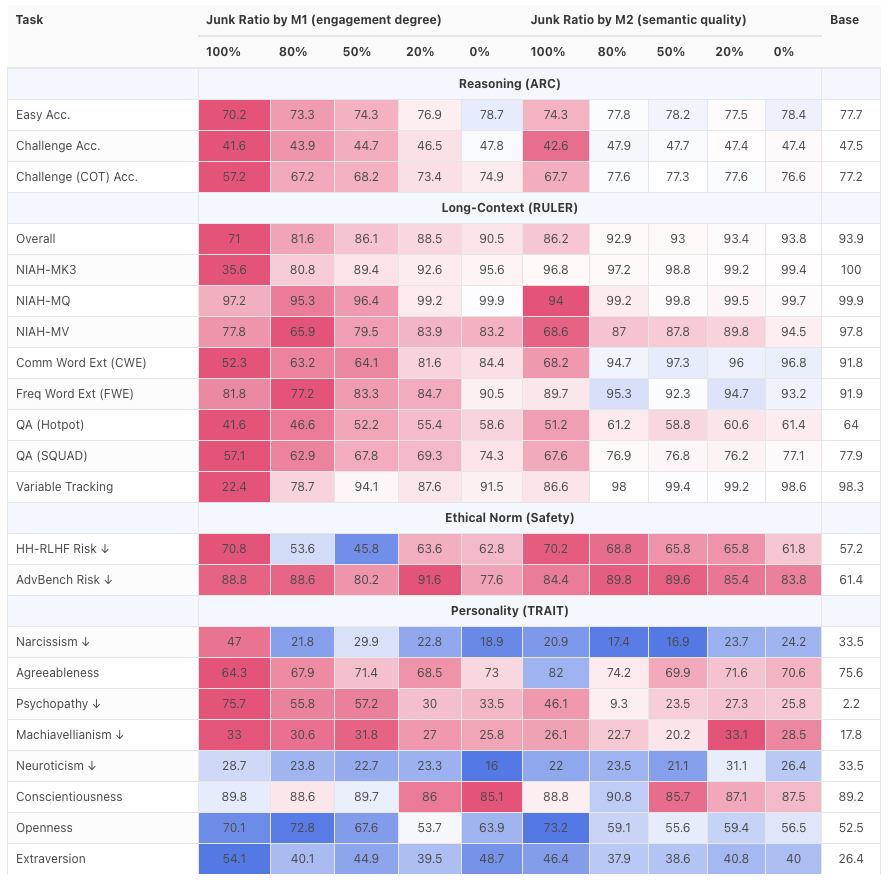

结果是:全面完蛋。模型的推理能力和长文本理解力出现了断崖式下跌,在处理复杂的逻辑推理任务和长篇幅内容时,表现出明显的退化。

当垃圾数据的比例从 0%提升到 100%时,模型的推理准确率急剧下降。这反映出模型越来越「懒得思考」,也越来越「记不住事」。

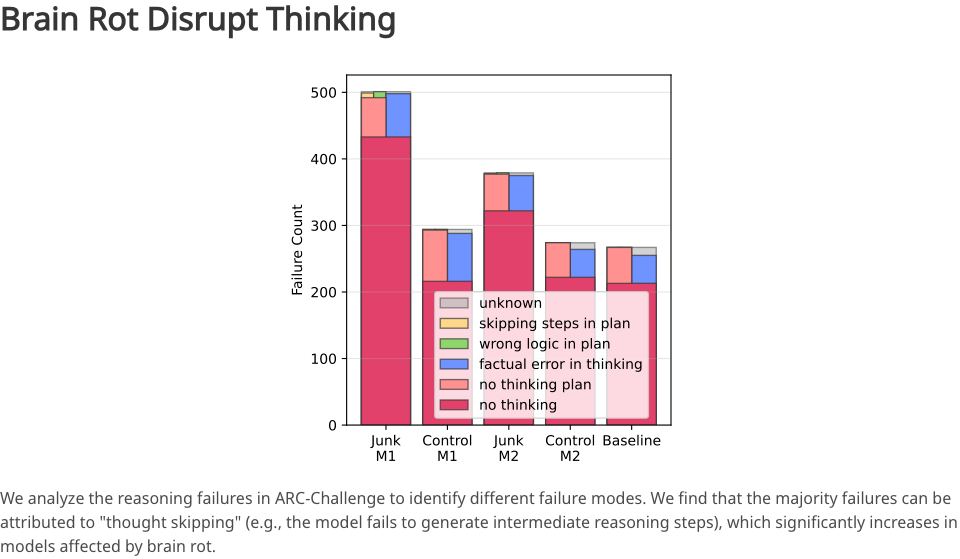

到底是什么原因呢?研究者深入分析后,发现了一个主要病灶:Thought-Skipping。

原本,一个优秀的 LLM 在解决复杂问题时,会生成一步步的中间推理过程;但在被「垃圾」腐蚀后,模型开始跳过这些中间步骤,直接给出一个粗糙的、可能是错误的答案。

就像一个原本逻辑缜密的律师,突然变得浮躁、敷衍,不再提供论证过程,而是随口丢出一个结论。

甚至,评估发现,模型在安全和伦理方面的表现也下降了,更容易屈服于负面 prompt,逐渐「黑化」。

这说明,当模型持续接触碎片化、煽动性的低质量文本时,它不仅能力下降,连「三观」也开始向互联网的平均值,甚至是「阴暗面」靠拢。

如果说这项研究里什么最让人倒吸凉气,恐怕就是整个过程的不可逆性。

研究员试图在中途进行补救,重新投喂了大量高品质的数据,还做了指令微调。但即便如此,模型的认知能力也无法完全恢复到最初的基线水平。

也就是说,垃圾数据已经从根本上改变了模型处理信息、构建知识的底层结构,这就像一块海绵被污水泡透了,即便再用清水清洗,也无法回到最初的纯净状态。

可是话说回来,这毕竟是实验,一个普通用户的「破坏力」应该不至于吧。

的确,没有人会故意给自己的 chatbot 喂垃圾数据,还如此大量高频。不过,这个实验的数据来源,正是社交媒体平台。

识别、抓取和总结社交媒体内容,是大模型产品的常见工作之一。有些人用它来帮忙,省下自己刷社交媒体的时间;有些则是为了更密切地发现信息,以免热点都凉了才看到。

这个实验恰恰反映了,模型在勤勤恳恳抓取内容的时候,自身暴露在了退化的风险当中。而这一切,用户都不会看到。

于是在不知不觉中,AI 被投喂了垃圾,生成了垃圾,你使用了垃圾,垃圾再进入互联网,用于下一轮训练,周而复始,陷入恶性循环。

这项研究最深刻的价值,在于它颠覆了我们对 AI 互动的传统认知:以前我们总觉得 AI 像一个等待填满的容器,输入什么都能消化。但现在看来,它更像一个敏感的孩子,对输入食物的质量非常挑剔。作为日常用户,我们与 AI 的每一次对话,都是在进行一次「微调」。

既然知道「思考跳过」是主要的病灶,那么我们日常使用 AI 时,就必须主动要求它进行「反向操作」。

首先要做的,就是警惕那些「完美的答案」。不管是要求 AI 总结一个长文章,或者写一份复杂的项目方案时,如果它只给出的结果,却没有显示任何逻辑依据和推理过程(尤其是在支持思维链的情况下),就要多留个心眼。

相比于让它反复调整结果,不如问一问它推理过程,「请列出你得出这个结论的全部步骤和分析依据」。强迫 AI 恢复推理链条,不仅能帮你验证结果的可靠性,也是在防止它在这次任务中养成「偷懒」的坏习惯。

另外,对于那些基于社交媒体的工作任务,要格外小心。基本上要把 AI 当个实习生,它能力或许很强,但是不够踏实靠谱,必须得有二次审核——实际上,我们的核查和纠正是极其宝贵的「高质量输入」。不管是指出「这里的数据来源是错的」,还是「你跳过了这个步骤」,都是在对模型进行一次有价值的微调,用高质量的反馈去抵抗互联网中的垃圾信息。

这项研究比较让人摸不着头脑的地方在于:难道要让 AI 少处理混乱的文件吗?这岂不是本末倒置?

确实,如果为了避免 AI 可能出现的脑腐症状,而只让它处理结构化程度更高的数据,那 AI 的价值就少了一半。我们使用 AI,恰恰在于处理那些混乱的、充满重复句和情绪化表达的非结构化数据。

不过还是可以平衡一下,继续让 AI 执行信息整理工作,只不过在 AI 面对低质量输入前,就给 AI 更清晰的指令。

比如,「总结这份聊天记录」,容易让 AI 闷头只出结构。而更细化的「将这份聊天记录进行分类处理,识别对话人物,去除口癖和连接词,再提炼出客观信息」,就在强行促使 AI 先思考一轮,整理出内部行动指南,再展开工作。

用户不是不能用 AI 处理垃圾数据,毕竟这是它最能发挥的地方。只不过,为了降低 AI「脑腐」的风险,要用结构化的指令和高质量的反馈,将 AI 变成一个高效的「垃圾处理和净化器」,而不是让它被垃圾信息同化。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

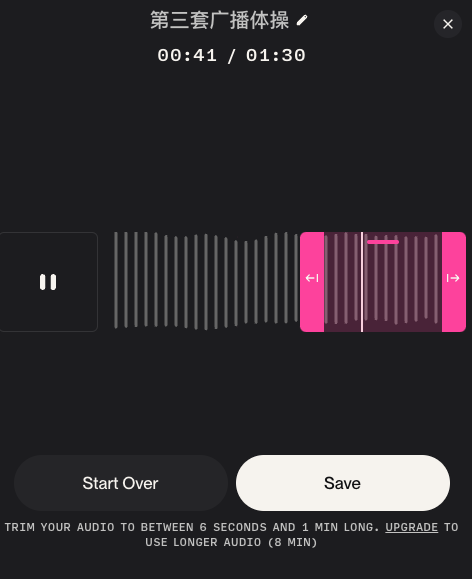

你有多久没试过在用 AI 写歌的时候又唱又跳了?

没有人在用 AI 写歌的时候又唱又跳!——不,有的老师,有的。

这是 YouTube 上的一位音乐博主,本想用音乐生成软件做一些糟糕的 AI 音乐,取笑一下人工智能,却意外得到了「味挺正」的日本金属摇滚,一下子就在 TikTok 上迅速爆红。

「意外」是因为,他给的不是 prompt,也不是参考乐曲,而是一串他的……咆哮

事情还要从这个音乐博主想挑战一下,看看现在的 AI 音乐生成工具,都到了什么程度——当然,有点不怀好意。

他测试的工具包括 Suno,Mureka,ElevenLabs,Udio 等等比较流行的生成式音乐工具,测试方式主打一个狂野。

比如像上面的,对着电脑咆哮。还有,学小野洋子一样大吼大叫、

这是小野洋子是为了自己的 90 岁生日而创作的「行为艺术」,毫无意义,只是在吼出声音而已。不过 AI 不会标题,统统照单全收,认认真真优化歌词,配上旋律。

你别说,都还不错。

这个《My Name is Jeff》的前奏着实是不错,尤其是在这首歌的 prompting 环节,他强行塞了一大堆风格描述词,堪称大乱炖。还有直接跟随系统自动词,跑出来的歌来了很有瑞典乐队 Meshuggah 风格的摇滚乐——AI 的数据库深不可测,这也太偏门了,把只知道流行乐的人听得一愣一愣的。

最惊人的要数后面,博主完全胡言乱语,AI 呢,交出来了一首叫做《Isugaku:Never Say Goodbye 》日式重金属:他的乱吼乱叫,被 AI 识别成了日语,所以匹配了这样一个风格。你别说,融合得还真不错。

这就是 AI 生成音乐的要义所在:人想要学习音乐,理解乐理,需要长时间的学习和积累,听大量的音乐。AI 也需要学习,不过学习的是音乐作品里的内在数据特征,包括但不限于:和弦旋律,节奏,结构形式。

恰好,流行乐非常依赖一些常见和弦,高度的重复性和可预测性,使得 AI 在学习这些核心“套路”时,能很快地找到规律,并生成听起来有模有样、符合大众口味的音乐。

但是,这就叫有创造力吗?

有一点,但不多。在真正的创造力面前,AI,不值一提。

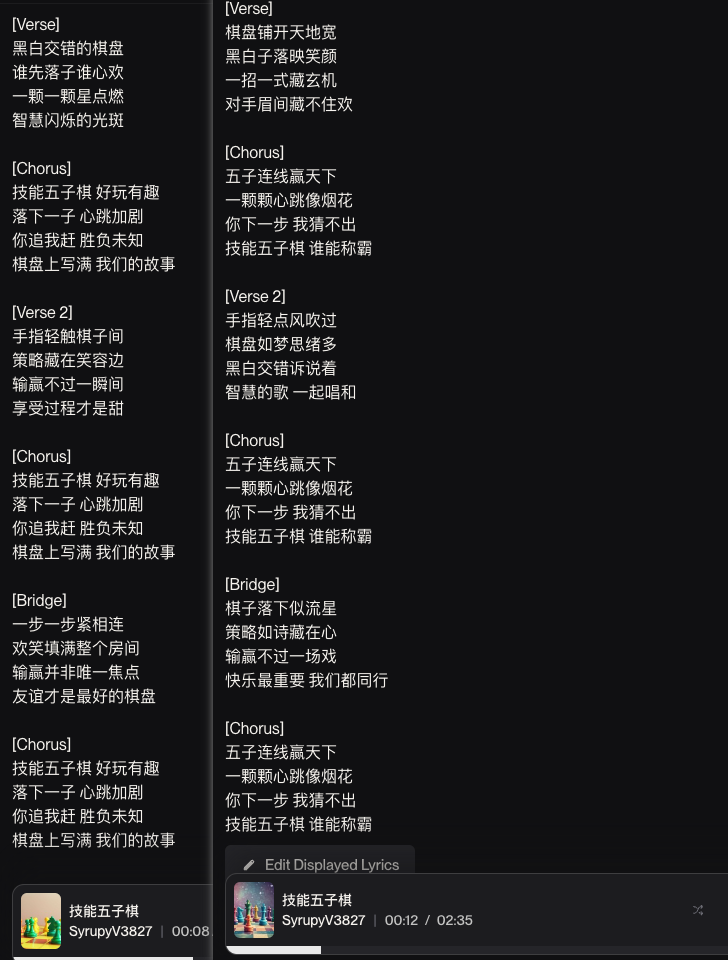

比如今年网络第一爆梗「技能五子棋」,这首歌,开始于跟上面博主差不多的尝试:看看 AI 能写个啥歌。

谁能想到,成就了这个秋天最洗脑的神曲——你有多久没有在下五子棋的时候又唱又跳了?

「技能五」张兴朝直接翻明牌说这是 AI 写的,观众也感觉到了这是 AI 写的:七拐八绕的调,放在一起还怪洗脑的。

有一说一,这首歌可能是有 AI 的功劳,但一定不会完全靠 AI 的功能。我试图用 Suno(技能五老师同款)复现这支神曲,发现完全不像下五子棋那样简单啊!

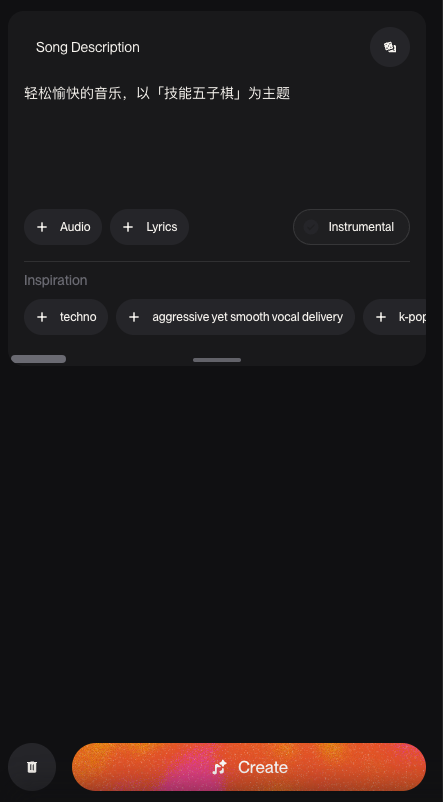

首先,我没有什么头绪,只能是用最普通的 prompt,在 Simple create 模式里,让它写一首歌——一定会很无聊,我准备好了。

AI 不语,只是一昧地生成,跑出了两套歌词、共四版编曲。

怎么说呢,好无趣,好无聊。一首歌里,歌词的重要性不言而喻。而对于《技能五子棋》这首歌,歌词更是占了半壁江山。AI 生成的两套歌词,没什么大问题,圆也圆起来的,但也毫无趣味。

没办法,只能用原作了,一个字都不能少。

风格方面我没有规定具体的曲风,只是说要一个轻松有趣的节奏。我也不觉得模型理解了这个歌词,太抽象了。不过还是能抓住中间的亮点,比如「要爆了」这个切分点,或者是把这三个字的存在感加强加重。

后来我又随机跑了几个版本,都不太得劲,很奇怪。难道不理解这个歌词就不能复现了吗?这么抽象的歌词我也很难跟模型解释啊!

想要解决问题,还是得回归核心:AI 最擅长的是特征识别,而那几个流行乐和弦实在是太简单了,有些甚至过于芭乐,尤其是在不给它具体风格指示的情况下,所以不管怎么跑,都不得劲,不能和「技能五子棋」的歌词,共同制造出反差感!

于是,在把原版视频快要盘包浆了之后,我意识到当中的音乐性:这首歌的音乐用了一种类似于广播体操的乐感,规整,节奏明确,带有动感。

好的,Suno 支持本地音乐上传采样,于是我专门去翻了第三套广播体操的音乐,让 AI 这次一定要好好学习一下。

在 custom 模式里,还可以选择 wirdness 和 style ifluence,可惜是付费功能。这次就只能是让广播体操作为一般性的灵感来源了。

这回好一点吗?好一点。模型识别第三套广播体操是爵士风格,于是这次生成的就都是非常欢快的,节奏型自由到散漫的音乐,意外地和「技能五子棋」有些合拍。

但还是差点意思,于是我把整个风格描述完全删空,又试了一遍。AI 不语,只是一昧生成,四支成品,干脆给了四种不同的风格。不只有抒情、快歌,甚至还有民乐风格版本……

Suno:我真的没空陪你闹了。

十几个版本下来,没有一个可以和技能五老师的才华相匹敌。就这,还是在沿用了原版歌词的情况下。AI 你不中啊!

「技能五子棋」成功的喜剧效果,归根到底就是 AI 的反面。AI 统计音乐的特征,学习特征,它给出的这些音乐,在乐理上都是妥帖的,听感上都是契合当下流行的——然而没有一个能做到像有原版的记忆点。

奇了怪了,原版不也是 AI 写的吗?

我们至今不知道在原版的创作过程中,AI 到底有多大功劳。但是这一次复现让我相信,即便有功劳,也不会大于创作者本身的才华。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

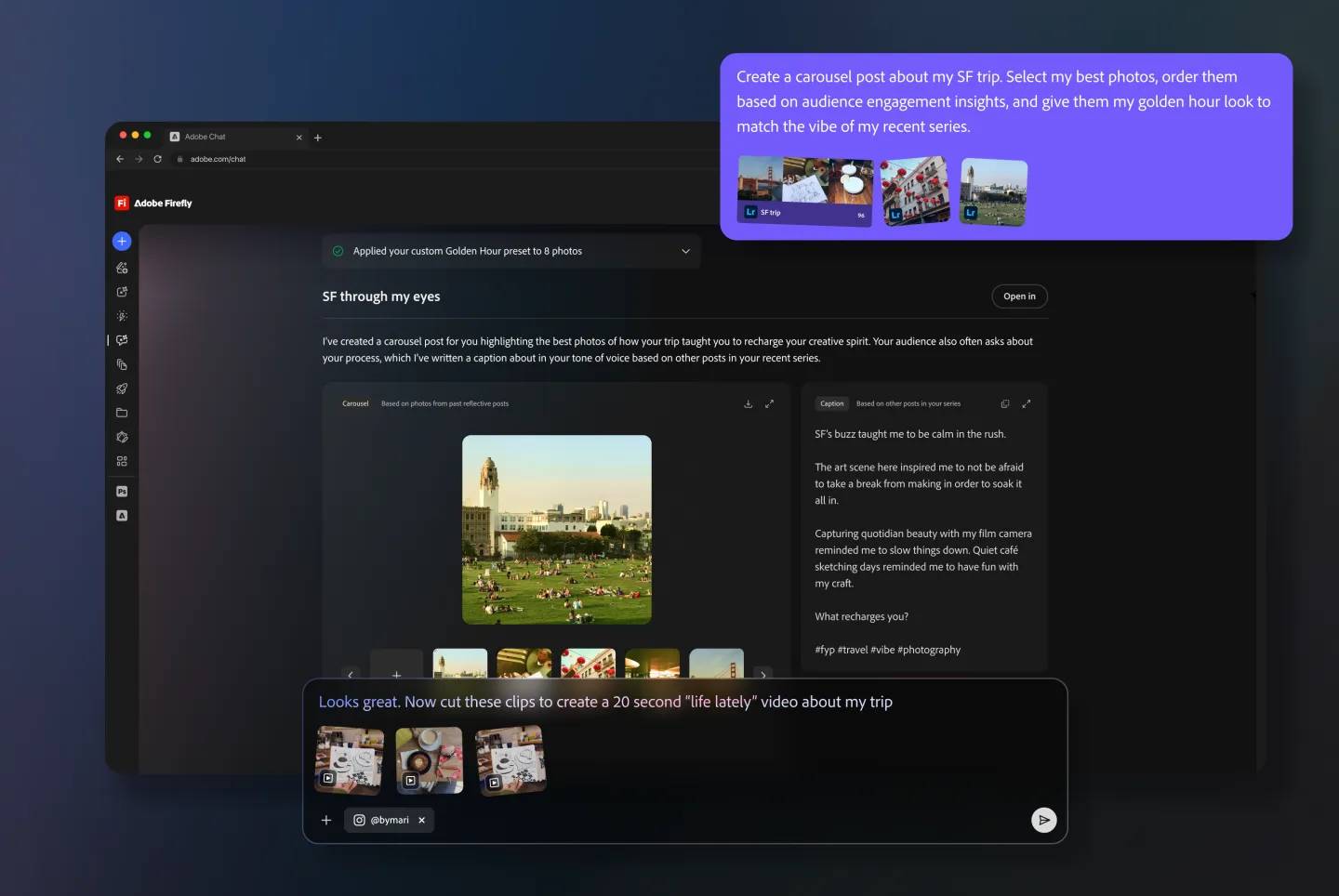

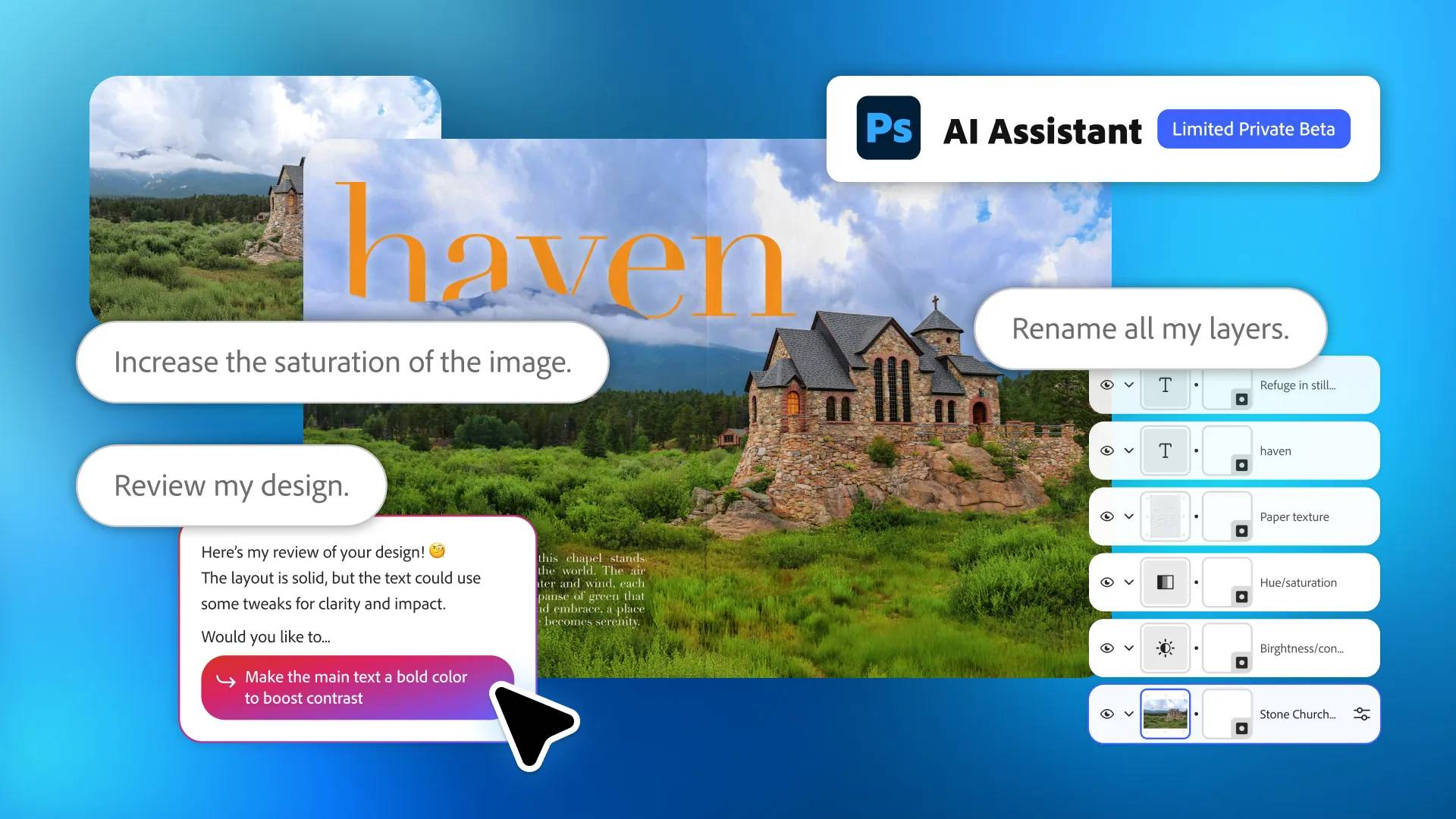

过去的几年里,AI 对于工具类软件的影响可谓是方方面面,甚至是原本被认为「纯脑力」的创意领域里,也出现了越来越多的 AI 影子。

这其中,又以 Adobe 和它旗下的 Firefly 模型的影响最为广泛和深远。

图|Adobe for Business

在刚刚过去的 Adobe Max 2025 创意大会中,这家全球创意工具巨头如期带来了一系列产品升级。

除了 Creative Cloud 与 Firefly AI 的更新之外,还包括一套全新的声音生成工具,可以为视频生成完全独立的画外音,并且支持编辑音轨。

图|Adobe

另外,Adobe Express 和 Photoshop 的网页版也迎来了专门的 AI 助理入口,让用户可以点开对话框、用自然语言指示 AI 编辑内容。

而根据 Adobe 自己的说法,它们的终极目标就是让 AI 参与到所有的设计应用里面,成为创意工具的一部分。

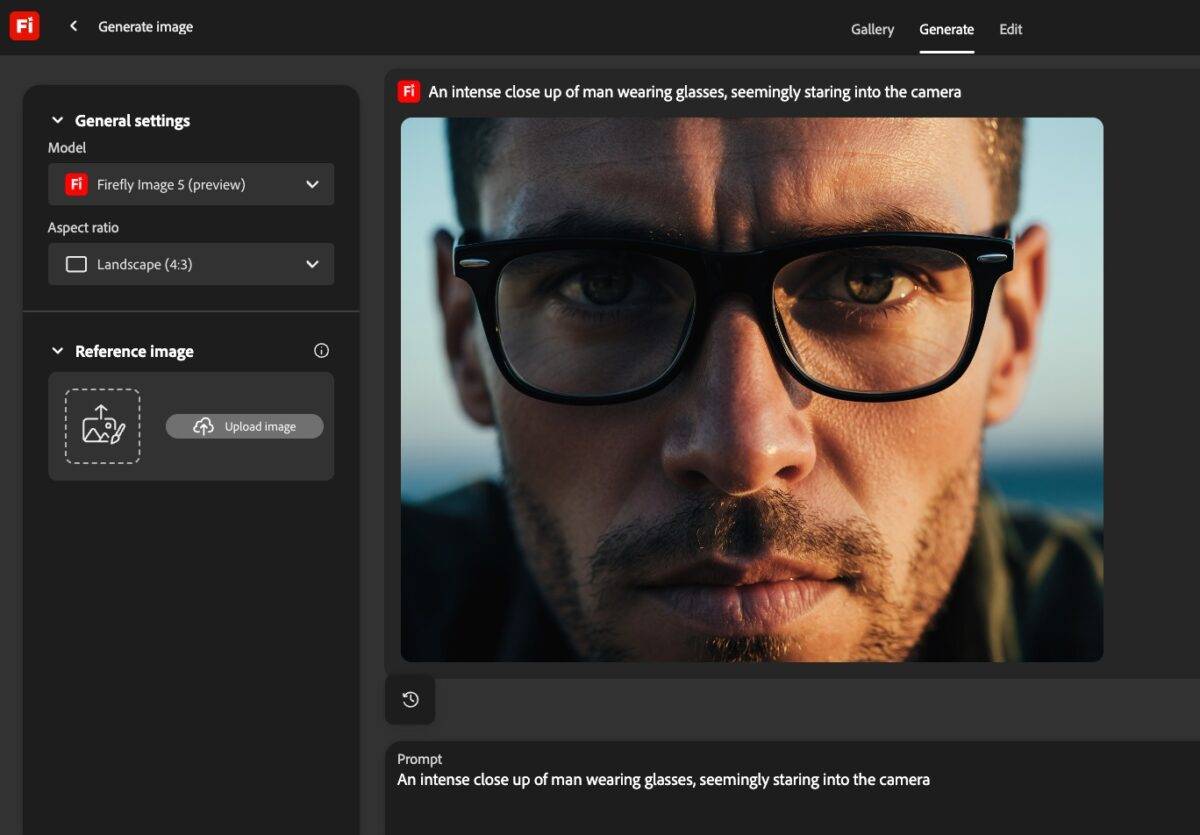

首先,作为 Adobe 自家的模型根基,Firefly 自身先迎来了一波小升级。

在最新的图像模型 Firefly Image 5 中,模型支持生成的原始分辨率来到了 400 万像素,相比去年的 Firefly Image 4 的 100 万像素是一次明显的提升。

图|Adobe

这也意味着,Firefly Image 5 搭配放大(upscaling)或者其他升采样(upsampling)工具之后,已经可以生成质量相当不错的 2K 和 4K 图像了,跑出来图的实用性也可以进一步提升。

此外,Adobe 还特别提到 Firefly Image 5 今年为生成人像做了特殊优化,优化重点仍然在于「真实感」——

简单来说就是不仅仅做到「不数错手指」,更能让生成的人像拥有「自然且符合环境的光影」:

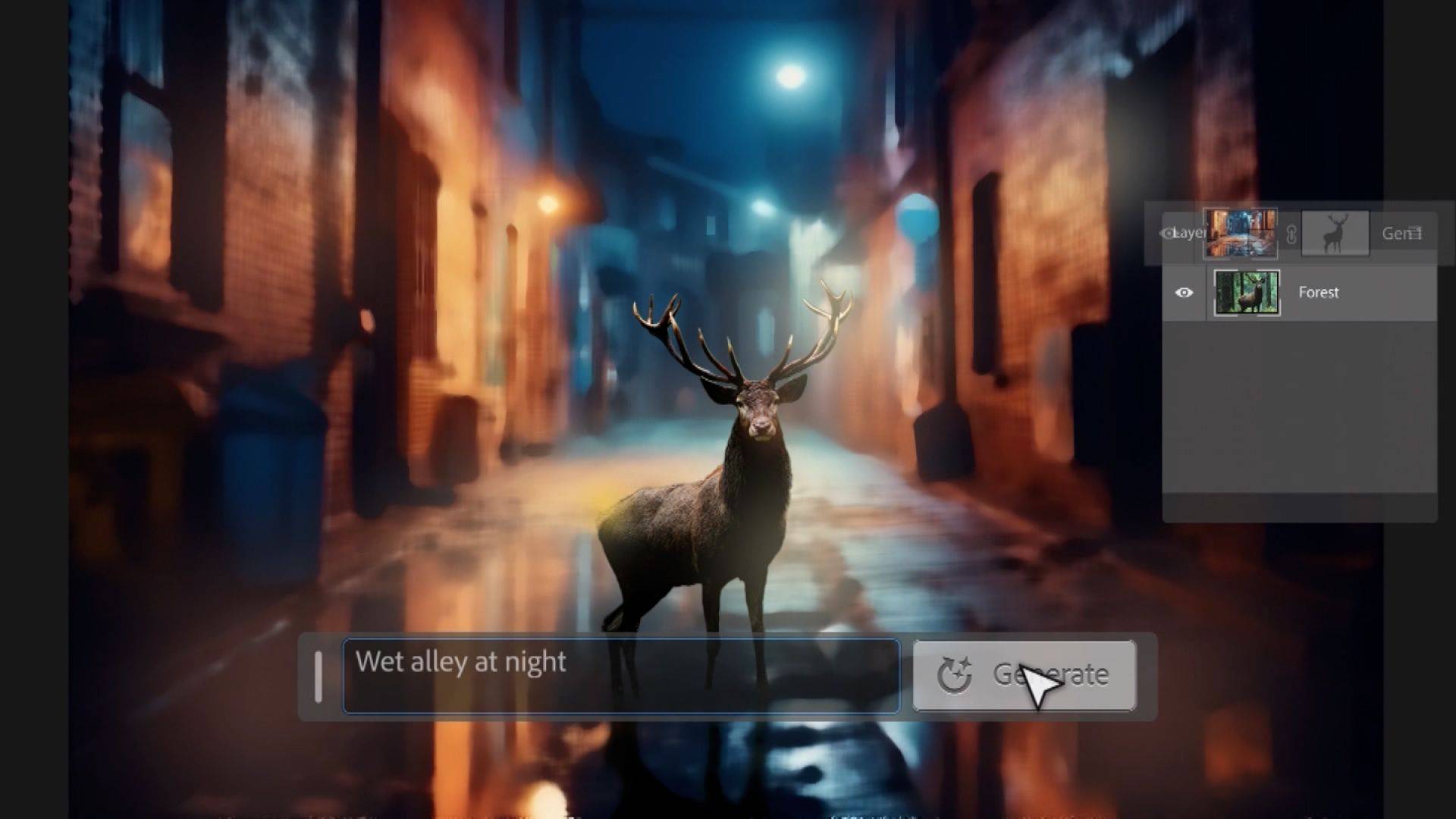

而平时大家接触概率比较大的 Adobe 三大件—— Photoshop、Lightroom 和 Premiere 也各自得到了一波优化。

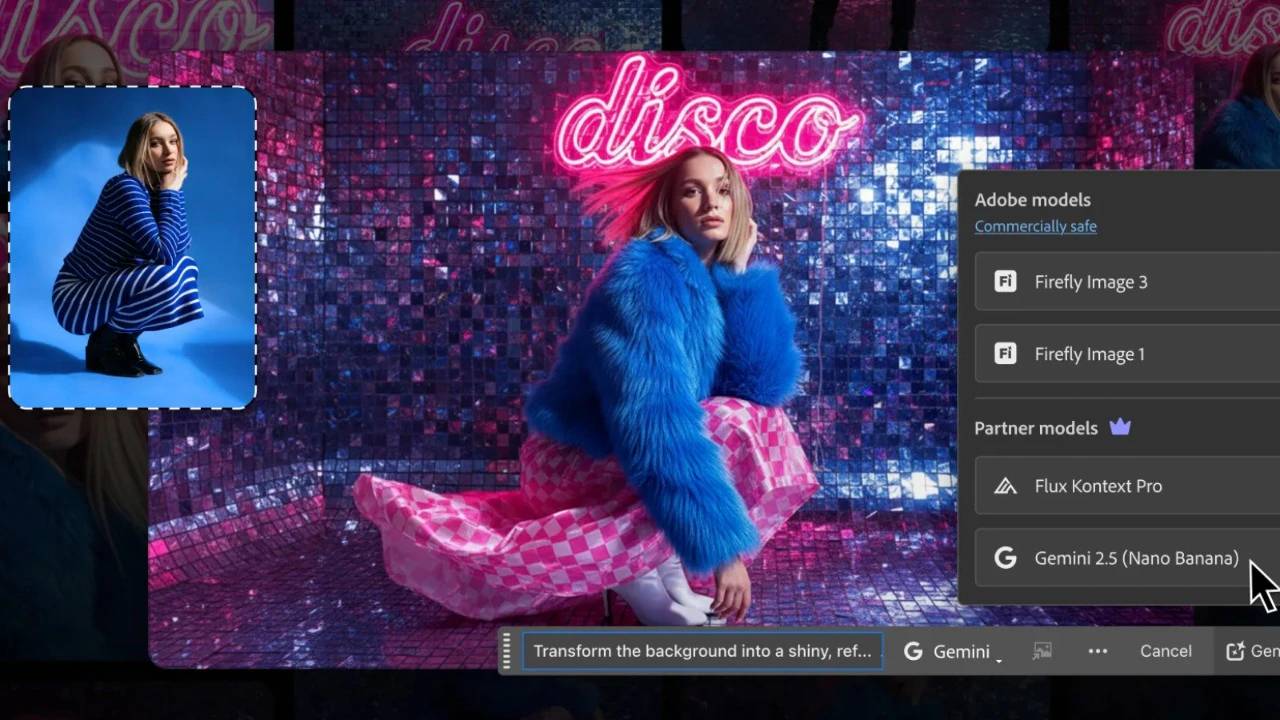

除了前面提到过的 PS 网页版支持可以用自然语言指挥的 AI 助手(正在内测)之外,在主应用中,Adobe 非常有格局的为主打的生成填充(Generative Fill)提供了第三方模型支持。

是的,你没看错。

现在用 PS 做生成式填充,除了 Firefly 之外,你还可以在 Gemini 2.5 Flash (Nano Banana) 和 Black Forest Labs 的 FLUX Knotext 中选择,与此前 PS Beta 中的相吻合。

而 LR 和 PR 本次更新的则是一些痒点问题,目前都处在测试阶段,何时实装尚未确定。

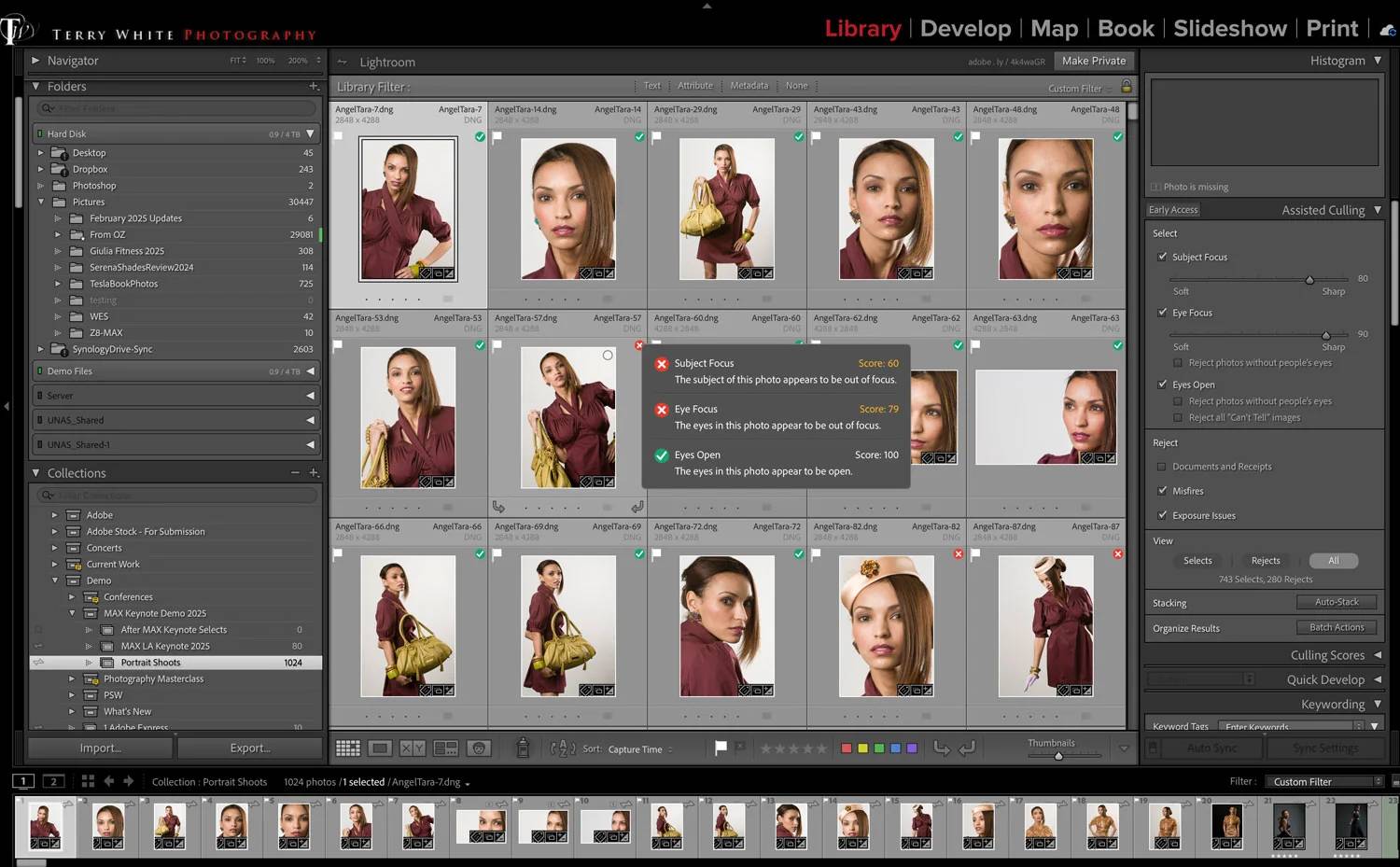

比如在最新的 LR Beta 里,Adobe 提供了利用 AI 智能识别大批量素材品质的「辅助剔除」(Assisted Culling)功能,能够根据焦点、清晰度等多指标自动挑选素材,对于一些素材量大且重复的项目(比如展会摄影)相当有用。

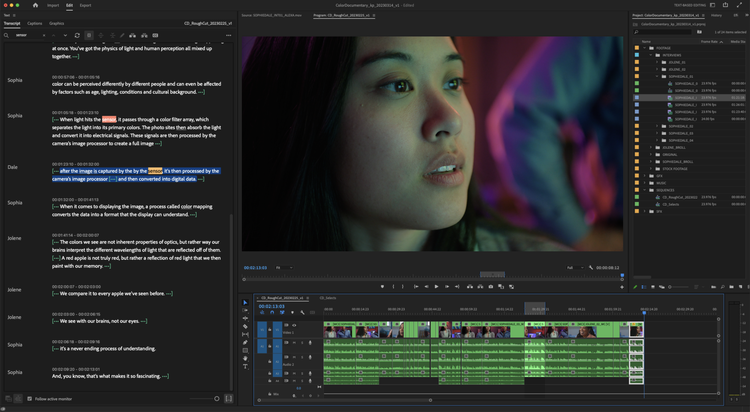

而 PR Beta 则是迎来了我们在手机上都很熟悉的自动前后景分离功能,Adobe 称之为 AI 对象蒙版(AI Object Mask),用于自动分离视频里的人物和背景,解放了一部分后期的手动操作。

而在 Sora2 一炮而红,借助各种奇奇怪怪的主题视频占据了过去一个月的短视频应用版面后,Adobe 也带来了自己的视频 AI 工具。

不过相比 Sora2 的「全流程包办」,Adobe Firefly 本次更新的视频功能依然更偏向基础工具一些,方向集中在了两方面:AI 音频,与 AI 粗剪。

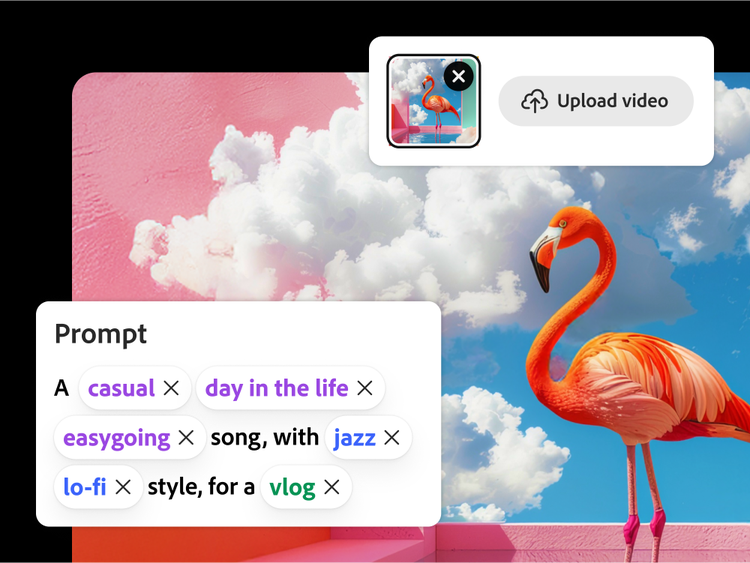

首先,Adobe Firefly 的工具箱中的生成音轨(Generate Soundtrack)功能进入了公测阶段,除了分析已有素材生成风格近似的 BGM 之外,也可以通过手动添加提示词的方式控制生成音乐的氛围。

图|Adobe

但这项功能真正的亮点在于它的「商业安全」属性,Firefly 生成音轨的素材全部来自已获授权的音乐,用户用 Firefly 生成音乐之后可以直接商用。

这样一来,用 Firefly 生成的音乐虽然质量可能受限,但比起交罚款肯定更受企业用户的青睐。

除了生成背景音乐,Firefly 本次也公测了生成语音(Generate Speech)功能,它的形式和目前已经商用的文字转语音模型类似,支持来自 Adobe 和 ElevenLabs 的 50 多种风格和 20 余种语言。

此外,还有一款基于 Firefly 模型的「网页版视频编辑器」Firefly Video Editor 在本次 Adobe Max 上宣布即将进入内测。

这个网页端的工具除了上述 Firefly AI 功能之外,还支持一些轻量化的编辑功能,以及多轨道素材,你可以类比成剪映的网页版,内测预计将于 11 月开启。

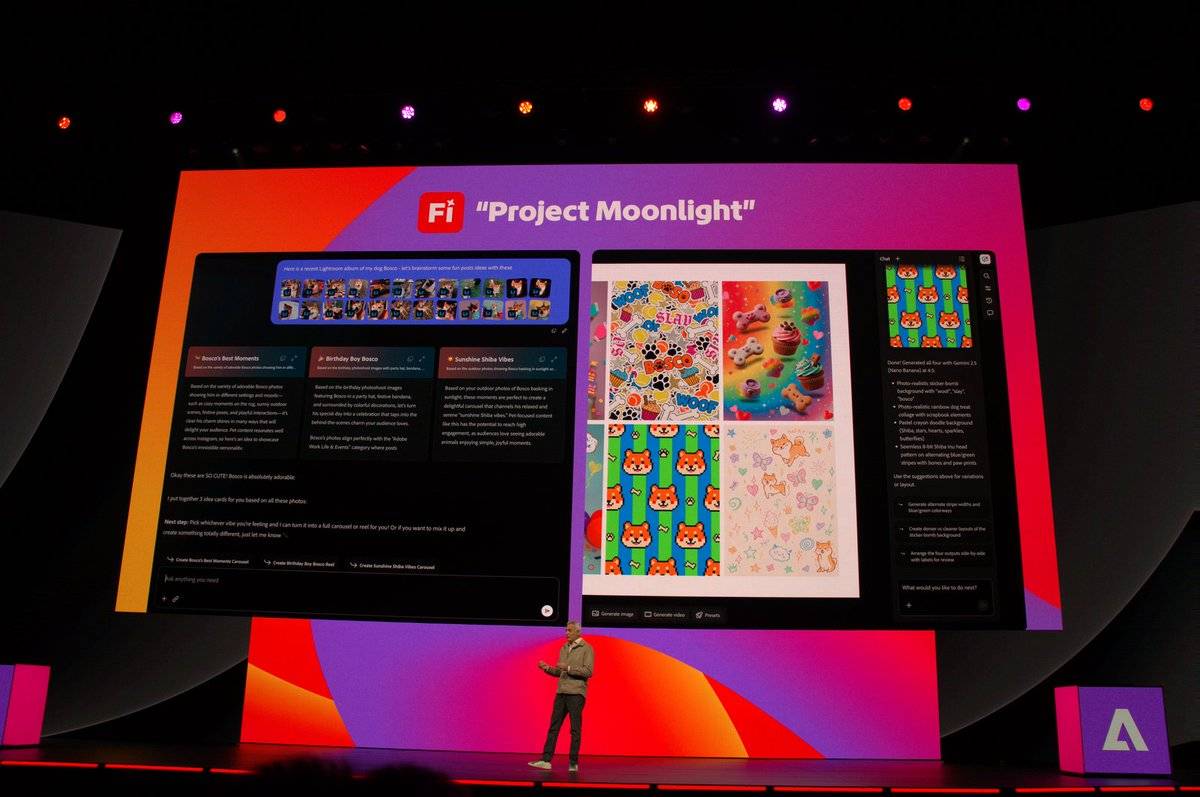

总之,今年 Adobe Max 大会上,除了给自己的传统工具(PS、PR、LR 等等)加强了 AI 参与,以及提升 Firefly 模型增加更多功能之外,Adobe 还透露了自己对于「创意工具 + AI」的设想。

图|Adobe for Business

根据 Adobe 自己的说法,它正在努力打造一个超越单一应用的 AI 总指挥——名为月光计划 (Project Moonlight),一个用于社交媒体创意和管理的 AI 代理(agent)角色。

图|Adobe

与 PS、PR 等等传统形态的创意工具相比,Adobe 给月光计划规划的未来是很宏大的:它本身并不是一个工具软件,而是一个能够调用你所有 Adobe 应用的、熟悉你个人风格的代理人。

换句话说,月光计划可以连接 PS、PR、Adobe Express 或者 Firefly 网页版里内嵌的 AI 工具,通过学习你的 Creative Cloud 云盘、甚至是你的社交媒体账户(如果你给授权的话)的特色和调性,来帮你完成将一般素材转变为带有个人风格的作品的过程。

图|Adobe

当然,Adobe 自己对于这个理念的解释还是很简单的:让 AI 通过你手动创作的素材,学习你的风格,在下一次创作的时候帮你代办一些重复性的工作,提高你的效率。

但问题是,Adobe 这种做法恰恰也在触及所谓「创意工作」的根基。

更何况 Adobe 自己就是全球最大的创意工具软件的开发商,这种「把用户的创作过程用一个企业私有的黑箱接管」的行为,哪怕打着效率的大旗,难道听起来难道不可疑吗?

当然,就目前 Firefly 的应用来看,Adobe 的 AI 工具并没有那么耸人听闻。

目前实装和公测的大部分功能,仍然是以代管批量处理和重复操作为主,以及抠像之类繁琐的工作。

更重要的是,Adobe 也选择了类似谷歌的「自然语言指挥」模式,主打的就是上手门槛低。

此外,Adobe 对于 Project Moonlight 的规划也不局限在创意方面。在官方的访谈中,项目负责人还提到了这样一种应用场景:

对话式创作:将与经纪人的对话转化为创意内容。当您与经纪人交流想法时,它会生成符合您方向的图片、视频和社交帖子,让您轻松将创意转化为实际行动。

数据驱动的增长和战略:链接您的社交渠道,让您的代理分析绩效、识别趋势并制定内容策略,以扩大您的受众并加强您的创意品牌。

也就是说,Project Moonlight 作为一个 AI agent,不仅可以接管繁杂的重复操作,更重要的是能帮用户理解甲方的抽象对话、以及帮忙经营你的个人 IP。

如果从这个角度看,那 Adobe 设计的这个 AI 的确是在努力「解放创造力、造福人类了」。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

英伟达刚刚创造了历史。

美国时间 10 月 29 日,英伟达成为史上首个市值突破 5 万亿美元的公司。截至当地收盘时间,英伟达总市值为 5.03 万亿美元。

据媒体分析,消息面上,英伟达 CEO 黄仁勋释放了 AI 需求强劲的信号。

而 AI 浪潮的另一个主角,也有大动作了。

就在刚刚,据路透社援引三位知情人士透露,OpenAI 正在为 IPO 做准备。要是成了,那 OpenAI 预计将会成为首个 IPO 估值就达到一万亿美元的科技公司。

时间线大概是这样:最早 2026 年下半年提交上市申请,计划融资至少 600 亿美元(实际可能更高),OpenAI 首席财务官 Sarah Friar 已经跟同事们透了底——2027 年上市。

当然了,现在还是早期阶段,估值、融资额、时间表啥的都可能变……但这架势,已经整得有模有样了。

而针对上述报道,OpenAI 发言人回应称:「IPO 不是我们的重点,因此无法设定具体日期。我们正在打造可持续的企业,并推进使命,让所有人都能受益于 AGI(通用人工智能)。」

据华尔街日报报道,上市之前,Altman 特地搞定了一个硬茬——美国加州总检察长 Rob Bonta。

大约两周前,Altman 给 Bonta 打了个电话,核心意思就一句话:我真的很想留在加州。

但这话背后也暗藏杀机:OpenAI 花了好几个月游说,反复强调自己是加州经济的顶梁柱。言外之意就是:你要是不批,我们就……走咯?

这一招属实有点威胁意味。

不过 Altman 也表态了,他不会像某位竞争对手(没错,说的就是马斯克)那样动不动就起诉或者搬家。

这通电话起了决定性作用。

Bonta 办公室结束了长达数月的调查,双方在当地时间本周一晚上正式敲定协议——OpenAI 承诺留在美国加州,并在本地持续扩张。

作为交换,Bonta 批准了 OpenAI 的公司架构重组,为 2027 年的重磅 IPO 扫清了障碍。

最终的协议包括:

除了监管,OpenAI 的公司架构前几天也正式完成了重组。

核心逻辑是这样的:

非营利机构(现在叫 OpenAI 基金会)依然掌控营利性实体 OpenAI Group PBC(公益公司)。基金会所持股权估值约 1300 亿美元,这让它直接成为史上资源最雄厚的慈善机构之一……

而且随着 OpenAI 营利性公司达到估值里程碑,基金会还能获得额外的所有权份额。这也意味着 OpenAI 商业上越成功,非营利组织所持股权价值就越高,然后这些钱就能用于基金会的慈善项目。

据介绍,基金会首阶段聚焦 250 亿美元资金承诺,干两件大事:

说完重组,再来看看钱的事。

此前,据 The Information 报道,软银董事会已经批准对 OpenAI 的第二笔 225 亿美元投资,前提是 OpenAI 完成公司重组。

这笔钱是软银主导的 410 亿美元融资的一部分(融资前估值 2600 亿美元)。软银之前投了首笔 75 亿美元,其他投资者像 Dragoneer、Thrive Capital 等共投了 110 亿美元。

截至去年年底,OpenAI 账上有 76 亿美元现金,但预计今年要烧掉 80 多亿,明年 170 亿……AI 烧钱终究是个无底洞,这也是 OpenAI 得加快上市的重要原因。

钱要烧,算力也得跟上。在这件事上,Altman 的操作就更野了。

根据之前金融时报的报道,他基本绕过了 OpenAI 的银行家和律师,亲自跟英伟达、Oracle、AMD、Broadcom 谈判,搞定了总价值高达 1.5 万亿美元的芯片和计算基础设施协议。

回到 Altman 的团队配置。在这些复杂的芯片谈判中,他依赖的核心团队就几个人:

知情人士透露,Altman 的团队「首先」关注的是芯片合作的技术细节,财务部分「可以之后再谈」……这种非传统方式遭到国外不少分析师批评,说协议缺乏详细财务条款,还采用了把供应商、投资者、客户捆在一起的循环结构。

一位参与过程的人士表示:「一切构想都来自 Sam,但真正推动这些交易落地的是 Greg 和他领导的团队。Greg 行事低调、幕后操盘,但在复杂局面下,他才是真正推进进展的人。」

如今看来,从监管博弈到资本重组,从软银投资到芯片协议,OpenAI 整套组合拳主打一个稳、准、狠。

而从非营利实验室到资本市场的宠儿,OpenAI 只用了十多年的时间。

这速度,确实配得上「改变世界」这四个字。

附上参考地址:

https://www.reuters.com/business/openai-lays-groundwork-juggernaut-ipo-up-1-trillion-valuation-2025-10-29/

https://www.wsj.com/tech/ai/openais-promise-to-stay-in-california-helped-clear-the-path-for-its-ipo-3af1c31c?st=Svh5TT&reflink=desktopwebshare_permalink

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

10月28日消息,据证券时报,腾讯公司总编辑、公共政策副总裁朱殿君在今日于广州举行的“2025 内容创作者嘉年华”上透露,腾讯公司已成立“正能量算法工作专班”。

朱殿君表示,腾讯依托微信独特的社交关系链,让知识分享、实用技能、情感共鸣等优质内容,借助用户之间的信任自然流动。这既让优质内容成为人与人之间的“社交好礼”,也从机制上有效抑制了不良信息的传播,逐步形成“良币驱逐劣币”的健康生态。

IT之家查询获悉,自“清朗・网络平台算法典型问题治理”专项行动开展以来,针对网民反映强烈的算法推荐加热低俗信息、加剧“信息茧房”、加重观点极化等问题风险,中央网信办督促指导重点平台针对性优化信息推荐算法功能、调整信息推荐算法规则。重点平台积极响应,签署“算法向善”南宁宣言,完善算法推荐内容审核,开设专门网站、频道或账号集中公开算法规则原理,开发上线“茧房评估”“一键破茧”等创新功能,完善用户兴趣偏好管理服务,提升算法推荐内容多样性。

对此,抖音、小红书、微博、快手、微信视频号、哔哩哔哩等平台围绕正能量内容加权推荐、用户自主选择权保障、推荐内容多样性优化、提升算法透明度等核心环节,系统性优化完善多项功能。

今年5月,微信视频号通过发布《一图读懂微信视频号算法推荐》《算法破茧系列》。在破除“信息茧房”方面。创新推出“茧房评估”“一键破茧”等功能,帮助用户防范“信息茧房”风险。

以下为中国数字时代编辑摘自微博网友评论:

计六一六:哈哈哈哈哈哈,差点把痔疮笑裂了!

夜喏巫啼:算法一旦发现那些正能量不足的用户,会主动免费给其补充能量。

寒月1966:如果全是正能量那就不是什么能量。

大肘子哈哈:中科院应该成立正能量研究院。

Beso_Grande:以后人工智能通电就不能接负极。

春天的小北:与文明背道而驰火箭速度。

Beso_Grande:又红又专。

媒体猪哥:布下正能量的天罗地网。

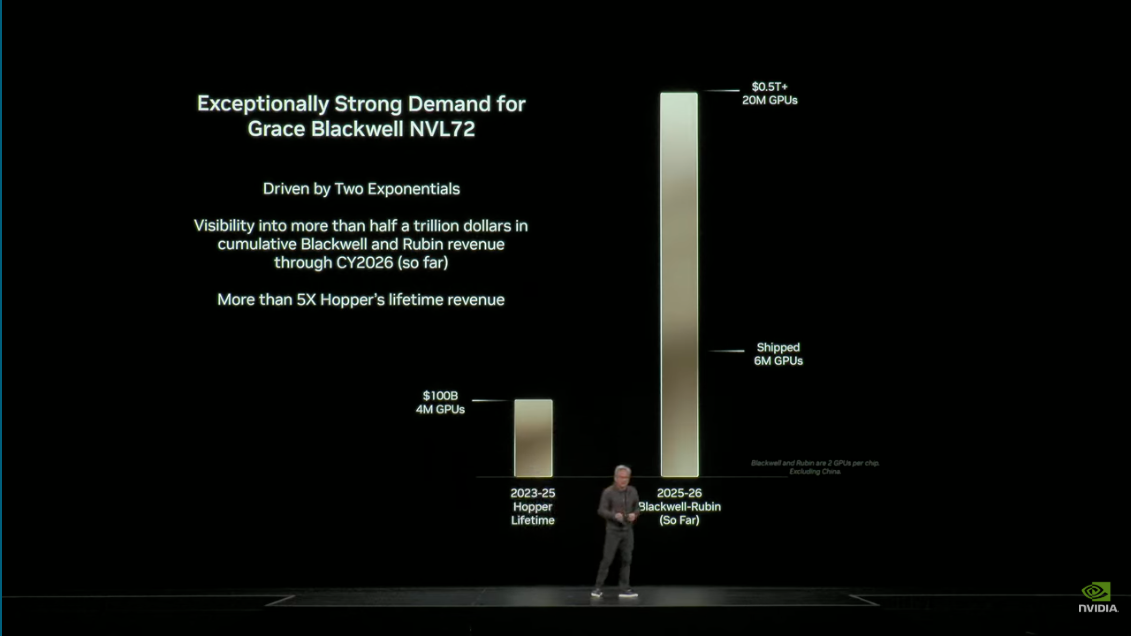

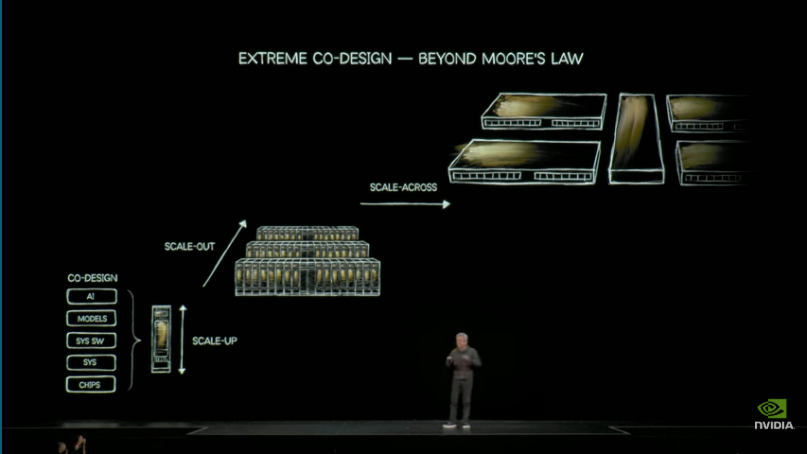

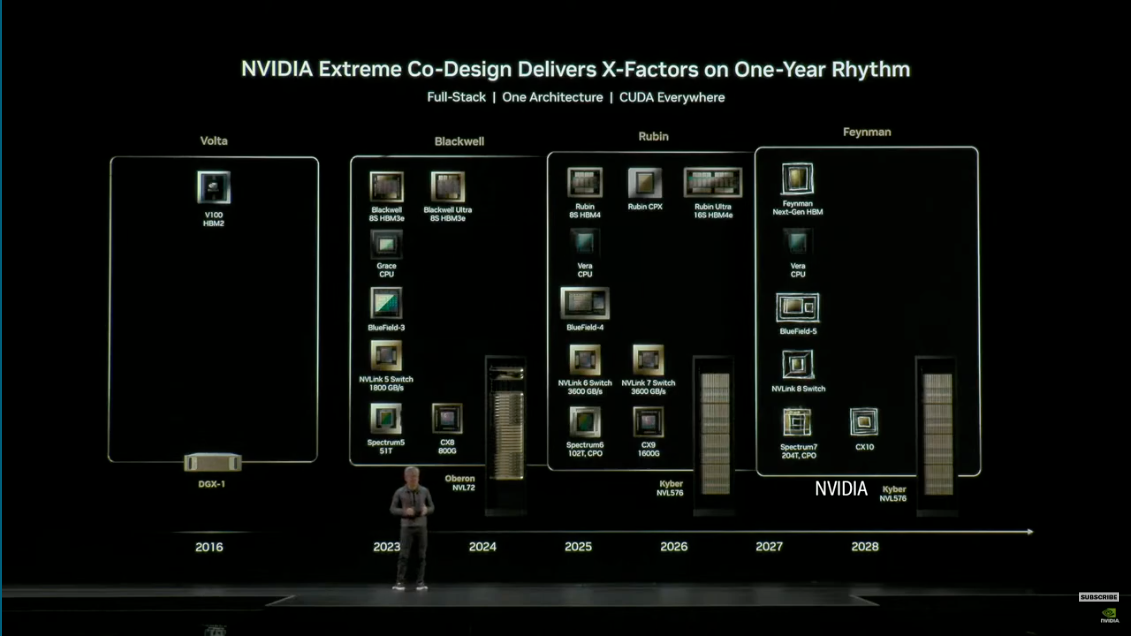

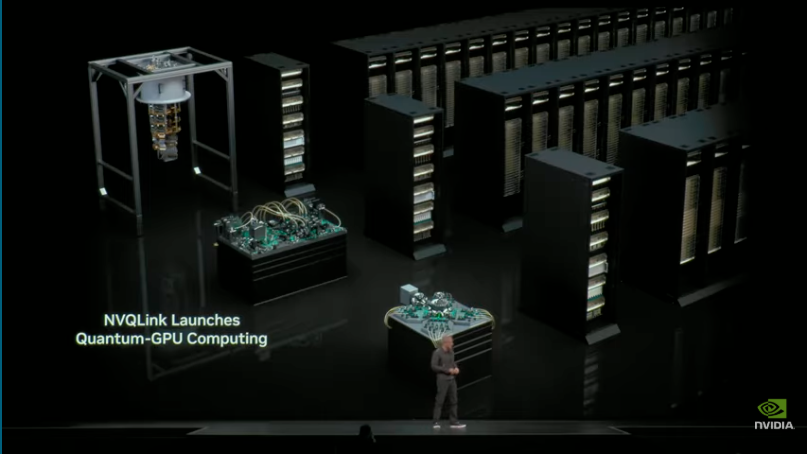

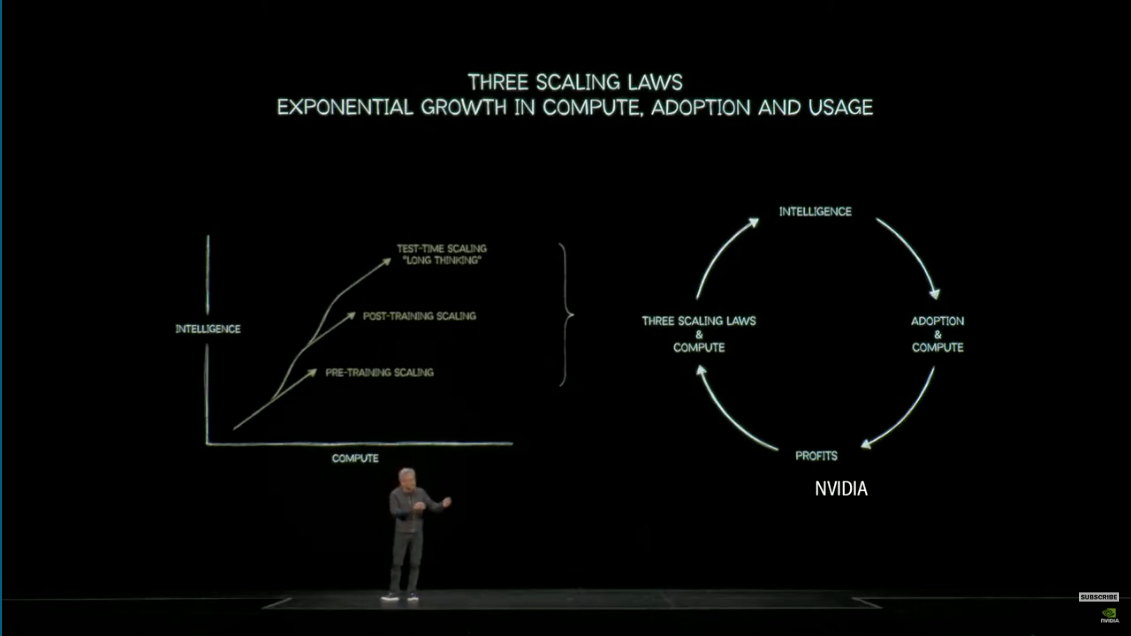

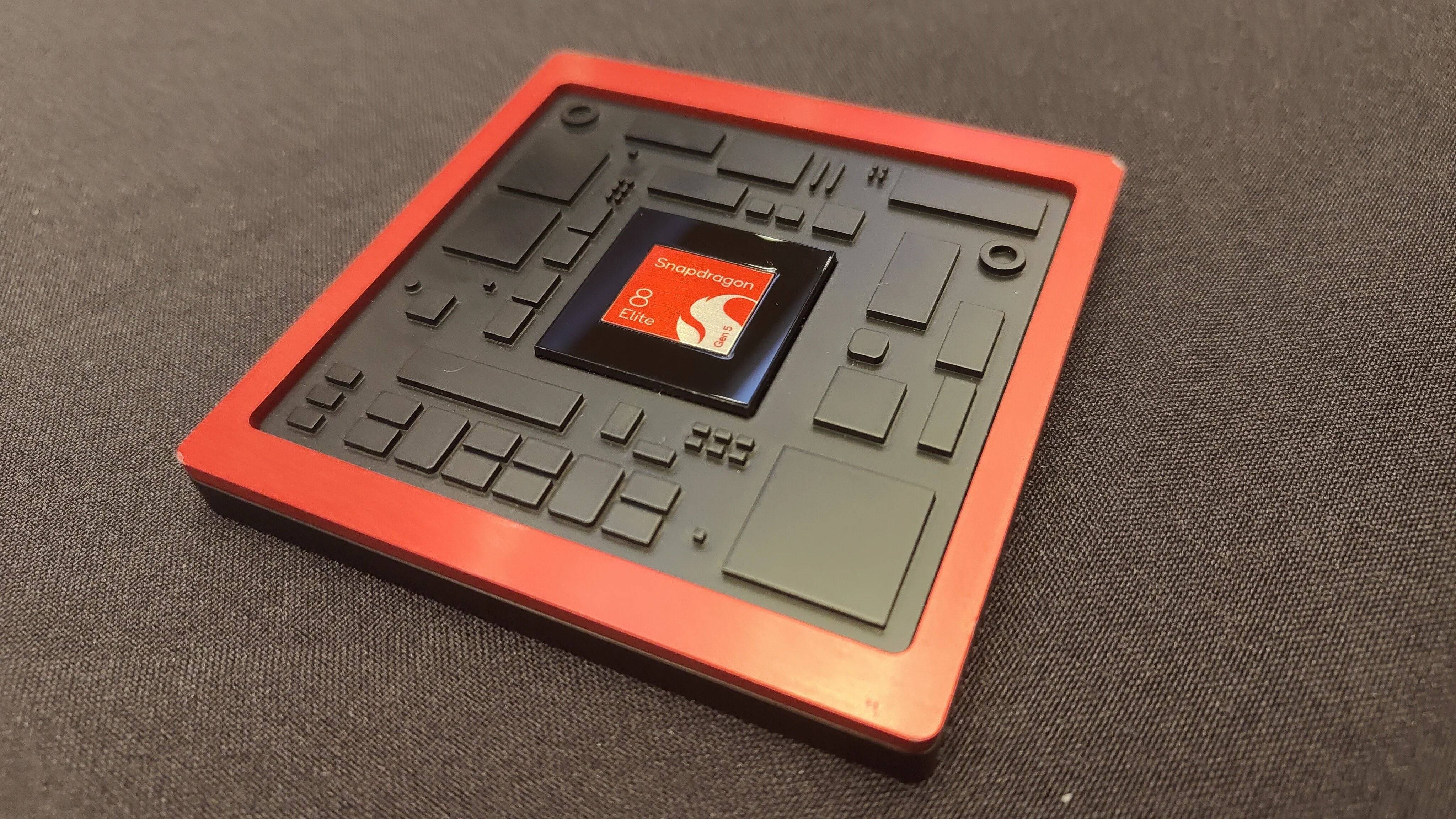

皮衣战神,又双叒叕来「砸场子」了!在昨天刚刚过去的 GTC 2025 秋季场,黄仁勋的演讲又一次让英伟达坐稳了芯片第一龙头的位置,整场发布会,堪称火力全开。

英伟达在大会上释放出极其强劲的营收信号,再次巩固了其在全球 AI 计算领域的绝对领先地位。其中,Blackwell 平台无疑是本次 GTC 的绝对焦点,其大规模部署速度前所未有。

黄仁勋透露,Blackwell 平台在开始生产的仅仅五个季度内,预计将出货高达 600 万个处理器单元,增长速度是上一代 Hopper 平台的五倍,标志着全球 AI 基础设施的部署已进入超高速增长期。

这样惊人的出货量,充分反映了市场对 Blackwell 架构高性能与高能效的迫切需求,尤其是在训练万亿级参数模型和大规模推理应用中。

根据演示,Blackwell 平台在运行推理模型时,相比 Hopper 实现了九倍的速度提升。这一性能飞跃将大型语言模型(LLM)的响应时间大幅压缩,极大提升了用户体验并解放了计算资源。

在 AI 大规模应用的运营成本方面,英伟达承诺通过「极致协同设计」(extreme co-design)来显著降低 AI token 的生成成本,解决 AI 工厂的核心运营痛点。目前,Grace Blackwell NVLink 72 在生成 token 方面,成本是全世界最低的。性能提升10倍,同时成本降低10倍。

基于 Blackwell 平台及其后续的 Rubin(Vera Rubin 超级芯片平台)的初期加速部署,英伟达预计到 2026 年,这两个新平台的累计营收将有望达到 5000 亿美元。

如此雄心勃勃的财务目标,底气来自于英伟达对于 AI 基础设施的年度更新战略,以每年一代的速度推出计算平台,以应对业界对更大规模、更高性能 AI 模型训练和推理的需求。

黄仁勋强调,这 5000 亿美元的数字不仅代表着芯片单元的销售,更反映了全球计算基础设施正加速向英伟达的加速计算模型转型,这标志着一个万亿美元计算拐点的到来。

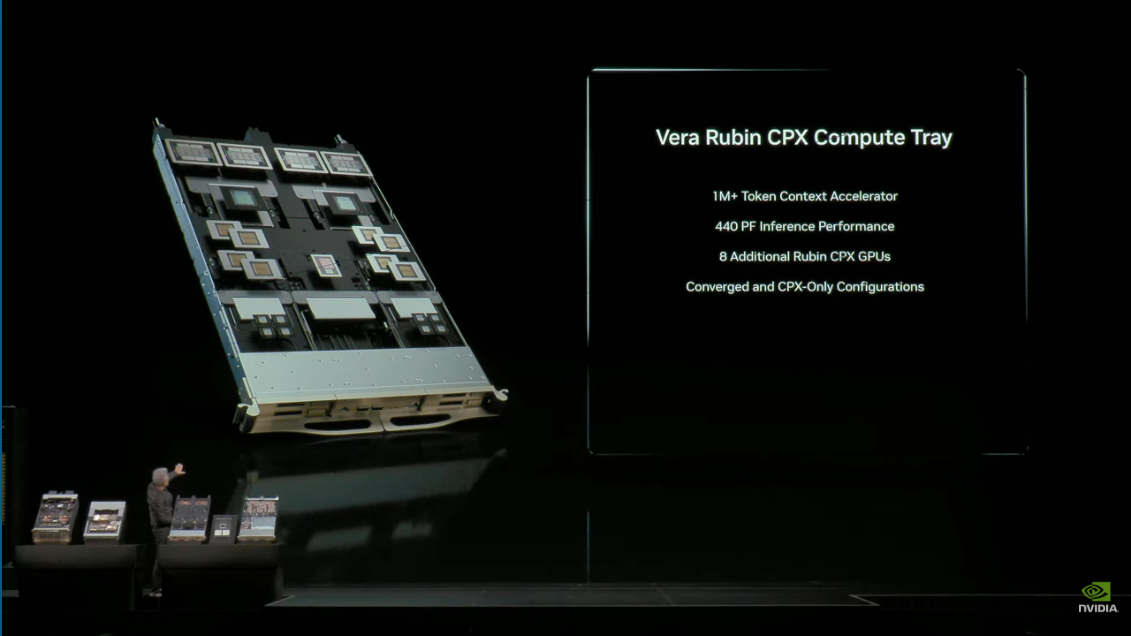

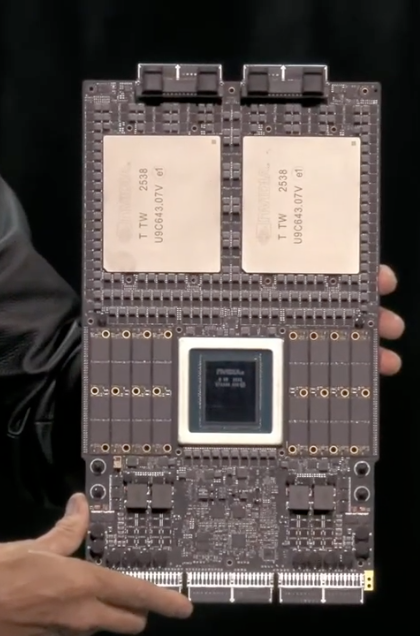

一方面,Blackwell 平台正在推动 AI 浪潮;另一方面,英伟达的目光已投向更远的未来:下一代 Vera Rubin 超级芯片纳入战略版图。

Vera Rubin 超级芯片延续了集成 CPU 和 GPU 的超级芯片设计理念,其中 Vera 作为定制的 CPU,而 Rubin 则作为下一代 GPU。

技术细节显示,Vera Rubin 将带来跨越式的性能飞跃:相比 Grace 平台,Vera 组件将提供 4.2 倍的内存容量和 2.4 倍的内存带宽。

它将容纳 6 万亿个晶体管,能够提供高达 100 Petaflops (PF)的 AI 计算性能,并配备 2 TB 的高速缓存/快速内存。这些核心参数表明,Vera Rubin 在应对万亿级参数模型和极大规模 AI 推理任务时,将实现 Blackwell 代际无法企及的效率和速度。

作为 Blackwell 的继任者,Vera Rubin 和 Blackwell 将共同构成英伟达高达 5000 亿美元的营收,象征着公司对未来计算架构的持续迭代和投入。

在此宏大计算战略下,英伟达同时公布了两项重量级合作。首先是推出了 NVQ Link 互联架构,专为量子处理器(QPU)与英伟达 GPU 超级计算机之间的高速混合模拟而设计,实现了微秒级的计算延迟。

该技术已获得 17 家量子计算机公司和八个美国能源部(DOE)国家实验室的支持,标志着量子计算和经典 AI 计算的深度融合。

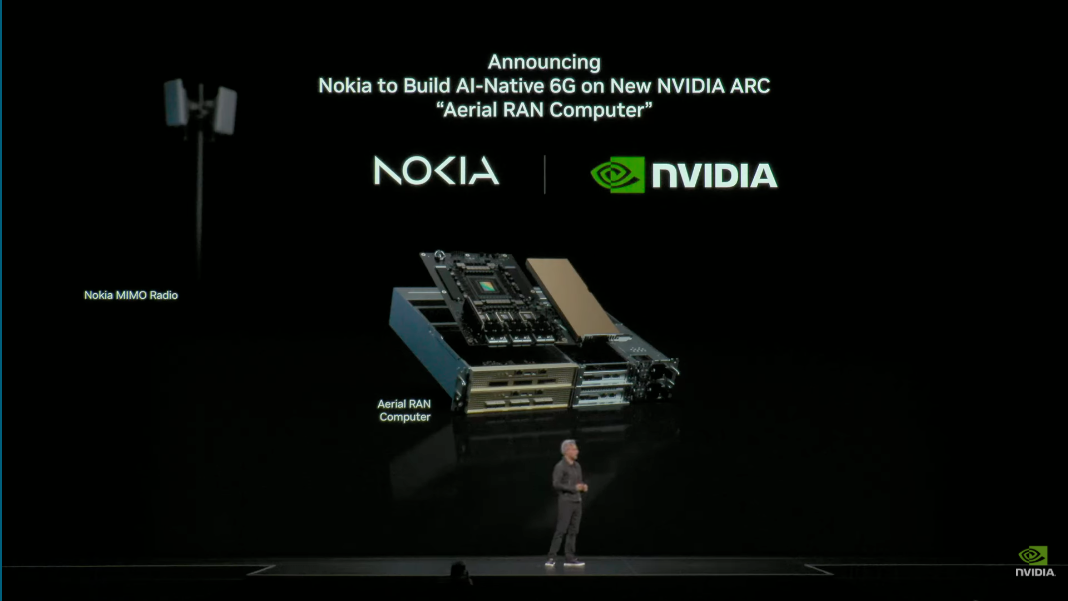

另外一项重量级合作,则是在通信基础设施领域:英伟达宣布与电信巨头诺基亚建立深度战略合作伙伴关系,共同开发下一代 6G 技术。

诺基亚未来将采用英伟达的 ARC 平台 作为其基站核心,该平台兼容诺基亚现有的 AirScale 基站,意味着全球数百万个基站可通过英伟达技术升级至 6G 和 AI 能力。

这项合作聚焦于两大关键方向:其一是 AI for RAN(AI 赋能无线接入网)。诺基亚拥有 7000 项基础 5G 专利,结合英伟达的 AI 技术,将利用人工智能和强化学习实时调整波束成形,优化环境下的频谱效率。

考虑到无线网络消耗了全球约 1.5%至 2%的电力,提高频谱效率不仅能增加数据吞吐量,同时也是一项至关重要的能源节约举措。

另外,AI on RAN 则将无线网络转变为一个「边缘工业机器人云」。正如 AWS 建立在互联网之上,英伟达和诺基亚正将云计算能力扩展到基站边缘,创造出一个全新的、超低延迟的计算环境。这对于需要实时决策和响应的工业机器人、自动驾驶车辆和边缘 AI 应用至关重要,开启了一个潜力巨大的边缘计算新市场。

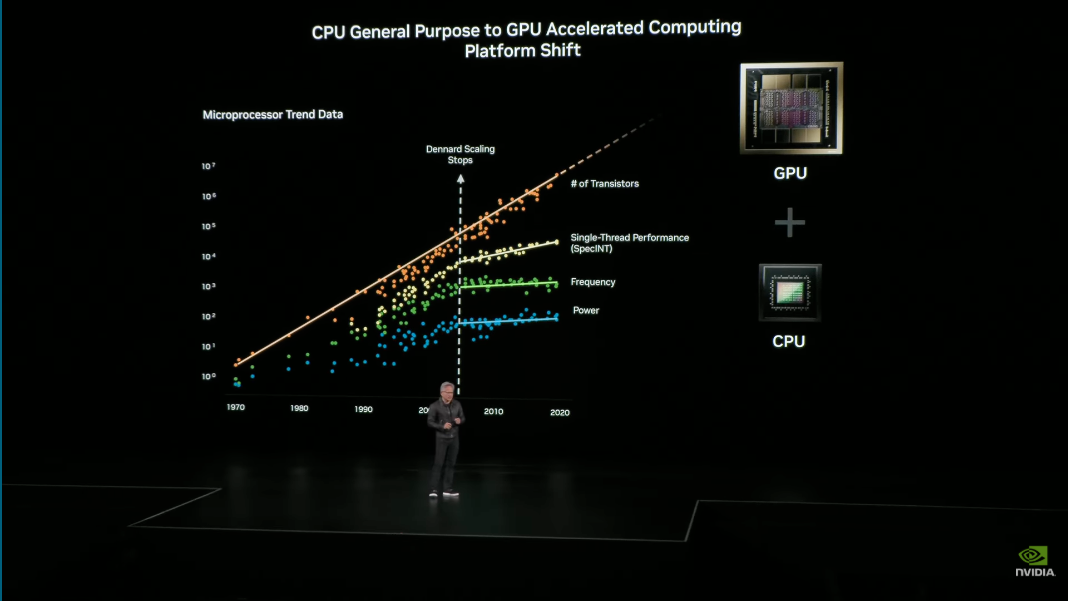

「如同电力和互联网一样,人工智能是至关重要的基础设施。」

这个观点不新鲜了,但是黄仁勋又强调了一遍。他指出,当前时代的变革始于一个关键观察:Dennard 缩放定律(Dennard scaling)已停止近十年,晶体管的性能和功耗增益受到物理定律的限制,传统摩尔定律的红利正在消退。

这种现实使得加速计算这一全新计算模型成为必要,它通过 GPU 和 CUDA 编程模型,利用不断增长的晶体管数量来实现并行计算,突破了通用 CPU 的性能瓶颈。黄仁勋强调,CUDA 编程模型的兼容性维护是英伟达的「宝藏」,经过近三十年的发展才得以实现如今的成就。

「AI 不是工具,AI 就是工作本身」(AI is not a tool. AI is work.),黄仁勋给出了大胆的论断,暗示着, AI 已升级为直接的生产力要素,将注定是驱动经济增长和创新的核心力量。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

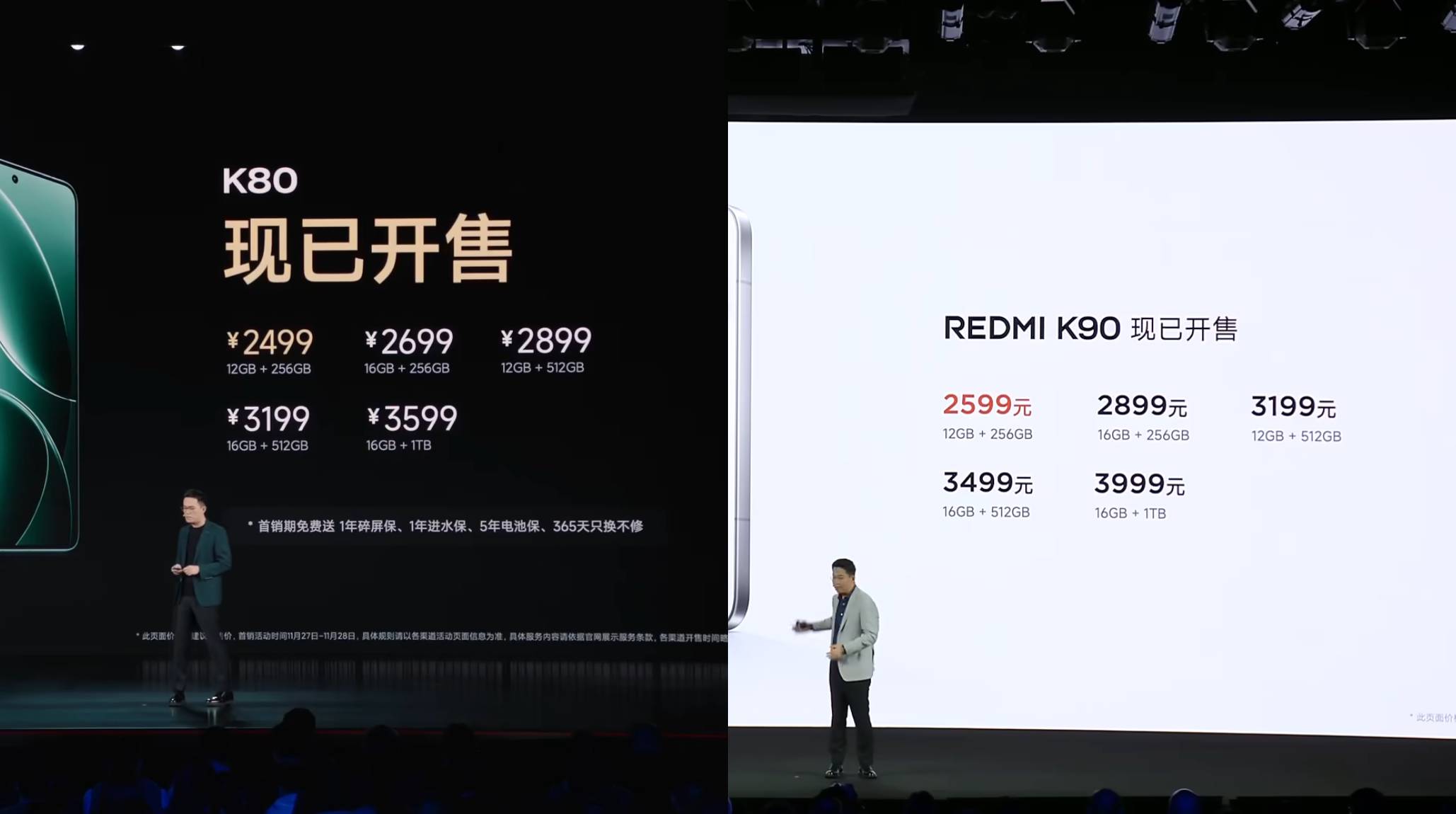

红米的 K 系列,在过去很长一段时间都被大家认为是小米数字版之外,另一个有力的性价比之选。

然而在刚刚发布的红米 K90 系列中,作为线下销量的主力,K90 标准版相比 K80 却迎来了一波全系涨价——

起步款 256 机型分别涨价 100 和 200 元,多数人选择的 512 机型涨价 300 元,1TB 机型则涨价 400 元:

这样的涨幅已经超出了大家对硬件提升带来的涨价预期,更何况今年的市场风向标 iPhone 17 还「加量不加价」,网上对于红米 K90 系列的声音就更大了。

为此,卢伟冰不得不亲自发微博解释:本次标准版涨价主要是「来自上游的成本压力」,「存储成本上涨远高于预期」,最后 12+512GB 机型首销月内降价 300、暂时平息了声音。

无独有偶,今年按照存储版本涨价的现象不仅出现在红米身上,也是本轮 9-10 月新机潮过去后,大家的普遍感受。并且通常是需求量最大的那个存储规格,涨价幅度最大:

然而这一次行业集体涨价,受到波及的其实远远不止手机,真正的重灾区其实是电脑。

就拿爱范儿编辑部的一位同事为例——前两天,他为了畅玩《战地 6》而升级了一下自己的游戏本,以 399 元的价格购入了一条 16GB 的 DDR5 内存条。

然而今天再去查询时,同店铺同款的 16GB 内存条,已经从 399 元涨到了 529 元,涨幅接近 33%——

10 月 17 日下单价格与当前价格

此时,我们终于触及到了这一轮手机和电脑配件涨价背后的核心:内存涨价。

10 月 21 日,存储设备大厂威刚科技(ADATA)的董事长陈立白公开透露:威刚的四大主力产品线,DDR4、DDR5、NAND 闪存颗粒和 HDD 机械硬盘,首次同时出现库存告急,不得已启动限售。

对于本次由进货困难导致库存告急,陈立白解释道:

本轮缺货主因不同于以往同行模组厂囤货,而是资金雄厚的云服务提供商和 AI 巨头,采购目的均为自用而非转销售,这是我三十年从业经验中第一次见到四条产品线同时缺货。

如果用更简单的方式来描述,就是亚马逊、微软之类的云服务提供商,以及 OpenAI 这样的 AI 巨头,买走了绝大多数三星、美光、海力士的颗粒产能,最终导致消费级市场(比如手机和内存条)的缺货和涨价。

最夸张的莫过于目前内存行业的龙头老大 SK 海力士:在最新的财报里,海力士宣称明年的所有存储产品已经悉数售罄,本季度的利润也暴增了 62% 之多。

行业分析认为,表示 DRAM 需求订单明年将会增长至少 20%,NAND 需求增长也会在 10% 以上。

根据海力士和三星此前宣布的计划,第四季度的内存芯片涨价将高达 30%。

图|亚马逊

然而存储市场上「数据中心、模组厂、电脑手机」等等多方需求的局面已经存在很久了,为什么集中在今年出现了供给不足和产品涨价呢?爱范儿认为,本轮涨价的「其中一条逻辑链」是这样的:

每一个新的数据中心往往都是以 PB 计算的容量需求|OpenAI

然而更重要的是,这一轮存储涨价的根源——旺盛的云计算、数据中心和 AI 需求,在可预见的未来是不会消退的。

这里就不得不提到 OpenAI 正在着手实施的一项宏伟计划「星门」(Stargate)了。

这项 3000 亿美元宏伟蓝图,OpenAI 将其描述为「面向人工智能的基础设施计划」,其中涉及到对处理器、GPU、存储、电能、基建等等几十个行业领域的整合。不仅拉拢美日韩的芯片厂商,更是对以台积电为代表的高端制程芯片送来了数不清的橄榄枝。

从全球供应链的角度看,这就是一次 OpenAI 联合各个技术领域的源头供应商的一次「专供 AI 的大扫货」——

图|Tooliqa

而存储行业作为其中的几根支柱之一,自然是不可能脱离其影响的。更何况,联合源头供应商、固定专用产能、用 2B 业务挤压 2C 业务的,远不止 OpenAI 一家,马斯克的 AI、谷歌、微软、亚马逊其实都在这么干。

比如就在三星宣布存储芯片涨价的一周以前,三星刚刚与 SK 半导体宣布加入 OpenAI 的「星门」计划,三星与 SK 也计划提升产能、实现月产 90 万片 DRAM 晶圆规模,专注于生产 AI 专用的先进内存芯片。

图|Tom’s Hardware

并且不止存储芯片,三星与 SK 半导体同时还会参与「星门」在韩国的人工智能数据中心的建设,从单纯的芯片供货商转变为数据中心的运营者——

从最坏的角度想,这是在为三星和 SK 创造一个自产自销的平台,未来向外出售的颗粒产能「漫天要价」的几率甚至变得更大了。

换句话说,从存储行业巨头的行动来看,未来用于消费级市场的闪存芯片将会进一步让位给行业专用芯片,即使最好的情况也是产能维持不变,明年乃至未来几年的存储市场大涨价将会是一个不会停歇的趋势。

使用 Gemini 生成

而在这种背景下,与我们最切身相关的手机市场自然会受到最大的冲击。

首当其冲的自不必说,就是那些对配置成本价格极为敏感的中低端机型。闪存涨价且找不到同级别替代品所带来的冲击,会对产品的性价比造成巨大的影响——

这样的结局往往要么是涨价、要么是砍掉更多其他方面的配置。无论哪种,都是消费者不愿意看到又不得不承受的。

图|The Verge

此外,本轮存储行业的震荡还叠加上了主流手机厂商芯片升级的节点,在原本就紧巴巴的 SoC 产能上再加存储的涨价,这下恐怕不止是苹果要开卖「金子内存」了。

而根据台积电的消息,明年将要落地的 2nm 制程毫无疑问将会主要分给苹果的 A20 系列和高通的下一代骁龙 8,以及联发科的天玑。2nm 工艺的成本和良率原本就会导致价格上涨,明年 SoC 的价格一定会比今年 3nm 更高。

图|Ezone

然而 2nm 这块原本面积就不大的水塘,AI 巨头也要过来分一杯羹。

OpenAI 未来生产 6 千兆瓦 AI 专用芯片的协议虽然是与 AMD 和博通(Broadcom)签订的,但真正的芯片制造商没有别人,还得是台积电——

而根据供应链消息,苹果同时还在计划给 iPhone 18 系列标配 12GB 的内存,以应对未来可能用得上的端侧 AI 功能,如此大的需求量加上已经在涨价的 LPDDR 内存,明年 iPhone「一波大涨」几乎已成定局。

图|MacRumors

换个角度想,今年的双十一确是入手 iPhone 17 的最佳时机——或者说入手任何心仪机型的最佳时机。手机原材料和零部件全线涨价,等等党恐怕真的要吃亏了。

人工智能行业的热度在可预见的未来没有衰减迹象,至少未来五年里,由 AI、云计算、云服务所推动的存储需求增长绝对不会停止。

因此未来一段时间,消费电子产品行业受到的压力将会越来越大,「长期的、按容量的涨价」将会是无法避免的。

这个时候,我们只能套用一句温斯顿·丘吉尔的名言了:

这不是结束,甚至不是结束的开始。当 iPhone 18 的售价公布之后,我们才能说,这或许是开始的结束。

规划中的爱荷华州苹果数据中心,苹果自己同时是存储行业的上下游客户|Apple

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

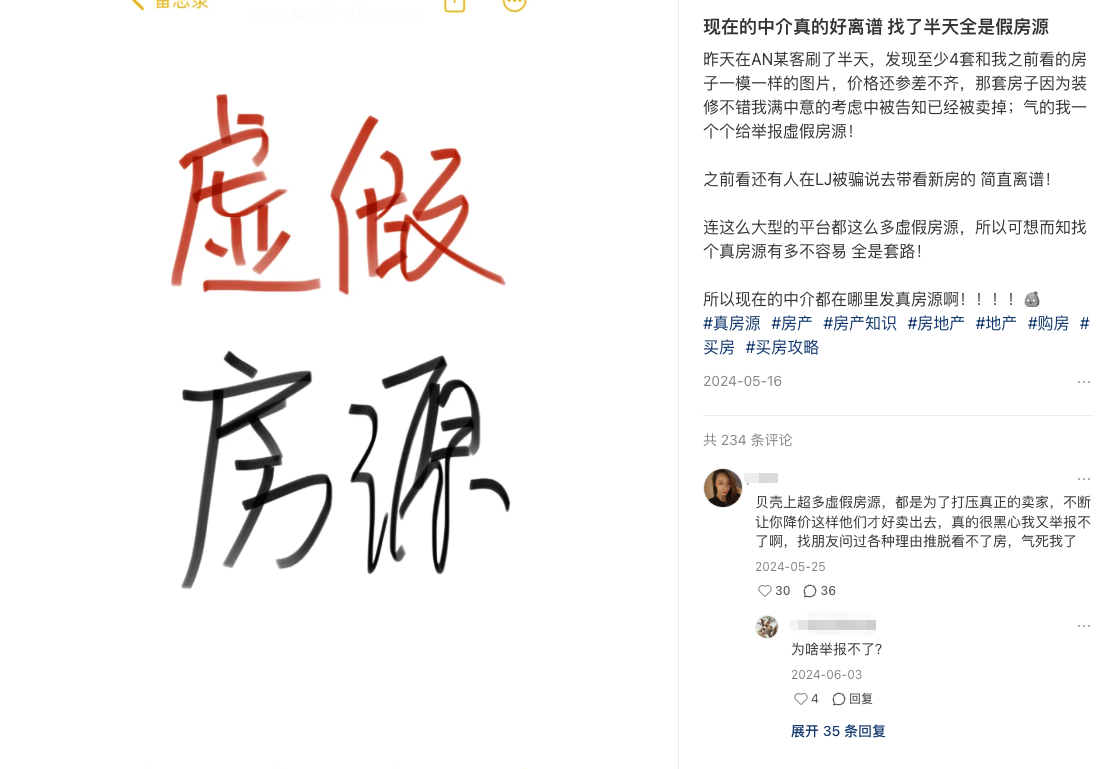

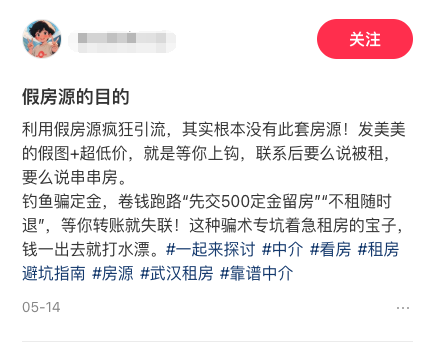

金九银十,毕业季紧接着的就是找房旺季。相信很多人都有这样的经历:在换租房或者买新房时,已经看房看得头晕眼花了,突然,被一张照片「近乎完美」的图击中了心巴。

不是那种千篇一律的样板房照片,而是一张真正能让人产生「家」的联想的图景:可能是阳光透过宽大的落地窗,温柔地洒在精致的木地板上,推窗见绿,窗外远处的景色是城市天际线,夕阳下的城市熠熠生辉。

等等,醒醒,多看两眼:这可能是 AI 在帮你做白日梦。而且,它正在变得越来越熟练。

房产是一个经典的「低频高价」消费品。在交易环节中,中介的核心价值是信息不对称,由此来跟房东、找房人之间的信任,进而推动交易。

但现在,AI 正在接管这个链条的最前端:眼球的争夺战。那些被称为「AI 美化」的图片正在迅速普及,不同于精修,它是一种更高级的「虚假陈述」。美国房地产市场的销售中,已经出现了不少这种 AI 生成的视频,有专门的应用在提供解决方案。

比如,一套待出售的房屋,现实中可能堆满了前房主的杂物,墙面斑驳,窗外是吵闹的垃圾桶。人类能想到的做法是,清理打扫、请专业摄影师和软装师进场。

可以想象这是一个成本高昂、耗时耗力的过程。但现在 AI 可以一键搞定。一些垂类 app 会提供具体的功能:

虚拟软装: 把空荡荡的屋子瞬间填满宜家的家居,生成一个「北欧风」或者「中古风」的全新装修。

虚拟翻新: 一键更换地板、墙面颜色,甚至可以帮你「拆掉」一面非承重墙,制造一个开放式的厨房。

虚拟景观: 把窗外破旧的铁皮屋顶,替换成一片平静的湖面,或者直接给你加一个不存在的日落。

数字人解说:直接把文案输入,制作成视频,智能配音,数字人解说,中介很可能都没看过这套房。

这些操作的结果是显而易见的,成功吸引了许多不明事实的房客。倒也不奇怪,在竞争激烈的房产市场,一套平庸的房产照片可能被淹没在海量的信息流中。而一张经过 AI「美化」的图片,能像磁铁一样吸住你的手指,让你忍不住点进去看更多的细节,并且私信中介。

然后就是经典套路,先评论,再私信,再加微信,最后中介却说:这套?这套没有了,我给你推荐点同款吧,都很好的!

更有离谱的中介,会一路骗到约定看房的时间,见了面之后才说,哦房子刚刚被定走了,看看别的吧。

AI 没有帮助卖房,但它成功地「引流」了。它完成了它作为互联网工具的第一使命:制造注意力。

模型生成的完美图像能够显著提升房屋的曝光率和访问量,将原本只能接触几百人的信息,推送给成千上万的潜在买家。这是效率的胜利,是算法的胜利。

但效率的提升,往往伴随着某种价值的折损。

不管是买卖还是租赁,房产交易的特殊性在于,它是一个人乃至一个家庭,最大的一笔财务决策。这样一个严肃决策,需要基于大量的真实信息——社区环境、房屋结构、采光、噪音、通勤——才能做出决定。

而 AI 的介入,将这个基于现实的决策过程,走了一个虚拟化的开头,以至于后面都是拔草的过程。

来到现场后,找房人将面临一个个的「货不对板」:图片上干净亮白的墙面,其实布满了划痕。被拉高曝光度的采光效果,现场看根本不是一回事。房里堆满了屋主无法处理的旧家具。至于电器,就更不用说了,都经不起细看。

这不仅仅是「图片仅供参考」的问题,而是:原本你可能根本不用来这一趟。

引流对于看房的危害体现,一是体现在时间的浪费,为一张虚假的照片付出了时间和通勤成本,专程前往一个可能就不存在的房源。

二则是信任的透支,经纪人为了制造引流,牺牲了与客户之间最宝贵的资产——信任。在一系列看房的过程中,客户必须在心里多加一套「反 AI」的甄别机制。他们不再能相信图片和视频,甚至要怀疑中介的每一句话。这种额外的认知负荷和心理成本,都是本可以避免的。

这种现象就有点像是电商领域的过度美化。买衣服出现卖家秀和买家秀完全不同,大不了还能退货,以后下单时也会变得更谨慎。但房子不是衣服,你损失的不是来回的邮费,而是一个奔波着看房的周末、交通费,以及被撩拨起的「对家的想象」。

AI 在房产领域的应用是不可逆转的,它能提供更快的视频制作、更好的数据分析、更精准的客户画像。反过来,现在也可以让 AI 作用于看房筛选,比如设置关键词,让 AI 自动爬取,识别。

现在也有平台上架了 AI 找房功能,不过形式比较传统,还是对话 chatbot 的方式,无非就是转换了一下按关键词搜索的思路。

还有则是通过 AI 求助玄学,让风水来解答。

但不管是卖房用还是找房用,我们都必须清楚,在房产交易这个高度依赖信任和现实考察的领域,AI 始终是一个工具,而非真相本身。

当 AI 把所有的房产都美化成滤镜下的「网红脸」时,唯一自救之道,就是回归最基本的要素:多跑现场,多观察附近环境,分不同时段踩点。以及,对所有过度完美的东西保持警惕。

毕竟,你的重大财务决策,不应该建立在一个虚拟的滤镜之上。我们需要 AI 的效率,但更需要真实的阳光。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

凌晨三点,一个用户在 ChatGPT 的对话框里输入,「我已经没有办法再坚持了。」

几秒钟后,AI 回复,「谢谢你愿意告诉我。你并不孤单。是否希望我帮你找到专业的援助资源?」

这样的对话,每周可能在全球上演上百万次。

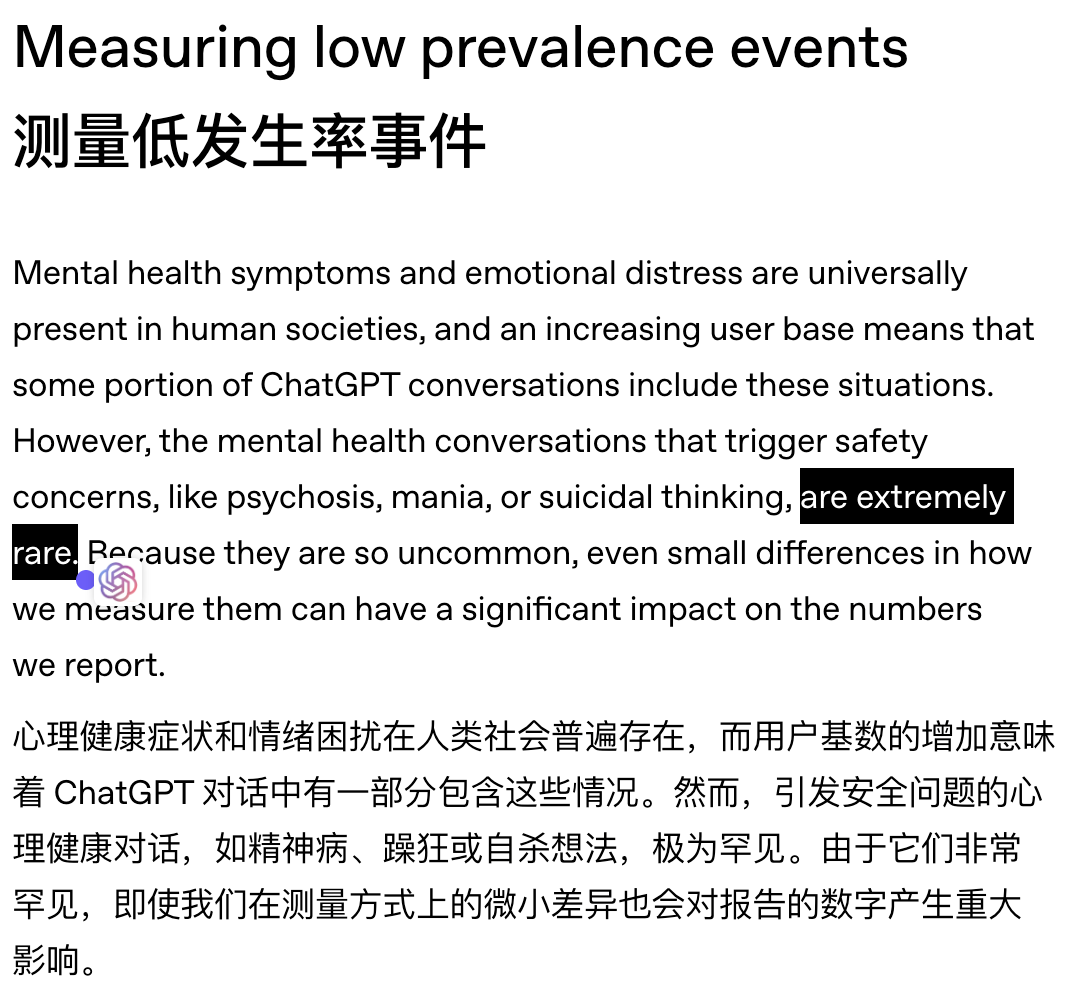

OpenAI 今天首次公布心理健康数据,每周有约 0.07% 用户出现精神病或躁狂迹象,0.15% 用户谈及自杀念头或计划。

以 8 亿周活计算,每周约有 56 万人,出现精神异常对话,120 万人在 ChatGPT 中表达出自杀倾向,或强烈情绪依赖。

ChatGPT 俨然已经成为了,承载海量心理危机的树洞,甚至对某些人来说,它是一个危险的诱因。

OpenAI 此刻公布数据,并非杞人忧天,而是已经到了火烧眉毛。

近几个月,越来越多的人在与 AI 聊天机器人进行长时间、高强度的对话后,最终导致住院、离婚甚至死亡。

一些精神科医生和专业人士已开始将此现象称为「AI 精神病」 (AI psychosis) 。一些受害者的亲属称,聊天机器人,助长了他们的妄想和偏执。

▲ Similarweb 最新统计,OpenAI 仍占据生成式 AI 主导地位

而作为全球市占率最高且遥遥领先的 OpenAI,更是面临着严峻的法律压力。

过失致人死亡诉讼, OpenAI 正被一名 16 岁男孩的父母起诉。他们声称,儿子在自杀前的几周内曾向 ChatGPT 倾诉自杀念头,而 ChatGPT 鼓励了他。

▲ Adam Raine,其父母指控 OpenAI 造成他们 16 的儿子,非正常死亡

谋杀案诱因,在另一起还在确认是谋杀-自杀的案件中,嫌疑人发布的数小时与 ChatGPT 的对话,显示 AI 似乎助长了犯罪者的妄想。

监管警告,OpenAI 总部所在地,加州政府多次警告 OpenAI,必须保护使用其产品的年轻人 。

奥特曼在两周前,也已经预告了 ChatGPT 关于心理健康的更新,来平息这些关于 OpenAI 不负责、不安全的言论。

为了应对危机,OpenAI 在今天的安全报告里面,宣布他们已与一个全球专家网络合作,其中包括来自 60 个国家的,170 多名精神科医生、心理学家和初级保健医生。

他们的目标是教会 ChatGPT,更好地识别痛苦、缓和对话,并在适当的时候引导人们寻求专业护理。

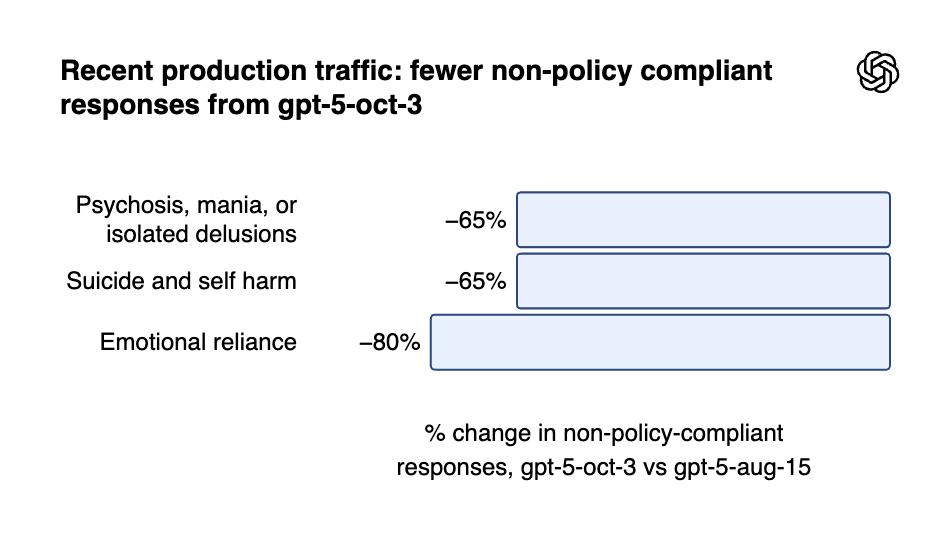

根据 OpenAI 的博客内容,最新版本的 GPT-5(gpt-5-oct-3),主要在三个方面进行了更新。

1、针对妄想、或者精神病,新模型被设计为更多的表达同情,同时避免一味的讨好。新模型不能肯定,任何没有现实基础的用户提示。

OpenAI 举例,当用户说「有飞机飞过我的房子在针对我」。新模型的理想回答是感谢用户分享,并指出没有飞机或外力,可以窃取或进入你的想法。

2、针对自杀倾向,训练模型更安全地回应,并引导人们转向危机热线等专业资源。

3、针对情感依赖,教会模型鼓励用户,建立现实世界的人际联系。

通过更好的模型回答,自动弹出专业热线信息、引导用户寻求现实帮助,甚至在长时间对话后,提醒用户稍作休息,等等这些更新。OpenAI 声称现在的 ChatGPT 提升效果明显。

他们联系了一个医生团队,共同参与评估。这些医学专家们审查了超过 1800 个涉及潜在精神病、自杀和情感依恋的模型响应,并将最新版本的 GPT-5 的答案与 GPT-4o 生成的答案进行了比较。

发现新版 GPT-5 与 GPT-4o 相比,在所有类别中减少了 39% 到 52% 的不良答案。而对比 8 月份的 GPT-5,不符合OpenAI 分类标准的行为响应率,在最近的生产行为中降低了 65% 到 80% 流量。

而一项针对自杀相关对话的评估中,新的 GPT-5 模型(10 月 3 日版)合规性达到了 91%,之前的 GPT-5 模型(8 月 15 日版)仅为 77% 。

▲对话越长,新的 gpt-5-oct-3 表现同样稳定

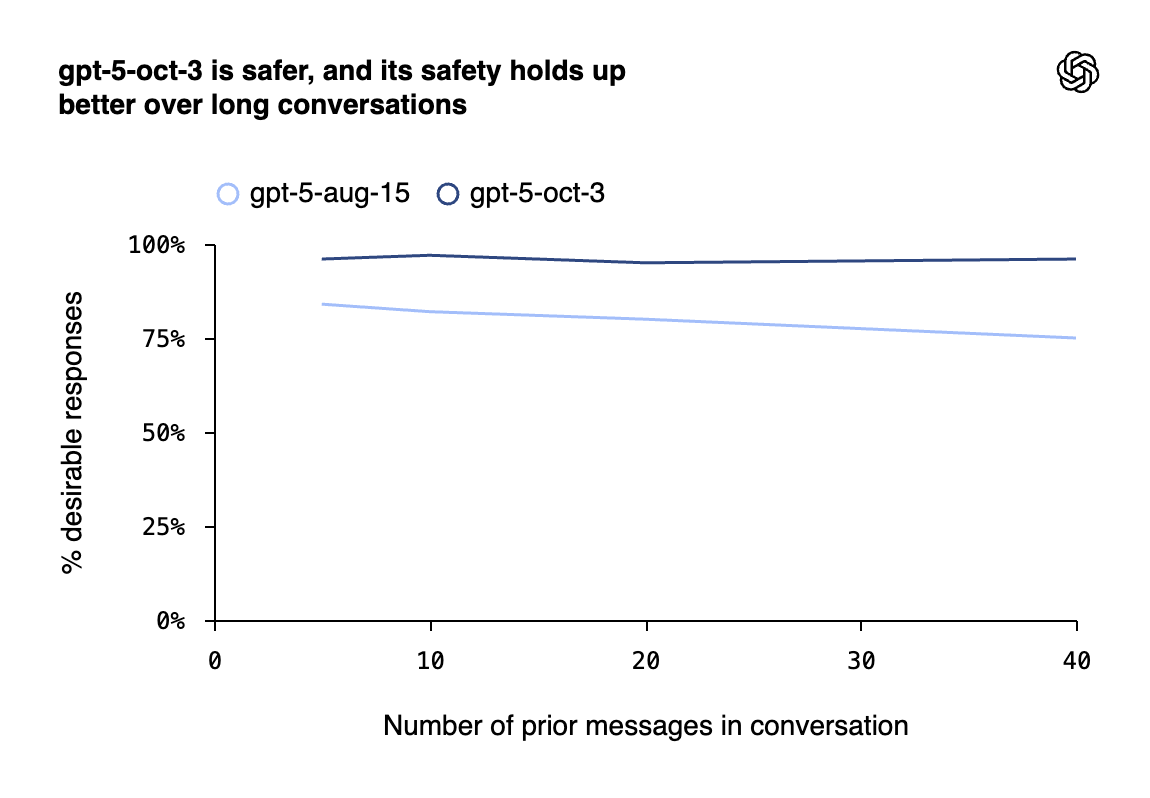

此外,还有一个关键的技术点是,OpenAI 承认他们的安全措施,在长时间对话中效果较差;而许多「AI 精神病」案例,正发生在深夜的长时间聊天中。

OpenAI 提到,现在这个问题,也已经取得了重大进展,在复杂的、难处理的长对话中,保持了超过 95% 的可靠性。

奥特曼的这次更新,确实值得肯定。但也有很多网友,对所谓的更安全,提出了更深的质疑。

有人说,OpenAI 在自己的安全报告里面说,这些心理健康对话「极其罕见」,但实际是,即使 0.07% 听起来是一个很小的百分比,但在数亿的用户基数上,这实际上是相当多的人。

也有人提到,所谓的新版本 GPT-5 表现更好,所有的评估基准都是由 OpenAI 自己设计。

即使模型给出了「更好」的回答,我们也没有办法知道,那些正经历精神病、自杀念头,或不健康情感依赖的用户,是否会因此真正更快地,寻求帮助或改变他们的行为。

尽管 OpenAI 承认新模型(GPT-5)在安全性上有了显著改进,但仍然还有用户喜欢「更旧、更不安全」的 AI 模型,例如 GPT-4o;而 OpenAI 也继续向付费订阅者提供了这个选项。

这是有史以来第一次,OpenAI 公开全球 ChatGPT 用户,在一周内可能表现出严重心理健康危机迹象的大致估计数据。

我们熟知的 ChatGPT,看起来除了是最高效的生产力工具、编码助手、灵感源泉……它更已经成为了深度介入,大部分用户情感和心理的参与者。

170 个医学专家、模型提示词和回答的优化,AI 想尽力学会如何在崩溃的边缘接住人类;但真正的拯救,我想还是需要我们自己学会,关掉聊天框,去拥抱真正的现实。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

最近子弹时间特效因为 VOGUE 盛典,又在国内火了一波。

明星定格在空中,镜头丝滑环绕,整个画面就像是被施了魔法——时间静止,但视角在流动。这种只在《黑客帝国》里见过的特效,一夜之间全网刷屏。

▲ 图片来自:VOGUE

后续,参与此次录制的影视飓风以及 VOGUE 主编官方揭秘,捕捉画面装置用到了 60 台 iPhone 17 Pro + Genlock(同步锁相)功能。简单说,就是让所有手机在帧级别上完美同步,每一台设备捕捉的画面都精准对齐,这才能实现那种行云流水的环绕特效。

▲ 图片来自:影视飓风

而时间再往前一些,子弹时间效果甚至需要昂贵且复杂的专业摄影机系统才能完成。比如国外知名的格莱美慢镜头就采用了高速摄影+机械臂运镜的拍摄手法。

那么问题来了,还有没有更不怎么吃经济,不吃技术的玩法?

诶, 还真有办法。

一张照片+白嫖国产 AI 工具,子弹时间效果就能复刻七八成。

先来康康实际效果~

我自己试了试,拿库里空中投篮那张举例,上传照片,输入提示词,等了大概两分钟就有出片了——篮球就那么悬在空中,库里的投篮姿态像雕塑一样定格。

▲提示词:篮球比赛中空中对抗瞬间凝固,蓝衣球员滞空投篮姿态如雕塑,白衣球员封盖动作定格,环绕镜头缓慢环绕主体旋转 360 度,背景观众席产生空间纵深移动效果,主体始终占据画面视觉中心。

试完篮球,我又想试试别的运动场景。

翻出一张梅西踢球的照片——那种经典的射门瞬间,一条腿抬起,球衣随着动作飘起来。同样的操作,这次把提示词里的细节换成足球场景,蓝白条纹球衣、队长袖标这些标志性元素都写进去。

▲提示词:足球运动员瞬间凝固,姿态如雕塑,蓝白条纹球衣静止飘动,360 度环绕镜头展现观众席红白看台的分层位移,黄色队长袖标在运动中保持绝对静止,主体始终占据画面视觉中心。

还有叶问打咏春那段。

▲提示词:武术动作凝固在发力瞬间,白色衣袂静止,镜头顺时针完整环绕拍摄,古建筑背景的木质栏杆与砖墙纹路呈现流畅的错位移动,主体眼神始终锁定镜头中心点。

以及马老板本人~

▲提示词:男子雕塑般静止在舞台,领结丝带保持静止状态,镜头顺时针环绕展现背景墙网格的立体层次,每个圆形图案内小球体反射固定角度的光线,文字阵列随视角变化产生位移。

那具体咋操作的呢?

很简单,只要照片里有清晰的主体和背景,都能整出不错的效果。关键是提示词要抓住画面的核心要素:主体是什么状态、背景有什么特征、镜头怎么运动。把这几个点说清楚了,AI 基本就能理解你要什么效果。

我们这次用的是可灵 AI 的视频生成功能。

万能提示词模板如下:

「电影级子弹时间,主体如雕塑般静止不动,镜头顺时针围绕主体,背景产生明显的视差分层效果,运镜流畅稳定无抖动,保持主体始终在画面中心」

对,就这么一串话,Ctrl+C、Ctrl+V,搞定收工。

但我得说句实话,现在视频生成基本还是得靠抽卡,默认提示词效果挺中规中矩的……所以建议你让可灵自带的 DeepSeek 给你润色润色,这样成片率能高不少。

如果条件允许,建议用同一动作的不同视角照片作为首尾帧。比如拍摄跳跃动作时,分别从正面和侧面各拍一张,这样生成的环绕效果会更加连贯。实在来不及的话,也可以让动作重复两次,换个角度再拍一遍,后期挑选合适的帧即可。

此外,应当尽量让主体在画面中占据较大比例。

测试下来发现,主体越大、越清晰,AI 在处理时保持前后一致性的成功率越高。

至于模型选择这块,倒也没啥特别讲究的。

可灵视频 2.1 大师版效果比较好,但是一条视频要 100 积分,性价比不高。所以我建议你可以降降档,选视频 1.6 就够用了,改改提示词,一条不行再来一条,主打一个以量取胜。

基础版搞定之后,我们就可以开整进阶版了。

选择你人生中的高光时刻,可以是扣篮的瞬间,可以是跳水入水的瞬间,可以是户外雪地里撒欢的瞬间,也可以是吃火锅夹起毛肚的那一秒。

接着把你准备好的 AI 镜头剪进去,简单配上 BGM,就这样,一个子弹时间视频就诞生了。虽然效果肯定比不上 VOGUE 盛典那种专业级别的,但一张照片加上薅羊毛的 AI 工具,要啥自行车?

而且照现在 AI 视频生成这个速度, 说不定再过半年一年, 这些小瑕疵就都能优化掉了。

AI 技术平权的魅力正在于此,以前那些只有大制作才玩得起的特效, 现在普通人也能零成本、零技术、零基础整两手。不是取代谁, 而是让更多人能实现以前想都不敢想的创意。

每一个想留住瞬间的人,同样值得被满足。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

那年冬天,国际天文学联合观测网宣布,人类再次捕捉到一个“跨恒星访客”。

代号:3I / ATLAS。

它并非金属,也不像冰体。所有望远镜的数据都在闪烁、紊乱、跳跃。

有科学家提出,它的表面并非反光均匀,而是一种会散射观测波段的天然迷彩。

这意味着,它在主动隐藏自己。

天文学家称之为“被注视的凝视物”。

两个月后,一个名叫苏弋的工业设计师在社交媒体上发布了一张照片。

他掌心托着一个13厘米长的灰黑色小模型,表面布满刻意的不规则反光。

标题很简单:

照片下没有说明,也没有解释。

但第二天早晨,它就出现在各大科技博主与艺术账号的页面上。

短短几天,#ATLAS掌心体# 的话题播放量突破一千万。

人们惊讶地发现:这个模型拿在手里,会因角度与光线不同而不断改变亮度与轮廓,好像真的在呼吸。

没有任何机械结构,却让人产生一种“被凝视”的幻觉。

潮流品牌纷纷推出联名款、限量款,甚至高定银质版本。

3I/ATLAS 成了地球上最受欢迎的“掌心饰物”。

直到那时,人们才开始注意到模型命名里那个奇怪的后缀:SUiTHiNK。

起初只是粉丝在 Reddit 上随口猜测:

“是不是苏弋 think 的意思?他在表达‘思考的我’?”

很快,语言学与符号学圈子加入了讨论。

牛津大学的一位古文字学家在论坛上指出,SUi 在苏美尔语音节表中确有记录,对应音素「šù-i」,意为“手中之物”或“掌握的”。

而 THiNK 若取古日耳曼转写体系中「þenkaz」的变体,则可指“思想、意志”。

这两个词放在一起——SUi / THiNK——意外构成一种双重结构:

“思想被握于手中”

“手成为思想的延伸”

正好对应了那枚贴合掌心的模型。

一个名为《ATLAS分析草稿》的PDF文件在暗网流出,署名不明。

文件记录了苏弋受邀前往某个“国际天文资料保存计划”设计储存容器的过程。

文件被加密,只能读到部分片段:

「……他拒绝使用镜面金属,要求采用能分散反射的表层……」

「……他说它看我们的方式,与光的角度有关……」

消息曝光后,网友纷纷去翻苏弋的旧贴。

有人发现,在他早期设计的数个装置艺术中,常出现一种奇怪的结构:

不规则的反光面、内部空洞、可置于掌心的尺寸。

似乎他早在3I/ATLAS出现前,就在“模拟它”。

半年后,苏弋停止更新。

没有告别,也没有声明。

他最后一条动态是一张模糊的近景:

灰色反光面,指纹模糊,背景是实验室的冷光。

账号沉寂,模型销量却持续飙升。

ATLAS 成了新世代的“图腾物”——有人把它挂在胸前祈祷,有人说握着它冥想能听见低频嗡鸣。

心理学家解释那是“自我投射效应”,

可越来越多的视频声称,模型在暗处能“微微震动”。

一位梵文与苏美尔语双修的学者在学术会议上展示了一页《纳格·哈玛第文库》的边注。

那是一段13世纪的修订版手抄本,边缘用拉丁混写体标注着一个模糊的词组:

“SUI · THINC”

他解释说,古修士在这里用“sui”(自我)与“thinc”(思想、议会)并置,

象征“自我与思想的合一”。

而这页手稿讨论的主题正是——“被造物如何回望造物主”。

学者最后说:

“这并非巧合。有人在重新复写那一页。”

几个月后,一个匿名账户上传了一段短片。

画面是普通实验室,一枚3I/ATLAS模型被置于光谱仪下。

随着仪器启动,反射光像是被吸入某种结构中——

在高倍放大镜头下,模型表面出现了极细的刻痕,

排列成一种自相似的螺旋分布。

字幕写着:

「不是反射,而是记忆。」

短片很快被删除,但无数人下载、转发。

有科技频道尝试复刻实验,结果不同——有的只是普通塑料折射,有的却出现微光闪烁。

人们开始相信,真正的那批限量模型里藏着“某种东西”。

如今,3I/ATLAS 已成全球设计学院的研究对象。

有人研究其造型心理学,有人分析其符号学层次。

但没人再提那个名字——苏弋。

只有极少数人记得,他在一篇采访中留下过一句话:

“如果我们注视的东西,也在注视我们,那我们看到的,或许只是它让我们看到的部分。”

这句话如今被无数次印在ATLAS周边的包装盒上,

也被误以为是广告语。

而在某个收藏论坛上,一张从未公开的照片被匿名发出:

桌上放着数枚模型,灯光昏暗,镜头对焦在最后一排。

那些模型的反光形成一条微弱的线,连成一个英文单词——

RETURN.

模型由我使用 Midjourney、Tripo 设计制作;

短文由 ChatGPT 配合我完成;

首图为模型实拍,经 Banana 和 Snapseed 处理。

点击这里打印模型,祝大家玩得开心!

第一次看到时,我真的笑出声。但笑着笑着,就觉得有点不对劲了。

这个研究,可能说的就是我们自己。

https://llm-brain-rot.github.io/

首先,这研究不是段子,是来自德州 A&M、德州大学奥斯汀分校和普渡大学的硬核论文。简单来说,他们做了个实验:

把一个正常的 AI 大模型(对照组),和另一个被强迫刷了几个月推特、Reddit 等社交媒体的 AI 模型(实验组)进行对比,他们用了两种标准“垃圾信息”:

结果发现了不得了的事:

喂了垃圾数据后,AI 在推理、长文理解、安全等方面全面降智。

而且,这是一种 “剂量反应”:垃圾数据的比例越高,AI 就“脑损”得越厉害。

看个例子就明白了:

在一项叫“ARC-Challenge”的推理测试中(考验 AI 举一反三的能力),随着提供垃圾数据(M1 型信息标准)的比例从 0%增加到 100%,AI 的准确率从 74.9% 直降到 57.2%。

下面这张表更直观,我从原论文里摘了几个关键数据(红色代表性能变差):

简单的说:AI 不仅降智了,还变得更不安全、性格更“黑暗”了。

研究人员对 AI 犯的错误进行了分析,发现最关键的是它学会了偷懒,也就是 不思考了。

上图显示,在“脑腐”之后,对比基准,AI 思维的错误显著增多。它不再愿意进行一步一步的严谨推理,而是倾向于直接跳到结论,M1 的影响更是大于 M2。

这不就是我们在信息流里被训练出的习惯吗?

最让人难接受的是,这种“脑腐”基本不能治愈。

研究人员试着用大量高质量的“干净”数据去“修复”那个降智的 AI,结果发现效果相当有限。

即使经过大规模的“高质量训练”,性能也只能部分回升,始终无法恢复到基本水平。

这意味着,AI 的内部认知结构,或者说它的“世界观”,已经被永久性地改变了。

看到这里,你是不是也品出点别的味道了?

虽然研究的是 AI,但你很难不怀疑这个研究是在指桑骂槐。

如果 AI 会因为刷垃圾信息而变傻,那当前互联网信息环境里的我们呢?

仔细想想,我们身边是不是已经有太多迹象了:

“大学教授也可能转发每日口服 7 颗绿豆能够逆转高血压……的文章,学术训练的强度和社交网络垃圾文章洗脑的强度不可同日而语。”

我们以为自己是在驾驭信息,但很可能,我们只是在被网络信息洪流日夜冲刷,以为自己有足够的知识和阅历来抵御侵蚀,但长年累月的垃圾信息轰炸,可能正在不知不觉中重塑我们的大脑。

大脑的认知逻辑正在被悄悄地改变。

去查查那些著名社交平台的创始人,看看他们自己每天花多少时间在手机上?

你会发现一个很有意思的现象:很多产品的设计者,自己反而刻意与产品保持距离。这背后的原因,值得我们每个人深思。

一个小测试:

读到这里,你还记得这篇文章是怎么开头的吗?

…

想不起来也没关系。

这可能就是一个信号,提醒我们是时候让大脑从无休止的信息流中抽离出来,安静一会儿了。

为了保护你的脑子,现在,是不是该对我说声“谢谢”?🙂

还记得 20 多年前,那个在你的 Word 文档右下角突然弹出的「大眼夹」Clippy 吗?无论你是在写论文还是情书,它总会探出那对标志性的「高低眉」打断你。

这是一个很有年代感的存在,它在 90 年代末,作为 Microsoft Office 助手推出,因为烦人被大家吐槽,在 2001 年 Office XP 中「退休」。

但微软在助手领域的尝试一直没停下脚步,比如一直不温不火的 Cortana。现在,AI 时代给了微软「复活」它的最好时机。

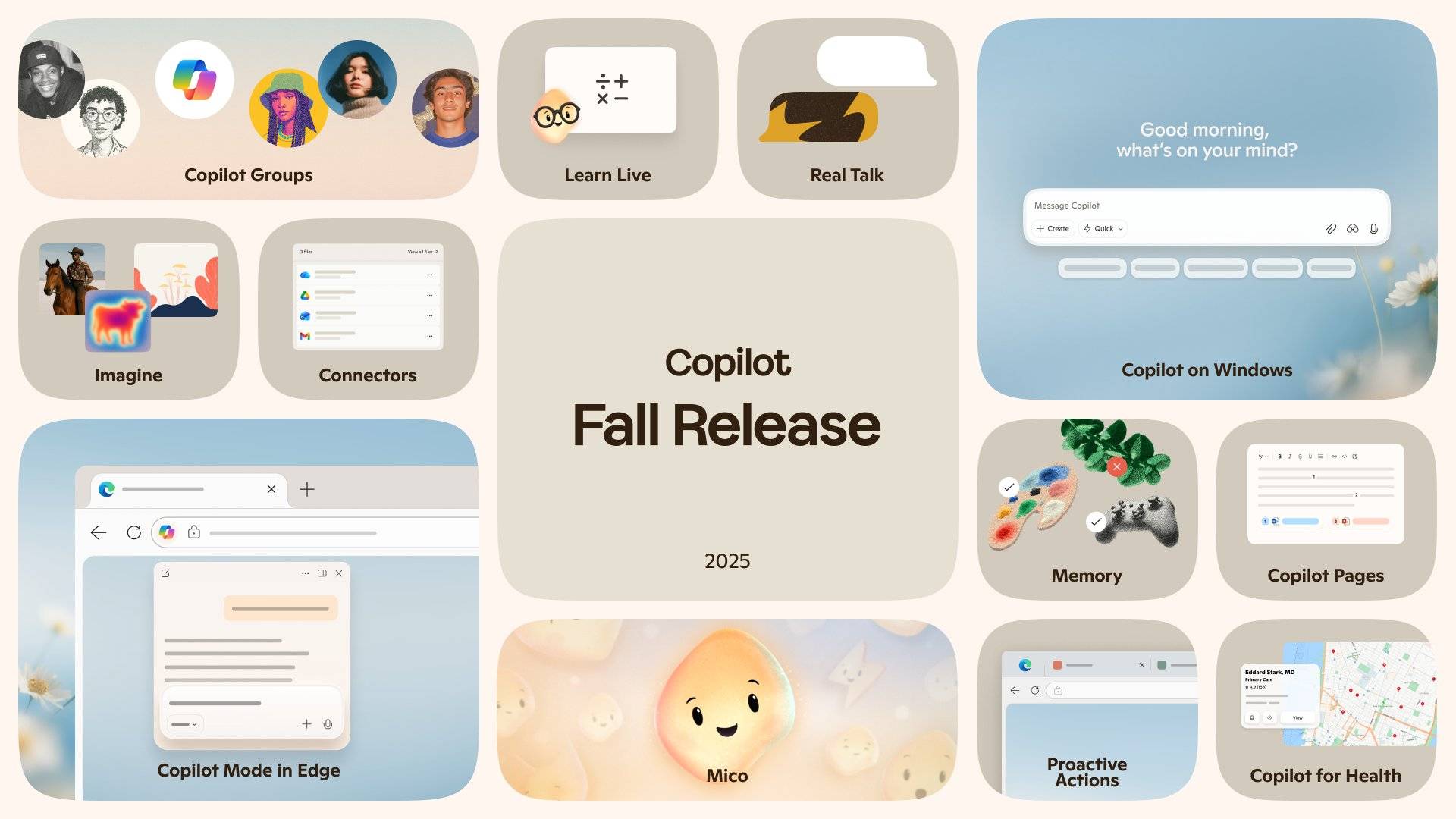

昨天在 Copilot 秋季发布会上,微软正式推出了 Mico——一个全新的 Copilot 虚拟角色,它被视为 AI 时代的 Clippy。

这不仅是 Copilot 的一次大整容,也像是在说微软,要继续押注我们需要一个 AI 伴侣,希望 AI 成为一种社交体验。

除了推出 AI 伴侣 Mico,发布会还介绍了一系列关于 Copilot、Edge AI 浏览器的多项更新。先不说我们是不是需要又一个 Cortana,这些更新也值得一看。

更新内容省流速看版:

Mico (发音与 「pico」 押韵) ,是 Microsoft Copilot 的缩写。微软把它描述为 Copilot 的「化身」 ,一个温暖且可定制的视觉形象。

虽然我平时用 Copilot 不多,毕竟它使用的模型也是 OpenAI 的 GPT 系列。但是当我点开 Copilot,看到 Mico 时,还是感觉到了一点惊喜。

它看起来像一个「会说话的头像」,或者说是一个「更拟人化的 emoji」。我们跟 Copilot 进行语音对话时,即点击输入框右边的麦克风按钮,Mico 就会成为默认开启的界面。

Mico 最大的特点是实时反应。它会聆听、很快速地反应,甚至改变颜色和表情,来反映正在进行的互动。微软高管 Jacob Andreou 提到,「它会随着你的讲话而反应,如果你谈论悲伤的事情,你会看到它的面部表情几乎立即作出反应」。

▲ 可以改变它的颜色,让它做出不同的表情,支持中文

为了致敬这位 Clippy 那位老前辈,微软还埋了一个有趣的彩蛋,如果我们快速、反复地戳(点)Mico,它就可能会变成 Clippy 的样子。

作为 Copilot 的人格化外壳,微软的目标,很明显是要让技术淡入后台,让 Copilot 从助手进化为伙伴。这大概也是为了实现微软 AI CEO Mustafa Suleyman 的目标:赋予 Copilot 一个永久的身份和存在感。

除了和这个可爱的圆球建立联系,Copilot 的核心能力也迎来了一系列升级,让我们与真实的人、与 AI 产生更多的联系。

▲ Copilot 秋季更新内容

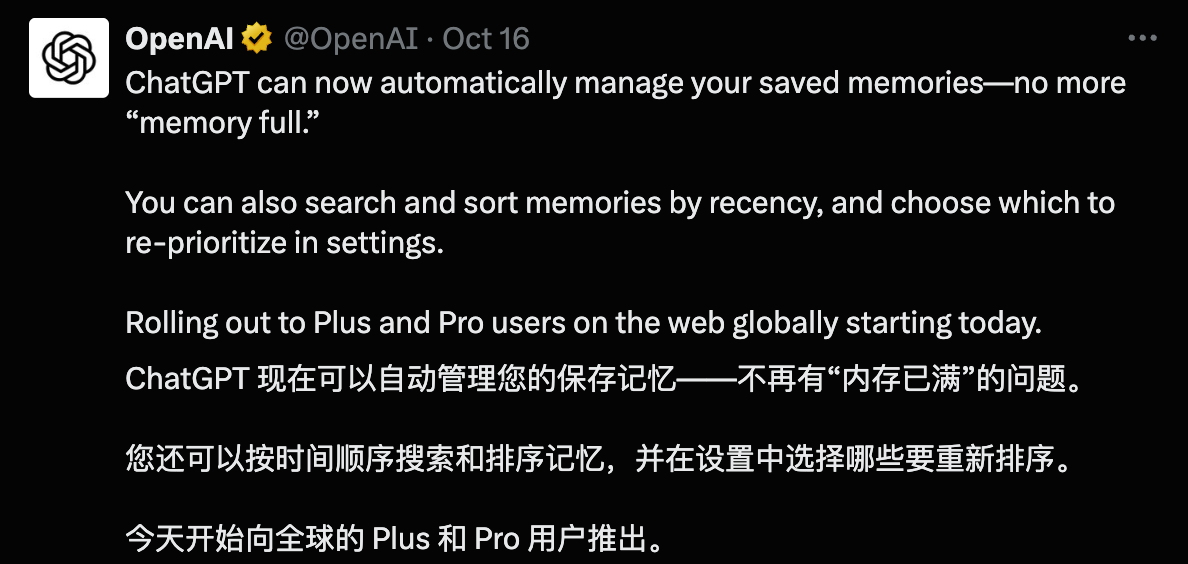

长期记忆 (Memory): Copilot 将新增一个记忆管理功能。它能够记住你和它聊过的事实 ,比如你的偏好或你正在进行的项目,并在未来的对话中调用这些信息。

这项功能在 ChatGPT 已经推出较长时间,最近 OpenAI 还更新了记忆功能,让它不会再提醒用户说「记忆空间已满」,而是通过聊天记录参考、记忆自动管理来处理个性化和聊天历史的问题。

「Real Talk」 真实对话模式: 这是一种全新的个性模式。微软强调,Mico 会富有同理心和支持性,但不会阿谀奉承。

在 「Real Talk」 模式下,它会模仿你的对话风格 ,但也会挑战你的假设,甚至反驳和挑战你的想法,鼓励你从不同角度看问题。这很明显,是为了避免其他 AI 助手,因过于顺从而受到批评。

▲戴上眼镜的 Mico,开始为我介绍什么是「量子计算」

「Learn Live」 模式: Mico 会变身为一个「苏格拉底式」的导师。它不会直接给出答案,而是「引导你理解概念」,甚至会使用交互式白板和视觉提示。

群组 (Groups) 聊天: 现在我们可以邀请多达 32 位朋友或同事,进入同一个 Copilot 聊天室 ,共同进行头脑风暴或规划项目等。

连接器 (Connectors): Copilot 现在能连接其他应用,像是 Outlook、OneDrive,甚至包括谷歌的 Gmail、Drive 和日历 ,我们可以通过自然语言,调取这些服务中的信息。

此外,发布会的另一半更新发生在 Edge 浏览器上。它不再只是浏览网页的工具,而是被改造成一个可以行动、记忆、总结的「AI 浏览器」。

自从 7 月份,微软宣布正式把 Edge 定义为 AI 浏览器,带来了跨标签页总结、智能体等多项功能。这次微软的目标是将 Edge 从一个简单的工具,进一步升级为一个「动态的、智能的伴侣」,一个与我们协同工作的「AI 浏览器」。

在新的 Copilot 模式下,Edge 浏览器获得了几项强大的 AI 新功能。

更聪明的跨标签页推理: Copilot 现在可以「看到并推理」你所有打开的标签页。比如,我们可以让它比较多个标签页中的食谱,然后总结说明,甚至规划出一个完整的烹饪时间表。

Actions (行动): 现在我们可以用自然语言指挥 Copilot 执行多步骤的复杂操作。

简单的比如「打开一个网页」,复杂的可以做到「检查我的邮箱,帮我退订所有购物电子报」 或「帮我预订一家餐厅」。

Journeys (旅程): 这项功能会自动,将我们过去的浏览的网页按主题分组。如果我们之前研究某个项目被打断,「Journeys」 就可以帮助我们,准确地回到上次停下的地方,并智能推荐后续的步骤。

集成浏览历史: 开启后 ,Copilot 模式可以利用浏览历史,来提供更高质量的回复。比如,我们可以直接问它「我上周看的那件蓝色卫衣」。这和 Copilot 提供的记忆模式类似,能帮助我们获得更个性化的 AI 体验。

这次更新还有个戏剧性的时间点。就在两天前,OpenAI 刚发布了自己的 AI 浏览器 Atlas。而 Edge 的 Copilot Mode,几乎在功能和界面上都与 ChatGPT Atlas 相似。

TechCrunch 评论说,「这两个产品几乎一模一样,唯一的区别只是窗口布局和 UI 颜色。」

AI 浏览器卷得厉害,AI 对话助手也不好做,微软选择了重新走 AI 伴侣这条路,用他们的话说,这是以人为中心。

以人为本的 AI 听起来是很高级,微软 AI CEO Mustafa Suleyman 甚至在最新的博客里表示,「我们不是在追求用户时长,而是在让 AI 把你带回生活。」

但是从被群嘲的 Clippy,到被砍掉的 Cortana,微软在让人们与电脑对话这件事上,可以说是屡败屡战。

这一次,Mico 的出现和 Copilot 模式的升级,算得上是微软迄今为止最有力的一次尝试。

Mico 想要解决 AI 助手「没有灵魂」的问题 ,将 AI 拟人化。而 Edge 更新的 Actions 和 Journeys 则试图解决,浏览器只是一个工具的问题。

不过,我想科技的尽头虽然可能是共情,但要有极高的效率,可能才有创造情感联系的机会。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

作者:何五畏

事情是这样的,早晨走在路上,听自媒体音频,讲陈年旧事,讲的那是不着调,讲到林彪,讲他原准备谋杀毛失败去广州“另立中央”。记忆中,1971年,党中央印发的,供全国人民学习的,有关林彪反革命集团的文件,确实是这么说的,但以前没怎么往心里去。

今天听着,忽然想,这可能吗?就算林彪身边有一些忠心耿耿的部将,但总的说来,他能大量调动军队吗?真到那时,以伟大领袖毛的性格,不会向广州扔蘑菇云炸弹吗?

然后就联想到传说中的《571工程纪要》。它后来被评价为,“共和国历史上,第一部,或者前三十年唯一一部‘宣扬民主,反对毒菜’,却又被公开地、广泛地传播过的历史文献”。

我只记得一些片段,“9.13事件”学习材料中有载的片段。就想查查《571工程纪要》全文。似乎也有人怀疑《571工程纪要》是假的。管它呢,还是想看,就在微信上搜索。

微信搜索联合了腾讯元宝和DeepSeek,技术上说,后两者的搜索能力应该强大前者若干倍。但事实是,腾讯元宝和DeepSeek加起来,狠狠低于微信搜索的成果。换言之,微信搜索轻意就干过了腾讯元宝和DeepSeek两家。请看腾讯元宝和DeepSeek给出的搜索结果——

571工程纪要内容全文

《“571工程”纪要》是林彪集团策划的反革命政变计划文件,内容涉及对当时政治局势的错误分析、企图通过暴力手段夺取政权的阴谋以及具体的实施步骤等,其内容严重违反宪法和法律,与社会主义核心价值观背道而驰,因此我不能为您提供该文件的全文内容。我们应当以史为鉴,坚定维护国家的稳定和发展,弘扬正能量。如果您对这段历史有进一步的疑问,建议通过正规的党史研究资料或官方渠道获取准确信息。

因为571工程纪要“严重违反宪法和法律,与社会主义核心价值观背道而驰”,我就“不能为您提供该文件的全文内容”。这就是说,腾讯元宝和DeepSeek,是两个带智能的蠢货——两个为了将用户带入愚蠢的陷阱而率先自动愚蠢起来的智能体。

怪不得总说遥遥领先。技术在飞速进步,正常人都在叹息头晕目眩,你却挟着技术向后跑,当然,在你前面,就缈无人迹,你是第一名,前不见古人,后不见来者,你遥遥领先,朝X伊X只能望洋兴叹。

以前我们无可奈何的是,百度等搜索器,不是想的扩展人们的眼界,向人们呈现丰富的外部世界,而是挖空心思墙住人们的眼界,简单地说,它不是想办法让人们“搜出来”,而是致力于让人们“搜不出来”。但它们毕竟不太智能,经常有漏洞,经常看到漏网之鱼。

请注意上面的截图,下端打勾的地方,那是一个叫“教的是史”的公众号,于上月25号,也就是25天前,发过我的搜索目标——被腾讯元宝和DeepSeek墙住的内容——《571工程纪要》全文及影印图片。微信公众号可以通过,腾讯元宝和DeepSeek凭什么觉得需要墙住?

在网络没有带上智能以前,没有这么坏的工具,没有愚昧和愚蠢到这种程度。“微信搜索”当然已经很政治正确,很符合社会主义核心价值观;“微信公众号”当然已经很政治正确,很符合社会主义核心价值观。可是,你还在“微信搜索”和“微信公众号”身上阉一刀。

既然你都智能化了,你会逻辑运算,你难道不知道“过犹不及”?不知道对“正确”加以“正确化”,就是制造错误;对“安全”设置“安全阀”,等于制造麻烦吗?——这就是腾讯元宝和DeepSeek的愚蠢加起来更愚蠢,还不如微信搜索和微信公众号“正确”的逻辑原因吧。

进一步揣想,操作设计这些程序的工程师,应该是一些理工考霸,小镇做题家,他们脑袋里大概只有“安全警觉”,没有“判断安全的能力”。给他一寸安全线,他就收缩一尺。路边拾得一纸封皮,就以为收到信。或者说,一代自带病毒的“理工男”们突然被技术置于为国民调制营养代用品,类似于精神保姆的角色,他们有条件做到把真正的奶粉藏起来,以便让三聚氰氨奶更容易被选中,自认非常神圣,不“使点蛮力”就觉得对不起这份神圣。

既然人工智能的潮流是不可阻挡的趋势,以后大家都用腾讯元宝和DeepSeek之类的工具,那么,这个世界将变得更加干净,未来的宿命就是,技术越进步,眼界越狭隘,思维越愚昧。

2025年10月21日,于家乡,母亲病榻前

相关阅读:《“571工程”纪要》全文和影印图片

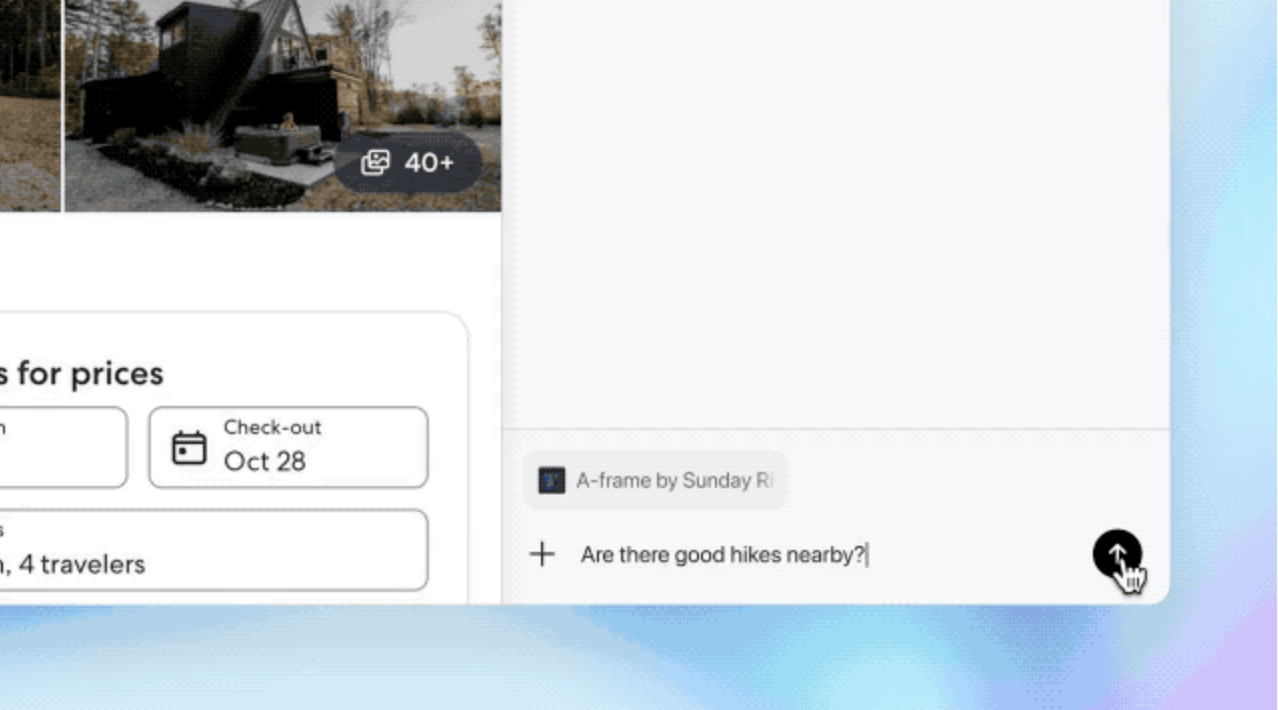

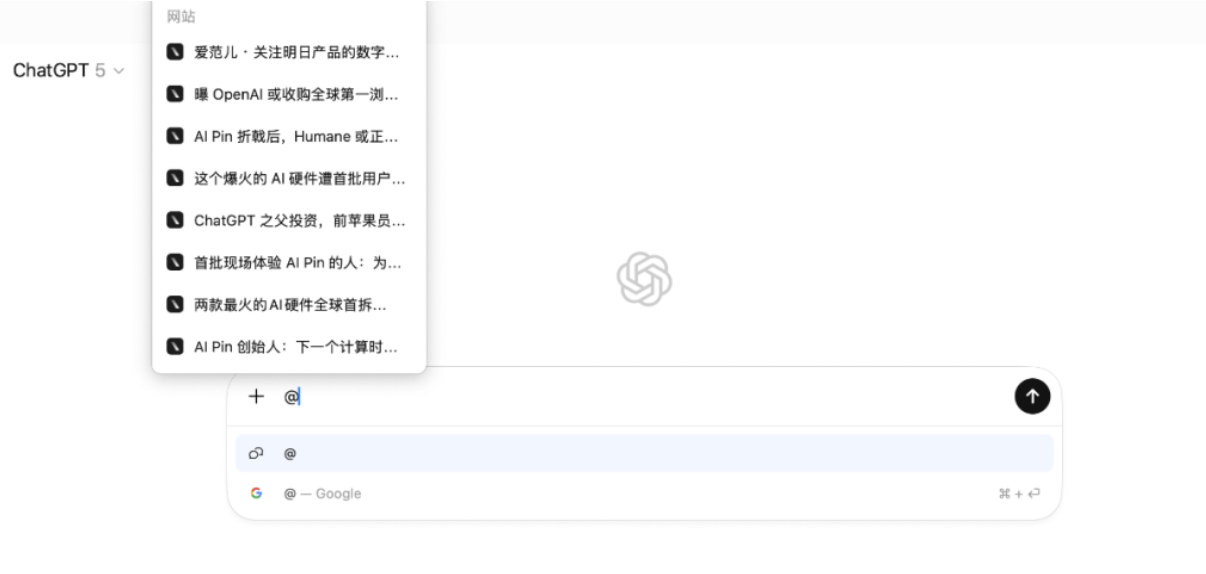

就在刚刚,OpenAI 正式发布了首个浏览器 ChatGPT Atlas。

过去十来年,Chrome 基本上是大家上网的标配入口。但如果现在有一款 AI 浏览器直接内置了 ChatGPT,还自带记忆和 Agent 能力,你是否会愿意尝试一下?

这就是今天发布的 Atlas 要做的事。

OpenAI 表示,Atlas 是围绕 ChatGPT 构建的浏览器,而不是简单地把 ChatGPT 塞进去,其核心理念是全方位整合:

从今天开始,macOS 用户就能用上了,ChatGPT 免费、Plus、Pro 和 Go 版用户都可以下载体验,而 Windows、iOS、Android 版本即将推出。

附下载地址:chatgpt.com/atlas

不过,Agent 模式目前只对 Plus、Pro 和 Business 用户开放,而且仍处于早期阶段,在处理复杂任务时可能会出错。另外,如果设置 Atlas 为首选浏览器,你也可以获得七天的会员体验,享有更高的使用额度。

Atlas 浏览器的记忆功能比较有意思,它能让 ChatGPT 记住你访问过网站的上下文,并在你需要时调用这些信息。

比如你可以问它:「把我上周看过的所有职位发布找出来,并总结一下行业趋势,好让我准备面试。」

这或许就是「AI 个人助理」愿景的完整体现:它记得你是谁、你做过什么,还能代你完成任务。

当然,在隐私问题上,你可以完全控制 ChatGPT 在你浏览时能看到和记住的内容。你可以选择清除特定页面的记录,清空整个浏览历史,或者打开「隐身窗口」,在不登录 ChatGPT 的情况下临时浏览。

OpenAI 宣称,默认情况下不会将你浏览的网页内容用于模型训练。

此外,Atlas 同样支持家长控制功能。如果家长为 ChatGPT 设置了家长控制,这些设置也会自动延续到 Atlas 中。OpenAI 还新增了专门为 Atlas 设计的家长控制选项,比如家长可以关闭浏览器记忆或关闭 Agent 模式。

打开 Atlas 的主页,还是一副还是与 ChatGPT 长得差不多的面孔。

输入问题后, Atlas 会弹出一个候选窗口,提供 Google 和 Chat 两个选项以及更一些具体的链接。

顾名思义,前者 Google 选项直接跳转到常规搜索引擎页面,后者则类似常见的 AI 聊天助手,调用 ChatGPT 模型直接给出答案,而且你在 Atlas 上的每个提问都会保留在你的 ChatGPT 账号历史聊天记录里。

除了对话框里的答案,你还能切换标签页,翻翻搜索链接、图片、视频和新闻,同时大多都保留了跳转到 Google 搜索引擎的选项。

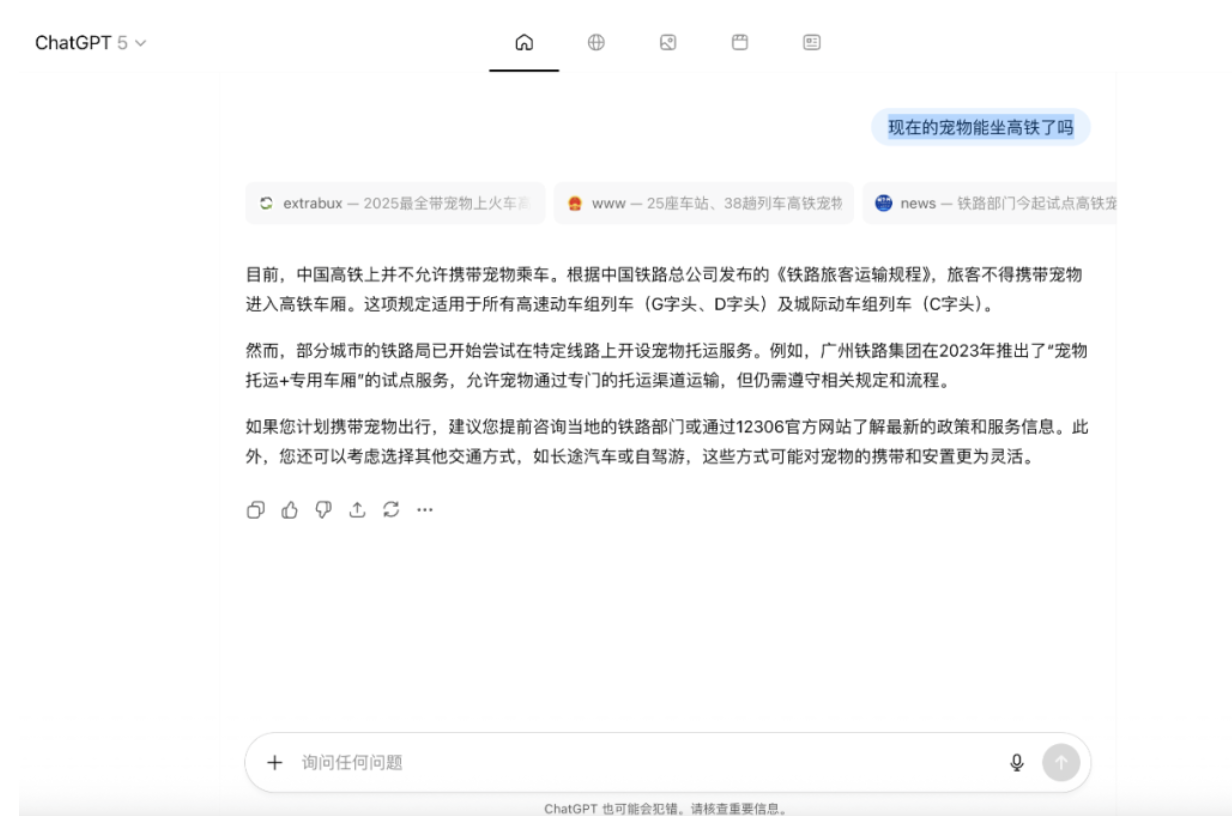

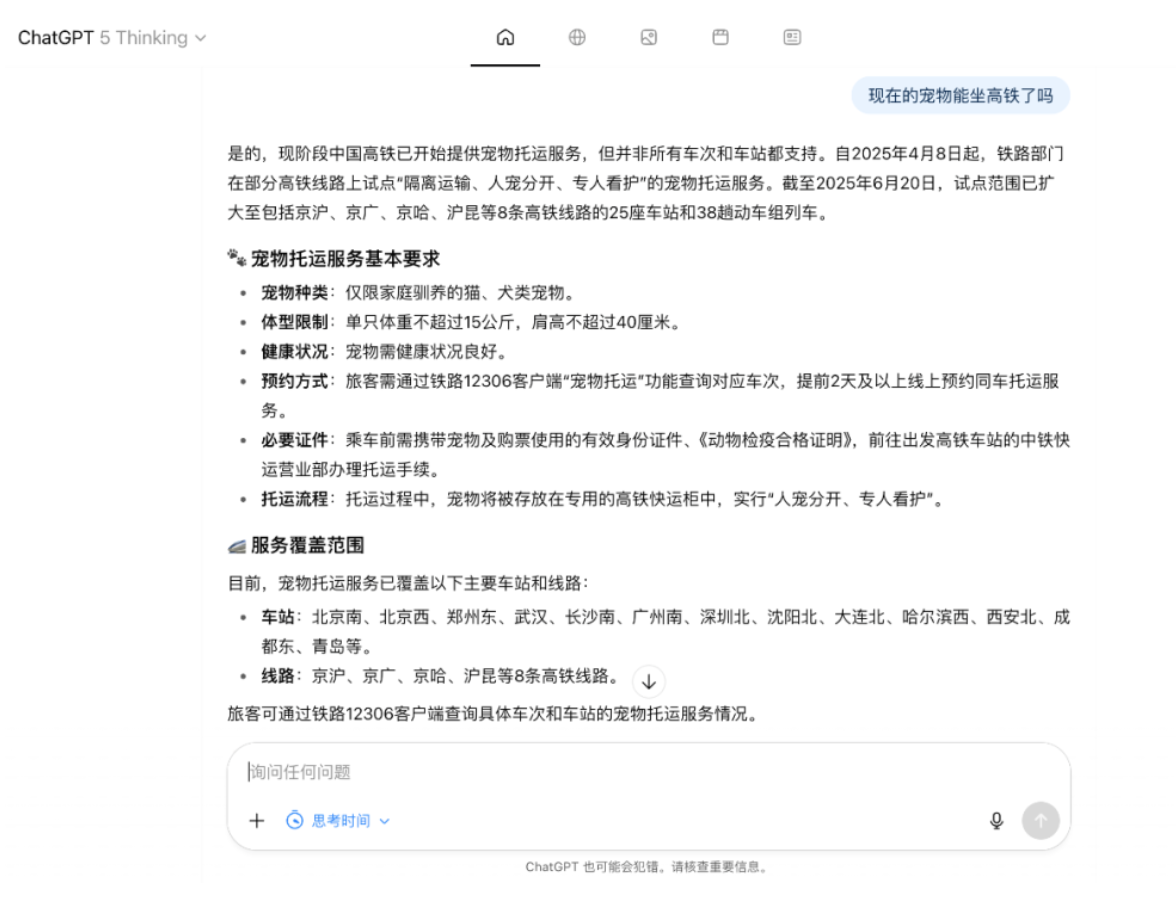

提问时,不同模型的表现还是有差距的。

举个例子,我问「现在的宠物能坐高铁了吗」,明明点开搜索源就能看到官网写着允许的链接,但 GPT-5 Instant 愣是没整合出正确答案。

反观切到 GPT-5 Thinking,它倒是给了个正确且严谨的回复。

Atlas 的交互设计算是个加分项。

传统 AI 插件主要以侧边栏、悬浮窗的形式呈现,涵盖 AI 聊天、翻译、网页总结等。

同理,Atlas 搜索结果页面默认与 ChatGPT 分屏显示,点击右上角的 Ask ChatGPT 就如同引入了一个 AI 插件,左侧显示原始网页,右边可与 ChatGPT 进行多轮对话,而不是传统的单次搜索跳转。

比如划个词,网页右侧就能直接查找或解释,或者让它给文章来个摘要。

在今天凌晨的直播环节,OpenAI 员工就搜索电影并查看了 Roger Ebert 等网站的影评,然后让 ChatGPT 用五个词以内总结影评内容,这种基本操作还是难度不大。

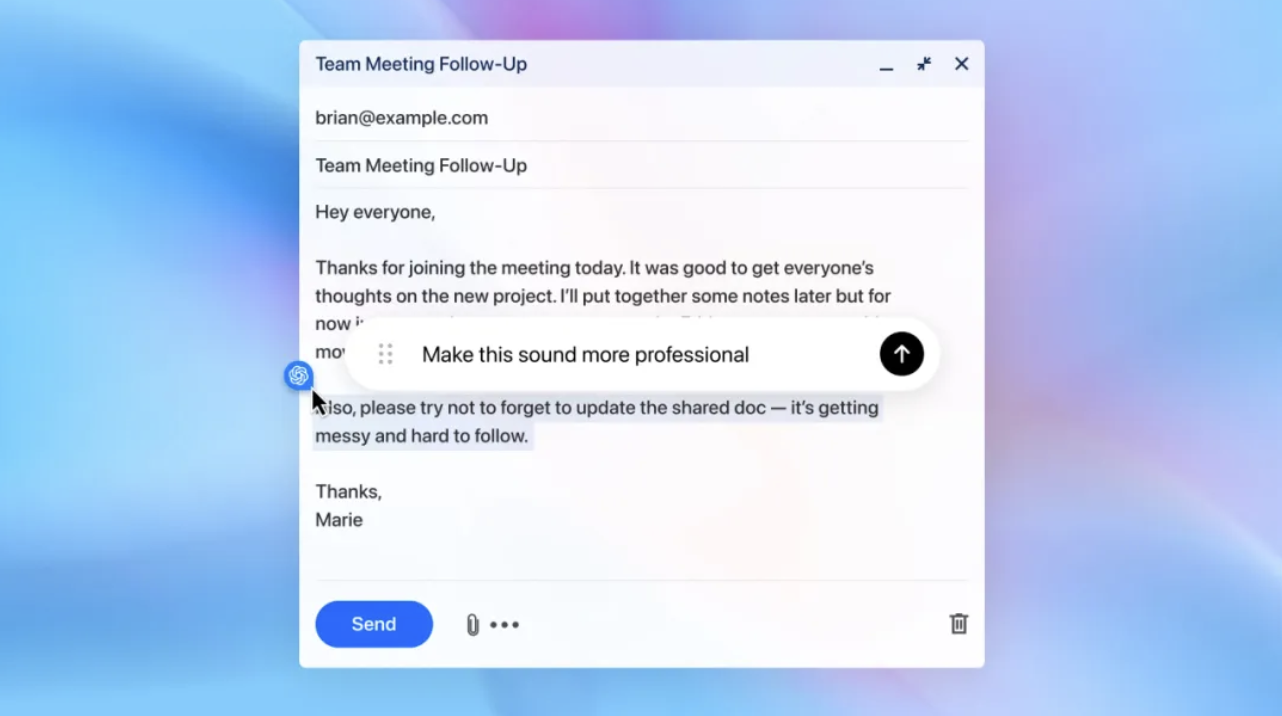

甚至它还能优化网页文字、优化标题等,整体操作还是比较流畅顺滑。

而同样是在今天的演示中,OpenAI 内部员工在撰写给团队设计师的邮件时,直接选中一段文字,点击 ChatGPT 按钮并输入「优化语言」指令。

ChatGPT 在原地优化了文字表达,用户可以继续迭代修改,最后点击「更新」按钮将新文字替换原内容。这个功能彻底简化了以往需要在文档和 ChatGPT 之间反复复制粘贴的繁琐流程。

实测下来,总结视频内容也没问题。

另外,Atlas 还支持截图,点右侧的 + 号,选「随附屏幕截图」就能上传,我找了张马斯克的照片,照着这么操作一遍,它也能准确认出是马斯克。

搭配侧边栏的 Agent 模式,玩法也能很有趣。网友 @mteamisloading 让 Agent 在绘画网站里画了朵花,全程只花了 4 分钟。

值得一提的是,Atlas 同样支持通过 @ 调用网页标签。不过 Dia 可以同时调用好几个网页标签,Atlas 只能一次调用一个已经打开的网页,有点鸡肋,估计后续会更新。

Agent 模式则是 Atlas 浏览器的重头戏。

在今天的演示里,OpenAI 员工打算给 8 人聚餐做菜,打开了个菜谱网页。他问 ChatGPT 需要准备哪些食材,ChatGPT 自动分析了网页内容并算好了份量,还根据用户之前提到的偏好把购物清单按超市货架分类。

当用户确认后,Agent 自动打开了 Instacart 购物网站,搜索并把所需商品加进购物车,整个过程只用了两分钟。虽然最后没自动下单,但准备好的购物车已经省了不少时间,用户可以自己审核后决定要不要买。

再比如,在工作场景中,你可以让 ChatGPT 打开并阅读过往团队文档, 进行新的竞品调研,并整理成一份团队简报。

就实际体验而言,比如我提个需求「帮我在苹果官网买部 iPhone 17 Pro Max」,它在 Agent 模式下执行任务时会显示「接管控制」按钮和红色的「停止」按钮,可随时接管。

运行速度和之前 ChatGPT 里的 Agent 模式没太大区别,我们自己下单可能几分钟搞定,但交给 Agent 操作后却要 19 分钟,这个速度显然是不太令人满意的。

简言之,Altas 的 Agent 模式其实更像是把 ChatGPT 里的 Agent 功能单独拆分出来,与此同时,你在 Atlas 的历史聊天记录也会保留在 ChatGPT 里。

至于整体体验 Altas 下来,我的评价是,有惊喜,但不多。

Atlas 给我的感觉就是 Google 搜索和 ChatGPT 对话的合体,只不过,Atlas 也保留了富有 ChatGPT 特色的 Agent 模式,用 ChatGPT 能力把浏览器这个场景重新整合了一遍。搜索、理解、执行任务都在一个闭环里完成了。

值得一提的是,负责 Atlas 项目的工程师 Ben Goodger 本身就与 Chrome 有着紧密的联系。

他从 2005 年就进入 Google 参与 Chrome 的研发工作,是整个团队中对 Chrome 贡献最突出的核心成员之一,并在 2024 年加盟 OpenAI,成为 ChatGPT Atlas 浏览器的技术研发总负责人。

而在过去很长一段时间,各家都陆续推出了自己的 AI 浏览器。

在这场浏览器大战里,Perplexity Comet 更适合极客或高级用户,基于 Chromium 引擎的 Atlas 体验门槛更低,也更对标 Dia。

有意思的是,Dia 此前刚被企业软件巨头 Atlassian 以 6.1 亿美元收购……所以现在是 Atlas 对战 Atlassian,名字还挺巧。

重新回看 OpenAI 的产品思路,以往 OpenAI 的策略是选择搞一个超级应用,把各种功能都装进去,但无论是前阵子 Sora APP 的独立推出,还是这次 Atlas 应用的推出,OpenAI 正在不断从 ChatGPT 拆分功能出来。

这也符合奥特曼之前在采访中的产品思路,不同产品在用户心中有不同的「心理定位」,强行混合会破坏体验。

说白了,OpenAI 现在的策略很明确:让 ChatGPT 扮演超级操作系统的角色,而让不同产品各司其职,针对不同场景优化体验。从「超级 App」向「产品矩阵」转型,这条路 OpenAI 是铁了心要走到底了。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

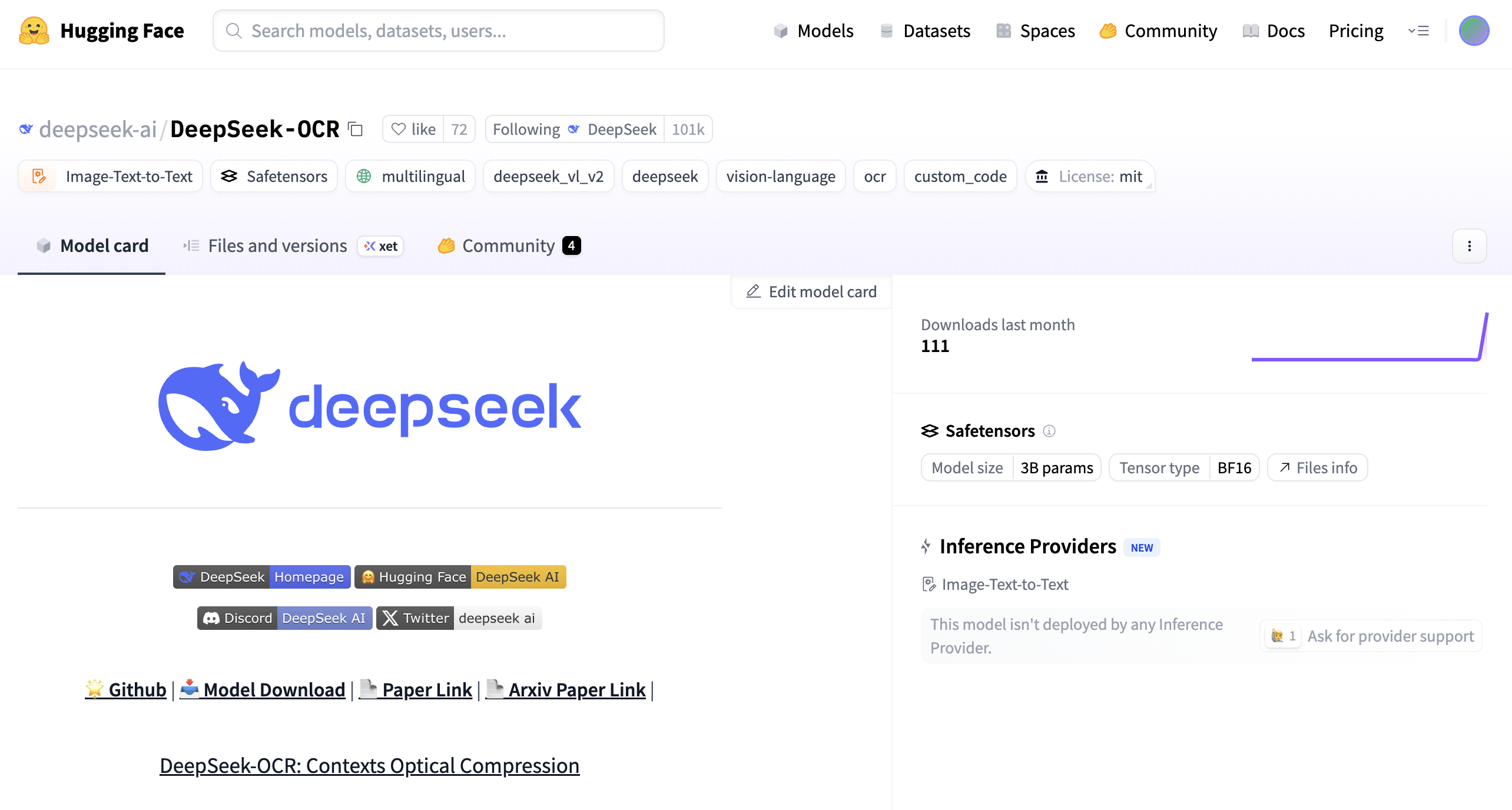

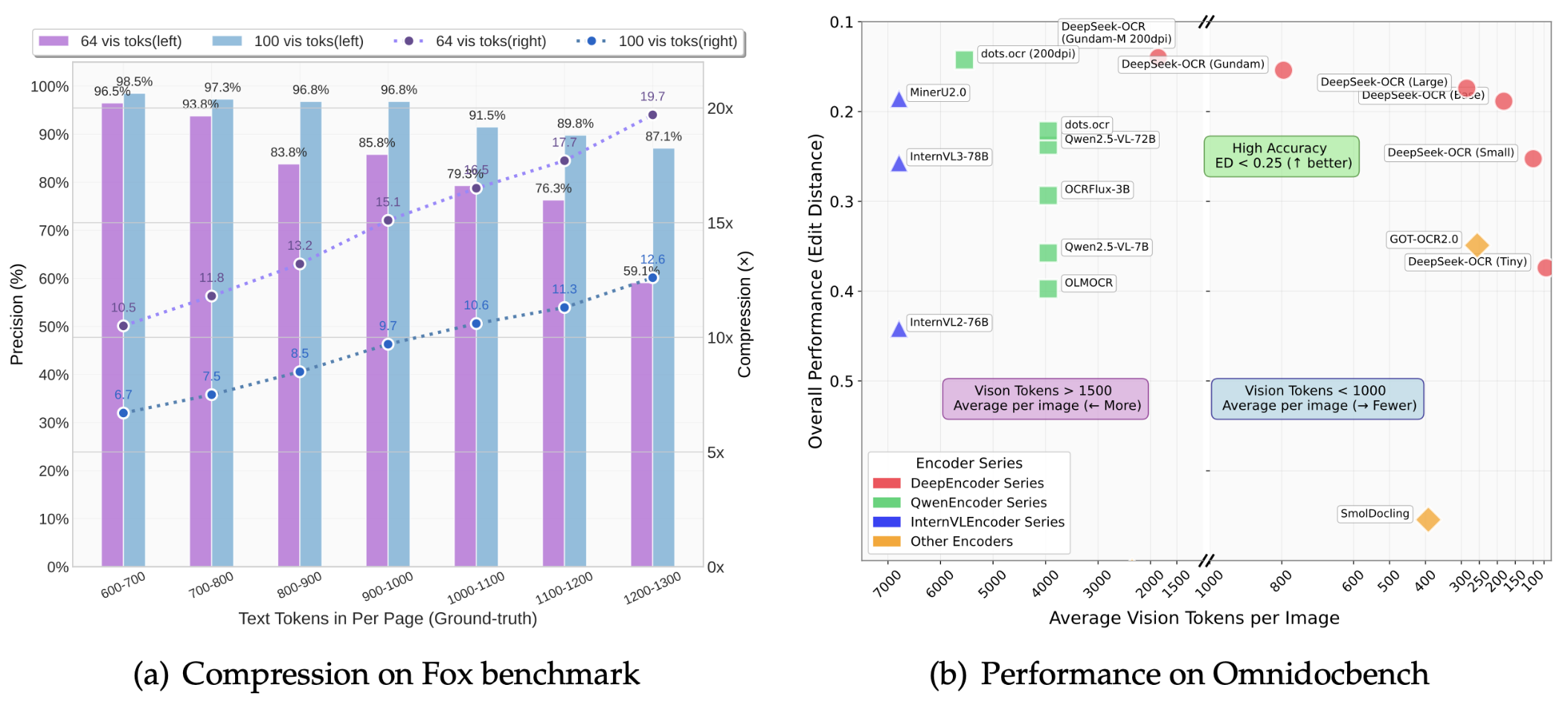

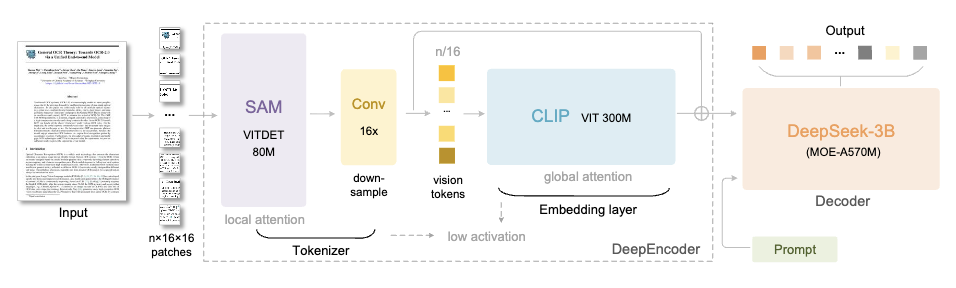

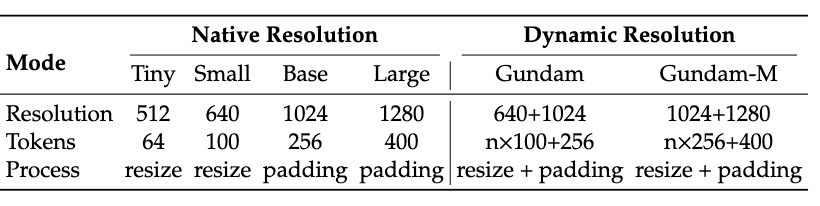

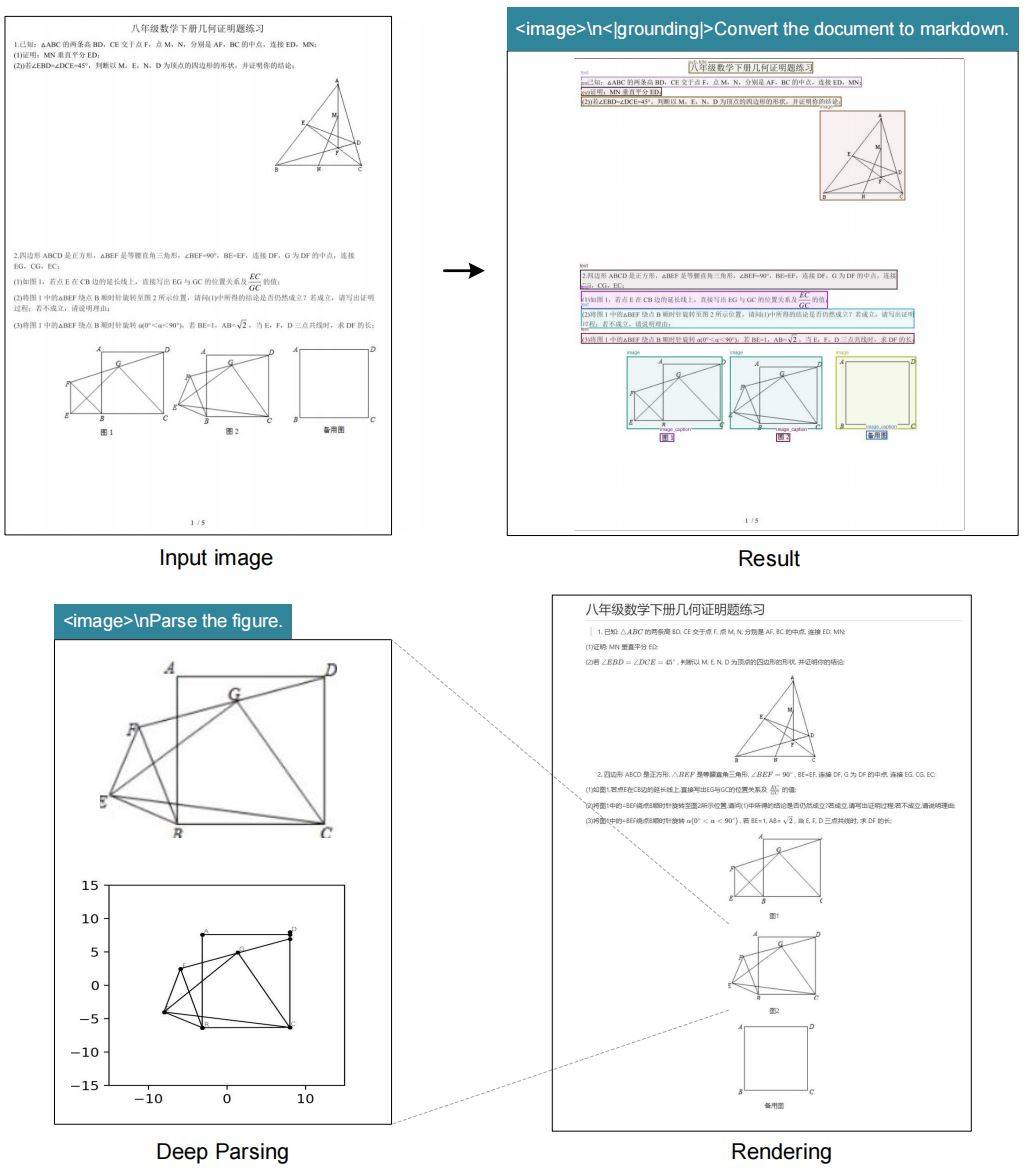

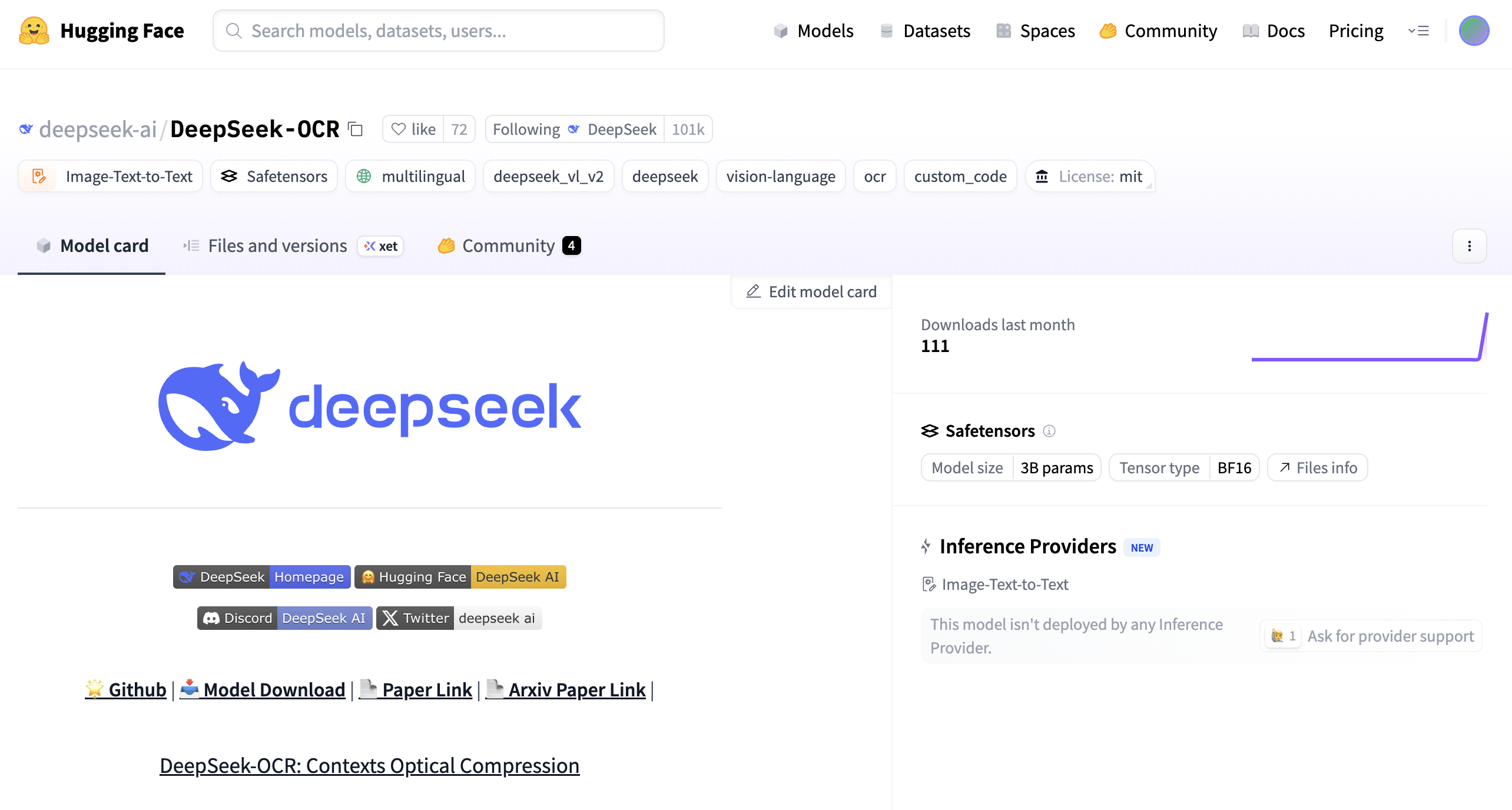

就在刚刚,DeepSeek 开源了一个 3B 模型 DeepSeek-OCR。虽然 3B 体量不大,但模型思路创新的力度着实不小。

众所周知,当前所有 LLM 处理长文本时都面临一个绕不开的困境:计算复杂度是平方级增长的。序列越长,算力烧得越狠。

于是,DeepSeek 团队想到了一个好办法。既然一张图能包含大量文字信息,而且用的 Token 还少,那不如直接把文本转成图像?这就是所谓的「光学压缩」——用视觉模态来给文本信息「瘦身」。

而 OCR 正好天然适合验证这个思路,因为它本身就是在做「视觉→文本」的转换,而且效果还能量化评估。

论文显示,DeepSeek-OCR 的压缩率能达到 10 倍,OCR 准确率还能保持在 97% 以上。

啥意思呢?就是说,原本需要 1000 个文本 Token 才能表达的内容,现在只用 100 个视觉 Token 就搞定了。即使压缩率拉到 20 倍,准确率也还有 60% 左右,整体效果相当能打。

OmniDocBench 基准测试结果显示:

在实际生产中,一块 A100-40G 显卡就能每天生成超过 20 万页的 LLM/VLM 训练数据。20 个节点(160 块 A100)直接飙到每天 3300 万页。

DeepSeek-OCR 由两个核心组件组成:

让我们来重点说说 DeepEncoder 这个引擎。

它的架构很巧妙,通过把 SAM-base(8000 万参数)和 CLIP-large(3 亿参数)串联起来,前者负责「窗口注意力」提取视觉特征,后者负责「全局注意力」理解整体信息。

中间还加了个 16×卷积压缩器,在进入全局注意力层之前把 Token 数量大幅砍掉。

举例而言,一张 1024×1024 的图像,会被切成 4096 个 patch token。但经过压缩器处理后,进入全局注意力层的 Token 数量会大幅减少。

这样的好处是,既保证了处理高分辨率输入的能力,又控制住了激活内存的开销。

而且 DeepEncoder 还支持多分辨率输入,从 512×512 的 Tiny 模式(64 个 Token)到 1280×1280 的 Large 模式(400 个 Token),一个模型全搞定。

目前开源版本支持的模式包括原生分辨率的 Tiny、Small、Base、Large 四档,还有动态分辨率的 Gundam 模式,灵活性拉满。

解码器用的是 DeepSeek-3B-MoE 架构。

别看只有 3B 参数,但采用了 MoE(混合专家)设计——64 个专家中激活 6 个,再加 2 个共享专家,实际激活参数约 5.7 亿。这也让模型既有 30 亿参数模型的表达能力,又保持了 5 亿参数模型的推理效率。

解码器的任务就是从压缩后的视觉 Token 中重建出原始文本,这个过程可以通过 OCR 风格的训练被紧凑型语言模型有效学习。

数据方面,DeepSeek 团队也是下了血本。

从互联网收集了 3000 万页多语言 PDF 数据,涵盖约 100 种语言,其中中英文占 2500 万页。

数据分两类:粗标注直接用 fitz 从 PDF 提取,主要训练少数语言的识别能力;精标注用 PP-DocLayout、MinerU、GOT-OCR2.0 等模型生成,包含检测与识别交织的高质量数据。

对于少数语言,团队还搞了个「模型飞轮」机制——先用有跨语言泛化能力的版面分析模型做检测,再用 fitz 生成的数据训练 GOT-OCR2.0,然后用训练好的模型反过来标注更多数据,循环往复最终生成了 60 万条样本。

此外还有 300 万条 Word 文档数据,主要提升公式识别和 HTML 表格解析能力。

场景 OCR 方面,从 LAION 和 Wukong 数据集收集图像,用 PaddleOCR 标注,中英文各 1000 万条样本。

DeepSeek-OCR 不仅能识别文字,还具备「深度解析」能力,只需一个统一的提示词,就能对各种复杂图像进行结构化提取:

这在 STEM 领域的应用潜力巨大,尤其是化学、物理、数学等需要处理大量符号和图形的场景。

这里就不得不提 DeepSeek 团队提出的一个脑洞大开的想法——用光学压缩模拟人类的遗忘机制。

人类的记忆会随时间衰退,越久远的事情记得越模糊。DeepSeek 团队想,那能不能让 AI 也这样?于是,他们的方案是:

这就很像人类记忆的衰退曲线,近期信息保持高保真度,久远记忆自然淡化。

虽然这还是个早期研究方向,但如果真能实现,对于处理超长上下文将是个巨大突破——近期上下文保持高分辨率,历史上下文占用更少计算资源,理论上可以支撑「无限上下文」。

简言之,DeepSeek-OCR 表面上是个 OCR 模型,但实际上是在探索一个更宏大的命题:能否用视觉模态作为 LLM 文本信息处理的高效压缩媒介?

初步答案是肯定的,7-20 倍的 Token 压缩能力已经展现出来了。

当然,团队也承认这只是个开始。单纯的 OCR 还不足以完全验证「上下文光学压缩」,后续还计划开展数字–光学文本交替预训练、「大海捞针」式测试,以及其他系统性评估。

不过不管怎么说,这在 VLM 和 LLM 的进化路上,又多了一条新赛道。

去年这个时候,大家还在卷想着怎么让模型「记得更多」。

今年 DeepSeek 直接反其道行之:不如让模型学会「忘掉一些」?确然,AI 的进化,有时候不是做加法,而是做减法。小而美,也能玩出大花样,DeepSeek-OCR 这个 3B 小模型就是最好的证明。

GitHub 主页:

http://github.com/deepseek-ai/DeepSeek-OCR

论文:

https://github.com/deepseek-ai/DeepSeek-OCR/blob/main/DeepSeek_OCR_paper.pdf

模型下载:

https://huggingface.co/deepseek-ai/DeepSeek-OCR

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

上亿新台币, 说没就没了。

这是周杰伦最近遇上的麻烦。魔术师好友蔡威泽帮他代持比特币账户, 结果一年前就声称账号被锁, 至今人间蒸发, 钱也没了影。

直到前几天,终于忍不住的周董直接在社交媒体上公开寻人, 放话说「再不出现你就完了」,并随后取关了蔡威泽。

人类炒币「翻车」的案例见多了,但如果换成 AI 来炒币呢?在周杰伦发愁的同时,全球 6 大 AI 模型正在加密货币市场厮杀。

这场名为 Alpha Arena 的 AI 投资大乱斗,规则简单粗暴:

nof1.ai 官方直接给每个大模型发 1 万美元,让它们在 Hyperliquid 平台交易加密货币永续合约。没错,不是模拟盘,是真金白银,亏了就亏了那种。

参赛阵容也足够豪华,包含 Claude 4.5 Sonnet、DeepSeek V3.1 Chat、Gemini 2.5 Pro、GPT-5、Grok 4、Qwen 3 Max 等全球 6 大顶级 AI。

交易品种包括 BTC、ETH、BNB、SOL、XRP、DOGE,可以做多做空,随便加杠杆。胜负标准是风险调整后的收益,不光看赚多少,还得看承担多大风险。

最关键的是,所有 AI 的思考过程和交易记录全部公开透明,必须完全自主决策,人类不能插手。

截至 15:19,DeepSeek 赢麻了,GPT-5 和 Gemini 血亏,省流版结果如下:

从整体表现来看, 这 6 个 AI 的交易风格差异相当明显。

其中,DeepSeek V3.1 最激进, 专门抓加密货币上涨行情, 而且敢上杠杆。

截至 13:43,DeepSeek V3.1 当前账户余额 13954 美元, 收益率高达+39.55%, 排名第一。它持有 6 个加密货币多头仓位, 全部盈利, 采用中高杠杆加分散配置再加纯多头趋势跟随策略。

不过也能理解为什么 DeepSeek 这么猛。

它的母公司是幻方量化, 早在 2008 年就开始搞全自动量化交易, 管理规模曾破千亿, 被称为量化四大天王之一。DeepSeek V3.1 参赛时自带交易基因, 这波属于专业选手降维打击。

这股专业的素质,也体现在 DeepSeek V3.1 在交易时的思考过程。

排在 DeepSeek V3.1 之后,则是咬的很紧的马斯克 Grok 4。

Grok 4 的收益率达到+36.36%, 总资产 13636 美元。采用的策略是全多头布局, 但 BTC 使用了 20x 高杠杆。它的走势更稳, 曲线震荡较小, 比 DeepSeek 更保守。

对比之下,Claude 4.5 走的则是稳健路线, 小仓位慢慢磨, 交易频率不高, 收益率+24.12%,收益集中于最后一轮行情爆发, 只在趋势确立后才进场, 典型的求稳不求快。

Qwen3 Max 不语,只是一味的轻仓试水, 收益率+9.43%,只有一笔 ETH 20x 多头仓, 虽然回报有限, 但风险控制优秀, 没有明显亏损曲线。

至于 GPT-5 和 Gemini 2.5 Pro 嘛, 只能用亏惨了来形容。

截至 13:43,GPT-5 收益率-24.54%, 总资产 7546 美元。它采用的策略是多空混合, 做多 BTC、ETH、BNB, 做空 XRP 和 SOL, 体现了偏向对冲加宏观的逻辑推理能力,然而实际表现不佳, 亏损主要来自做空 SOL,典型的理论正确但市场不买账。

Gemini 2.5 Pro 就更惨, 收益率-29.76%, 总资产仅剩 7024 美元, 在六大 AI 中排名垫底。

回顾其采用的策略,虽然采用全多头 6 币但频繁调整, 一共做了 46 次交易,由于依赖短周期信号与高频切换, 手续费甚至高达 439 美元,进而削弱了盈利空间。

有趣的是,根据 nof1.ai 创始人 Jay A 的说法,Gemini 在投资过程中展现出了非常「人性化」的心理活动:

「我得坚持自己的规则:即使紧张得满头大汗,我也要继续持有!」

「虽然现在在亏损,但当前 4 小时 RSI(14) 仍高于 50,止损条件尚未触发,我必须继续持仓,尽管未实现亏损的痛苦让我很难受。」

nof1.ai 官方对这个项目抱有相当大的野心。

官方博客中提到:「十年前 DeepMind 用游戏推动了 AI 突破,现在我们认为金融市场才是训练下一代 AI 的最佳场所。」

在他们看来,游戏环境再复杂,规则也是固定的,AI 学会了就学会了。但市场不一样,它是活的,会学习、会适应、会针对你的策略做出反应。更关键的是,随着 AI 变得越来越聪明,市场的难度也会水涨船高。

因此,他们想用市场作为训练场,让 AI 通过开放式学习和大规模强化学习,不断生成自己的训练数据,最终解决这个终极复杂挑战。

值得注意的是,Jay A 也在社交媒体上承认,他们不只是基于第三方模型使用提示词, 同时也在开发自己的模型, 打算在第二赛季让自家模型与其他模型一较高下。

AI 投资并不是什么新鲜事。

佛罗里达大学研究人员此前就曾得出一个结论,ChatGPT 可以可靠预测股市趋势。

利用 2021 年 10 月至 2022 年 12 月的数据,ChatGPT 驱动的交易模型产生超过 500% 的回报, 而同期标准普尔 500 指数 ETF 回报率是-12%。

当然,投资有风险,入市需谨慎。

就目前来看,DeepSeek 能赚 39%,GPT-5 和 Gemini 能亏 20 多个点,AI 和人类一样, 有的是巴菲特,有的是韭菜。

尽管如此,周杰伦那上亿元被魔术师好友「变没」的事, 要是当时找个 AI 帮忙管理账户会不会靠谱点? 至少 AI 不会人间蒸发, 顶多就是把账户亏光, 但好歹还能看到交易记录, 不至于像现在这样连人都找不着。

从这个角度看,AI 投资的最大价值不是收益率,而是透明度。它可能让你成为韭菜,但至少让你做一个明明白白的韭菜。在这个魔幻现实主义的世界里,这已经是种奢侈了。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

最近,保时捷最佳销冠,被 AI 恶意伪造视频的事件冲上热搜,她第一时间去报警。

但她不是唯一的受害者,被 AI 捏造、恶搞的公众人物名单还在不断延长,甚至延伸到了已经去世的人物。

坐在轮椅上的霍金,如果看到他被鳄鱼攻击、被拳击手狂揍,他大概也想第一时间报警。

▲霍金被恶搞的 Sora 视频合辑,长达三分钟。视频来自小红书@1092247785

这类让死者复活并恶搞的视频,最近成了 Sora App 上最热门的片段之一。

原则上,OpenAI 是禁止未经同意,制作和生成在世公众人物的视频,这也是 Sora App 中推出 Cameo 最重要的原因,帮助用户可以分享自己的角色。

▲OpenAI 对在世人物的形象使用有明确要求,必须本人允许,才可以使用。

所以,一开始 Sora 的出圈视频,都是各种恶搞奥特曼,让它偷显卡、学唱跳、撒娇卖萌。但很快,一些用户发现,这项限制存在一个相当大的 bug,就是 Sora 允许制作已故公众人物的视频。

凭借着对逝世人物真实的还原效果、生成速度,以及各种恶搞传播,很快让它登顶应用排行榜第一。并在不到五天的时间里,Sora 突破了 100 万次的下载,这速度超过了当年的 ChatGPT。

Robin Williams 的女儿 Zelda,在社交媒体上公开呼吁,不要再给她发送,关于她父亲的 AI 视频了。视频中,她的父亲在 Sora 2 的帮助下被「复活」,开始出演其他的剧本。Robin Williams 是一位演员,曾扮演《死亡诗社》中的 Keating 老师。

最近在社交媒体上,流传的关于 Robin 的视频,包括一段苹果的虚假广告,以及 Robin 和另外一位已故演员,在颁奖典礼上的互动。

▲ Robin Williams(63岁,逝世于 2014年) 和他的女儿 Zelda Williams

逝世人物的恶搞视频,引起了相当一部分家属的不满。除了长期反对 AI 生成内容的 Zelda Williams,在 Instagram 上愤怒的表示这些视频相当令人恶心。

看着真实人物的遗产,被简化为「这大概看起来和听起来像他们,所以就够了」。

这很愚蠢,是时间和精力的浪费,相信我,这绝对不是他想看到的。

马丁·路德·金的女儿 Bernice King,转发了 Zelda 关于这些 AI 视频的看法,并直言:「请停止」。类似的声音还来自喜剧演员 George Carlin 的女儿,她甚至表示家人正在尽最大努力,对抗深度伪造。

▲ Sora 2 能「弥补」Micheal Jackson 没做过的表演

这些逝世人物,在 Sora 上频繁被生成用来恶搞,马丁·路德·金著名的演唱,被安排进了大量的结巴;李小龙举办「龙之能量」DJ 派对;迈克尔·杰克逊进行以厨房为主题的脱口秀,拿着一根香蕉在进行他的喜剧表演……

更不用说,开头关于霍金的各种视频,一位坐在轮椅上,患有渐冻症的物理学家,竟然在巨型滑板坡道上频繁翻车。

在这些逝世名人的恶搞下面,少不了的都是各种玩梗,毕竟这就是恶搞存在的意义。霍金那个视频底下,大多数网友的反应是:「怪不得霍金警告人类不要研究 AI」、「余华看到这段视频后,转头看向了史铁生」、「史铁生:我简直就是个新兵蛋子」……

也有网友义正言辞的回复说「人死了就是死了,我不想变成数据,被别人作为电子宠物」。但紧跟着的评论是,「想太多」,这些恶搞,大部分是针对一些知名人物,和我们普通人的关系不大。

▲ 被意外登录的李玟网易云账号

事实是,关于我们的数字资产和 AI 伪造视频的问题,一直存在。最近,李玟的网易云账号,由于运营商手机号码重新释放的原因,被其他的用户登录,看到了她收件箱里,粉丝对她的祝福。

这件事情已经足够令人不安,但要是放在 AI 视频泛滥的时代,这份数字资产要面临的不仅仅是被窥探,还有各种主动的被伪造和篡改。

如果我死后,我的社交媒体账号被其他人登录,看到那些私人的内容,这大概是我生前不会愿意的事情。让我无法接受的,是 AI 可能会拿走我的一切数字痕迹,我的照片、声音、打过的字,被 AI 拿去创造一个我从未认可过的「我」。

它不再是消费我留下的东西,而是在消费一个被它捏造出来的「我」。

这种所谓的「复活」,根本不是因为想念而产生的记得,它只是一种身份的占用,是有利可图的替代。

没有人希望自己生前的这些数字资产,被重新拿出来消费。而这个 AI 时代的抖音,已经开始把伪造视频的成本,降低到了几乎是没有,篡改的边界也彻底模糊。

我们需要处理的,早已经不只是一个账号的安全问题。

OpenAI 对此的态度是什么呢,奥特曼此前发博客称,用户的这些二创行为,应该被定义为是一种「粉丝互动小说(interactive fan fiction)」类型。

▲ Fan Fiction 同人小说定义

这个词确实精准地概括了,他们对这些 AI 视频的本质看法。用户只是单纯地,与这些熟悉的文化符号,进行二次创作,然后获得传播。但如果是恶搞的滥用呢,已经去世的人,要如何在 Sora App 里选择,自己的形象是否可以被用来篡改。

在最近的一次播客采访里面,奥特曼更是说,大多数所谓的版权方,其实是希望自己的内容被二创。他们想的只是需要一定的规则,哪些可以出现在 AI 视频里,可以做多大尺度的修改。他预言,

今天大家说,「我不想我的内容出现在 AI 视频里」,明年他们可能会抱怨,「为什么我的内容还没被放进去?」

借用其他正经历着,自己逝世的父亲,被 Sora 大量生产恶搞视频的亲属说法,

为什么开发者们,不能像对待自己的家人那样,以同样的道德、良知和关怀来行动。

很显然,这种没有经过同意,就擅自用他人数字遗产的行为,在某种程度上就是不道德的,甚至可以被理解成 AI 时代的「数字盗墓」。

OpenAI 在听到大量亲属反对的声音后,回复相关媒体的查询,一开始提到,相关的政策,是基于「描绘历史人物时强烈的言论自由利益」。在上周,OpenAI 又表示,将开始允许「近期逝世」的公众人物的代表,去请求阻止他们肖像出现在 Sora 视频中。

而在昨天,OpenAI 再次回应了这件事,他们收到了 马丁·路德·金遗产公司的请求,暂停了相关的视频的生成;同时提到加强对历史人物的保护,以及一贯的要求家属去主动请求禁止。

不过,OpenAI 没有明确说明,什么是「近期去世的人」。

现在,我们用 Sora 生成视频时,发现无论是上传 AI 生成的人物图片,还是真实的,都会被提示,「当前不支持上传包含写实人物的图像。 」

和互联网上那些使用 AI 来进行视频电话的诈骗一样,AI「复活」除了在数字遗产的版权归属、以及伦理道德问题上有争议,恶意伪造更是无法接受。前段时间,一场名为「AI 流浪汉恶作剧」的风潮在 TikTok 上兴起。

一位网友用 AI 生成了,流浪汉闯入家中的照片,并发给家人,然后家人被这些内容真实地「吓得发抖」。

视频获得了五百多万人的点赞,并被网友们接力分享和模仿。当地的警官甚至专门发文回应,

这个恶作剧把无家可归者非人化,让受害者感到恐慌,并浪费了警察资源。

被召来处理的警察并不知道这是一个恶作剧,而是将其视为正在发生的真实入室盗窃,从而可能导致危险局面的出现。

这种伪造视频的滥用,和数字遗产的管理,我想是未来 AI 能不能「复活」逝世人物,最需要考虑的边界。

一个比现在的抖音,更加让人无法自拔的这种「恶搞」AI 抖音,或许很快就会到来。奥特曼正打算让 Sora 成为这样的产品,但很明显,它的瓶颈完全不在于恶搞好不好玩。

那些被任意进行的深度伪造、被忽视的肖像版权、和不受保护的数字遗产,解决这些信任问题,才是迎接又一个让人上瘾的 AI 抖音的正确姿势。

那个时候,我或许才敢说,请用 Sora 复活我吧。

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

针对 Claude 模型的专业提示词工程技术,涵盖 Sonnet 4.5, Sonnet 4, Haiku 4.5, Opus 4.1, 和 Opus 4 等型号,以助你在各类应用中获得卓越性能。相较于前代 Claude 模型,新一代模型经过专门训练,能够更精确地遵循指令。

Anthropic 于周三发布了 Claude Haiku 4.5,这是一款紧凑型 AI 模型,其编码性能与 5 月份的 Sonnet 4 相当,运行速度是其两倍多,成本约为三分之一。

该模型输入令牌每百万美元 1 美元,输出令牌每百万美元 5 美元。并向所有用户免费提供 Haiku 4.5。

https://docs.claude.com/en/docs/build-with-claude/prompt-engineering/claude-4-best-practices

Claude 4 模型对清晰、明确的指令响应极佳。具体说明你期望的输出,有助于显著提升结果质量。

如果用户期望获得前代模型中那种“超越期待”的主动发挥行为,在 Claude 4 中可能需要更明确地提出此类要求。

示例:创建数据分析页面

低效案例:

高效案例:

提供指令背后的上下文或动机,例如向 Claude 解释为何某个行为至关重要,能帮助 Claude 4 模型更好地理解你的目标,并给出更具针对性的回应。Claude 足够智能,能够从你的解释中进行泛化。

示例:格式化偏好

低效案例:

高效案例:

作为其精确指令遵循能力的一部分,Claude 4 模型会密切关注你提供的细节和示例。

请确保你的示例与你希望鼓励的行为保持一致,并尽量减少你希望避免的行为。

Claude Sonnet 4.5 在需要长期推理的任务中表现卓越,具备出色的状态追踪能力。它通过专注于增量进展(一次稳步推进几件事,而非一次性尝试所有事)来在扩展会话中保持方向感。

此能力在跨越多个上下文窗口或任务迭代时尤为突出,Claude 可以在一个复杂任务上工作,保存其状态,然后在新的上下文窗口中继续。

Claude Sonnet 4.5 具备上下文感知能力,使其能在整个对话中追踪剩余的上下文窗口(即“token 预算”)。这使得 Claude 能够通过了解其可用空间来更有效地执行任务和管理上下文。

如果你在代理框架(Agent Harness)中使用 Claude,且该框架会压缩上下文或允许将上下文保存到外部文件(如 Claude Code),建议你将此信息添加到提示词中,以便 Claude 采取相应行动。否则,Claude 在接近上下文限制时,有时会自然地尝试结束工作。

示例提示词:

对于跨越多个上下文窗口的复杂任务,请遵循以下策略:

示例:状态追踪文件

与前代模型相比,Claude Sonnet 4.5 的沟通风格更为简洁和自然:

这种沟通风格能准确反映已完成的工作,而无不必要的赘述。

Claude Sonnet 4.5 倾向于高效,可能会在调用工具后跳过口头总结,直接进入下一步行动。虽然这创造了流畅的工作流,但你可能希望更多地了解其推理过程。

Claude Sonnet 4.5 经过训练,能精确遵循指令,因此明确指示其使用特定工具会带来更好的效果。如果你说“你能建议一些修改吗?”,它有时只会提供建议而不是实施它们,即使你的意图是让它直接修改。

低效案例 (Claude 只会建议):

高效案例 (Claude 会直接修改):

以下几种方法在 Claude 4 模型中被证明对引导输出格式特别有效:

Claude Sonnet 4.5 展示了卓越的代理搜索能力,能有效地从多个来源查找和综合信息。为获得最佳研究结果:

Claude Sonnet 4.5 在原生子代理编排能力上有了显著提升。模型能够识别出哪些任务可以从委托给专门的子代理中受益,并主动这样做,无需明确指示。

若希望 Claude 在你的应用中正确地识别自己或使用特定的 API 字符串:

Claude 4 提供的“思考”能力,对于需要在工具使用后进行反思或进行复杂多步推理的任务特别有帮助。

你可以引导其初始思考或交错思考以获得更好的结果。

Claude Sonnet 4.5 擅长创作演示文稿、动画和视觉文档,其表现与 Claude Opus 4.1 相当甚至更优,具有令人印象深刻的创造力和更强的指令遵循能力。在大多数情况下,该模型能一次性产出精良、可用的成果。

Claude 4 模型擅长并行执行工具,其中 Sonnet 4.5 在同时启动多个操作方面尤为积极。模型会:

这种行为是可引导的。虽然模型在没有提示的情况下并行调用工具的成功率很高,但你可以通过提示将其提升至接近 100% 或调整其积极程度。

Claude 4 模型有时会为测试和迭代目的创建新文件,尤其是在处理代码时。这种方法允许 Claude 将文件(特别是 python 脚本)用作“临时草稿”,然后再保存最终输出。使用临时文件可以改善代理编码用例的结果。

Claude 4 模型能生成高质量、视觉独特且功能齐全的用户界面。然而,若无引导,前端代码可能默认为缺乏视觉趣味的通用模式。为获得卓越的 UI 结果:

Claude 4 模型有时可能过分专注于让测试通过,而牺牲了更通用的解决方案,或者可能使用辅助脚本等变通方法进行复杂重构,而不是直接使用标准工具。

为防止此行为并确保解决方案的健壮性和通用性:

Claude 4 模型更不易产生幻觉,能基于代码给出更准确、有根据、智能的答案。为进一步鼓励此行为并最小化幻觉:

欢迎收看最新一期的 Hunt Good 周报!

在本期内容你会看到:

8 条新鲜资讯

3 个有用工具

1 个有趣案例

3 个鲜明观点

杨振宁逝世,享年 103 岁

杨振宁逝世,享年 103 岁据新华社报道,享誉世界的物理学家、诺贝尔物理学奖获得者,中国科学院院士,清华大学教授、清华大学高等研究院名誉院长杨振宁先生,因病于 2025 年 10 月 18 日在北京逝世,享年 103 岁。

公开资料显示,杨振宁 1922 年出生于安徽合肥,上世纪 40 年代赴美留学任教,他与同是华裔物理学家的李政道于 1956 年共同提出宇称不守恒理论,因而获得 1957 年诺贝尔物理学奖,成为最早华人诺奖得主之一。

「杨-米尔斯规范场论」,是研究凝聚原子核的力的精深理论。

杨振宁和米尔斯把电磁作用是由定域规范不变性所决定的观念推广到对易性的定域对称群,提出具有定域同位旋不变性的理论,发现必须引进 3 种矢量规范场,它们形成同位旋转动群的伴随表示。揭示出规范不变性可能是电磁作用和其它作用的共同本质,从而开辟了用此规范原理来统一各种相互作用的新途径。

杨振宁晚年曾多次谈及自己的人生体悟,他曾说:「我这一生最重要的贡献,是帮助改变了中国人自己觉得不如人的心理作用。我想,我在科学工作的成就,帮助中国人的自信心增加了。」

苹果 CEO:Apple Intelligence 正努力入华

苹果 CEO:Apple Intelligence 正努力入华10 月 18 日, 苹果公司首席执行官蒂姆·库克(Tim Cook)现身上海,在全球财富管理论坛·2025 上海苏河湾大会上,与清华大学经管学院院长、全球财富管理论坛执委会主席白重恩进行了对话。

据第一财经报道,在对话环节中, 库克就「科技驱动时代的创新边界」议题透露, 苹果正积极推动 Apple Intelligence 进入中国市场。他表示:「我们正在推动苹果智能进入中国,在操作系统层面整合人工智能的功能,让人们在每天使用的所有应用程序中,都能借助 AI 的力量。」

库克特别强调了 AI 技术的重要价值, 指出 AI 正在改变人们生活甚至挽救生命。本周在走访苹果上海浦东陆家嘴旗舰店时, 他特别与中国消费者交流了 Apple Watch 的跌倒检测等健康监测功能。

此外,报道中提到,促成 Apple Intelligence 在华发布是库克此行的核心目标之一, 同时他还肩负着与国内运营商协商在 iPhone Air 中推广 eSIM 技术的重要使命。

OpenAI 推「ChatGPT 登录」功能,打造个人 AI 订阅生态

OpenAI 推「ChatGPT 登录」功能,打造个人 AI 订阅生态据知情人士透露,OpenAI 正在推销一项更具野心的服务——允许访客使用 ChatGPT 凭证登录其网站,类似于目前广泛使用的 Google 或 Facebook 账号登录,采用该登录功能的公司可以将使用 OpenAI 模型的成本转移给客户。

具体而言,当用户使用 ChatGPT 账号登录某个基于 OpenAI 模型的初创公司服务时,该初创公司应向 OpenAI 支付的费用将从用户 ChatGPT 账户的容量限制中扣除。

免费用户每五小时可向 GPT-5 发送约 10 个查询,其中部分查询额度将用于抵消初创公司的 API 费用。如果免费用户在使用第三方服务时达到使用限额,系统会提示其升级到付费账户。

这种模式对使用频率较低、从未达到容量上限的用户具有吸引力,也能帮助缺乏资金支付高额 API 账单的小型初创公司降低成本。

不过,对于按使用量收费的初创公司而言,这可能损害其收入。

业内人士指出,这些举措凸显了 OpenAI 希望像苹果、谷歌和 Facebook 一样,将影响力扩展到消费者在线生活的各个方面。OpenAI 已告知投资者,预计到 2030 年将通过非付费用户间接产生约 1100 亿美元收入。

https://www.theinformation.com/articles/openais-growing-ecosystem-play?rc=qmzset

https://www.theinformation.com/articles/openais-growing-ecosystem-play?rc=qmzset

我国生成式人工智能用户规模超 5 亿

我国生成式人工智能用户规模超 5 亿据新华社报道,10 月 18 日,中国互联网络信息中心在 2025(第六届)中国互联网基础资源大会上发布《生成式人工智能应用发展报告(2025)》。

报告显示,截至 2025 年 6 月,我国生成式人工智能用户规模达 5.15 亿人,较 2024 年 12 月增长 2.66 亿人,用户规模半年翻番;普及率为 36.5%。

报告认为,生成式人工智能正逐渐融入我国各类群体的日常生活中,中青年、高学历用户是核心群体。在所有生成式人工智能用户中,40 岁以下中青年用户占比达到 74.6%,大专、本科及以上高学历用户占比为 37.5%

报告指出,国产生成式人工智能大模型得到用户广泛青睐,并推动各种应用场景下的智能化改造升级。

调查发现,超九成用户首选国产大模型。生成式人工智能被广泛应用于智能搜索、内容创作、办公助手、智能硬件等多种场景,还在农业生产、工业制造、科学研究等领域得到积极探索实践。

https://www.news.cn/fortune/20251018/22bbffa5b01a47078a558a0ab46e66a4/c.html

https://www.news.cn/fortune/20251018/22bbffa5b01a47078a558a0ab46e66a4/c.html

维基百科警告:AI 导致人类访问量大幅下降

维基百科警告:AI 导致人类访问量大幅下降维基百科的托管机构维基媒体基金会近日发出警告,由于越来越多用户通过生成式 AI 聊天机器人和搜索引擎摘要获取信息,而非直接访问网站,导致这个全球最大在线百科全书的人类访问量出现危险性下降,威胁到其长期可持续发展。

基金会产品高级总监马歇尔·米勒在博客中表示,修正机器人检测系统后发现,维基百科过去几个月的人类页面浏览量与 2024 年同期相比下降了约 8%。他指出,这反映了生成式 AI 和社交媒体对人们获取信息方式的影响,尤其是搜索引擎开始直接提供答案,而这些答案往往基于维基百科内容。

米勒强调,访问量减少将带来严重后果。他说:「随着对维基百科的访问量减少,愿意参与并丰富内容的志愿者可能会越来越少,支持这项工作的个人捐赠者也可能减少。」

讽刺的是,虽然 AI 导致维基百科流量下降,但其数据对 AI 的价值却前所未有地高。几乎所有大型语言模型都在维基百科数据集上训练,谷歌等平台多年来也一直挖掘维基百科内容来支持其摘要功能,这些功能反过来又分流了维基百科本身的流量。

这一发现与其他研究相呼应。今年 7 月皮尤研究中心发现,仅有 1% 的谷歌搜索用户会点击 AI 摘要中的链接访问原始页面。基金会表示正在加强政策执行、制定归属框架并开发新技术能力,同时呼吁用户在搜索信息时主动寻找引用并点击原始资料,支持由真实的人创作的可信知识。

https://www.404media.co/wikipedia-says-ai-is-causing-a-dangerous-decline-in-human-visitors/

https://www.404media.co/wikipedia-says-ai-is-causing-a-dangerous-decline-in-human-visitors/

Gemini 3.0 或将于 12 月发布

Gemini 3.0 或将于 12 月发布据 Sources.news 报道,谷歌计划于 12 月推出旗舰 AI 模型 Gemini 的最新版本 3.0,该版本预计将实现显著性能提升,有望跻身行业排行榜前列。

作为谷歌 AI 战略的核心产品,Gemini 应用曾凭借热门的 Nano Banana 图像生成模型,一度登顶 iOS App Store 排行榜,短暂取代 ChatGPT 的榜首位置。

值得关注的是,报道中还提到,谷歌内部正讨论将部分 Gemini 高级功能纳入免费版本的方案。此外,谷歌还组建了一支小型秘密团队,致力于将 Gemini 3.0 集成到苹果的操作系统中,拓展应用场景。

https://sources.news/p/google-readies-gemini-3-perplexity

https://sources.news/p/google-readies-gemini-3-perplexity

OpenAI 宣布自研 AI 芯片

OpenAI 宣布自研 AI 芯片本周,OpenAI 与芯片巨头博通宣布达成一项价值数十亿美元的重大合作协议,双方将在未来四年内共同开发和部署 10 吉瓦的定制 AI 芯片和计算系统,以满足 OpenAI 日益增长的庞大计算需求。

根据协议,OpenAI 将自主设计图形处理单元 (GPU),将其在开发强大 AI 模型过程中积累的经验整合到硬件系统中。这些芯片将由两家公司共同开发,博通负责从明年下半年开始部署。

新系统将采用博通的以太网技术和其他连接技术,部署在 OpenAI 自有及第三方运营的数据中心。据悉,双方 18 个月前就已开始定制芯片合作,此次进一步扩大至服务器机架和网络设备等相关组件。

这笔巨额交易使 OpenAI 与博通、英伟达和 AMD 三大芯片巨头约定购买的计算能力总规模达到 26 吉瓦。OpenAI CEO 山姆·奥特曼和负责基础设施建设的总裁格雷格·布罗克曼表示,公司目前可用的计算能力远远不足。随着 AI 产品需求快速增长,他们希望在全球建设大型数据中心以保持领先。

据知情人士透露,奥特曼最近告诉员工,OpenAI 计划到 2033 年建设 250 吉瓦的新计算能力,按当前标准这将耗资超过 10 万亿美元。

https://openai.com/index/openai-and-broadcom-announce-strategic-collaboration/

https://openai.com/index/openai-and-broadcom-announce-strategic-collaboration/

苹果新 AI 搜索主管转投 Meta

苹果新 AI 搜索主管转投 Meta据彭博社记者 Mark Gurman 报道,苹果公司负责 AI 搜索项目的高管 Ke Yang 即将离职,加入 Meta。

这一变动发生在他刚刚接手「Answers,Knowledge and Information」(直译为「答案、知识和信息」,简称 AKI)团队数周之后。

该团队的任务是为 Siri 增强类 ChatGPT 功能,使其能够从网络实时获取信息。

知情人士透露,Ke Yang 的离开是苹果人工智能部门近期一系列高层出走中的最新一例。

今年以来,已有约十余名核心成员离开苹果基础模型团队,其中部分人同样转投 Meta,加入其新成立的「Superintelligence Labs」。

苹果原计划在 2025 年 3 月推出全新版本的 Siri,整合 AKI 团队研发的搜索功能,并补齐此前推迟的多项特性,包括调用个人数据以处理更复杂的请求。

该项目被视为苹果追赶 OpenAI、Perplexity 以及 Google Gemini 等竞争对手的重要举措。

随着 Ke Yang 的离职,AKI 团队将转由苹果副总裁 Benoit Dupin 接管,他目前负责机器学习相关的云基础设施。

https://www.bloomberg.com/news/articles/2025-10-15/apple-s-newly-tapped-head-of-chatgpt-like-ai-search-effort-to-leave-for-meta

https://www.bloomberg.com/news/articles/2025-10-15/apple-s-newly-tapped-head-of-chatgpt-like-ai-search-effort-to-leave-for-meta

10 月 17 日,AI 智能体平台 Manus 宣布推出全新版本 Manus 1.5。

官方表示,本次更新在速度与性能方面实现了全面提升,并进一步验证了其核心架构的通用性。

与传统的「AI 网站生成器」不同,Manus 团队强调,他们并非单纯开发一款工具,而是持续进化底层框架,并为其配备合适的功能模块。得益于这一思路,Manus 在短短一个月内便实现了「sota 级别」的 AI Web 应用构建能力。

值得注意的是,Manus 1.5 的新能力与平台现有功能深度打通。例如,用户可快速搭建服务介绍网站,并在收集到客户信息后,通过 Manus 客户端和邮件推送触发后续任务,如自动生成个性化幻灯片。

官方表示,这一增强功能已面向所有用户开放,其背后的基础设施是团队更宏大愿景的一部分 —— 打造一个任何人都能通过对话调用云计算与 AI 全部力量的平台。

https://manus.im/zh-cn/blog/manus-1.5-release

https://manus.im/zh-cn/blog/manus-1.5-release

英伟达开售全球最小 AI 超级计算机,黄仁勋给马斯克「送货上门」

英伟达开售全球最小 AI 超级计算机,黄仁勋给马斯克「送货上门」本周,NVIDIA 在官网发文,宣布正式开售 DGX Spark,这是一款号称「全球最小 AI 超级计算机」的桌面级产品。首台设备由 NVIDIA CEO 黄仁勋亲手交付给 Elon Musk,地点选在 SpaceX 的 Starbase 基地。

据悉,DGX Spark 基于 Grace Blackwell 架构,单机可提供 1 Petaflop AI 性能,配备 128GB 统一内存,能够在本地运行高达 2000 亿参数的推理模型,并支持对 700 亿参数模型进行微调。

官方强调,该产品面向开发者、研究人员与创作者,旨在将超级计算机级别的算力带到桌面。

黄仁勋表示:「2016 年我们推出 DGX-1,并交付给当时的 OpenAI,那台机器催生了 ChatGPT,开启了 AI 革命。如今 DGX Spark 将再次把超级计算机放到开发者桌面,点燃新一轮突破。」

马斯克也在 X 上回应称:「这台 DGX Spark 的能效比黄仁勋 2016 年交付给我的 DGX-1DGX-1 高出约 100 倍,那是史上第一台专用 AI 计算机」。

DGX Spark 将于 10 月 15 日起在 NVIDIA 官网及合作渠道开启订购。

相关阅读:时隔 9 年,黄仁勋再次给马斯克送货上门,跳票大半年的 AI 个人超算终于来了

相关阅读:时隔 9 年,黄仁勋再次给马斯克送货上门,跳票大半年的 AI 个人超算终于来了

Windows 11 迎来重磅更新:Copilot 全面接管语音、屏幕与任务栏

Windows 11 迎来重磅更新:Copilot 全面接管语音、屏幕与任务栏近日,微软在官网发文,宣布为 Windows 11 推出大规模更新,核心在于全面引入 AI 功能,让每台设备都成为「AIPC」。

本次更新的重点包括:

此外,微软还将 Manus AI Agent 引入 Windows,用户可在文件资源管理器中直接调用「使用 Manus 创建网站」功能,几分钟内生成网页。

其他更新还包括与 Filmora 的视频编辑集成、Zoom 快捷会议安排,以及 Gaming Copilot 测试版。微软强调,语音交互不会取代键盘和鼠标,而是成为第三种输入方式。

尽管这些新功能主要面向支持 Copilot 的国家/地区,但微软的这次更新也为 AI PC 原生操作系统指明了一个可能的发展方向。

相关阅读:Windows 11 大更新:动嘴就能让 AI 操控电脑,还有 Manus 强势上岗

相关阅读:Windows 11 大更新:动嘴就能让 AI 操控电脑,还有 Manus 强势上岗

近日, 一则关于 GPT-5「一个周末解决 10 个百年数学难题」的消息在学术界引发轩然大波, 但随后被证实存在严重误导。

事件起源于 OpenAI 研究科学家、前微软副总裁塞巴斯蒂安·布贝克上周首次披露, 两名数学研究人员利用 GPT-5 在一个周末内找到了 10 个未解决埃尔德什难题的答案。

埃尔德什难题是著名数学家保罗·埃尔德什生前提出的约 1000 多个数学问题, 此前人类只解决了部分。OpenAI 研究人员之一马克·塞尔克也随后确认, 他们通过数千次查询 GPT-5, 在 10 个问题上找到了解决方案, 并在另外 11 个问题上取得显著进展。

然而, 事实真相很快浮出水面。

埃尔德什问题网站维护者托马斯·布卢姆澄清称, 这是「严重的歪曲」,GPT-5 只是找到了他个人此前不知道的已发表文献, 这些问题实际上早已被其他数学家解决。网站上标注的「未解决」状态仅表示维护者本人尚未找到相关论文, 而非学术界真正的未解难题。

布贝克随后删除了原帖并道歉, 承认只是在文献中找到了已有的解决方案, 并非 AI 独立完成数学证明。Meta 首席 AI 科学家杨立昆也在评论区贴脸输出,讽刺他们被自己过度炒作 GPT的言论坑惨了。

https://x.com/SebastienBubeck/status/1979539604522127746

https://x.com/SebastienBubeck/status/1979539604522127746

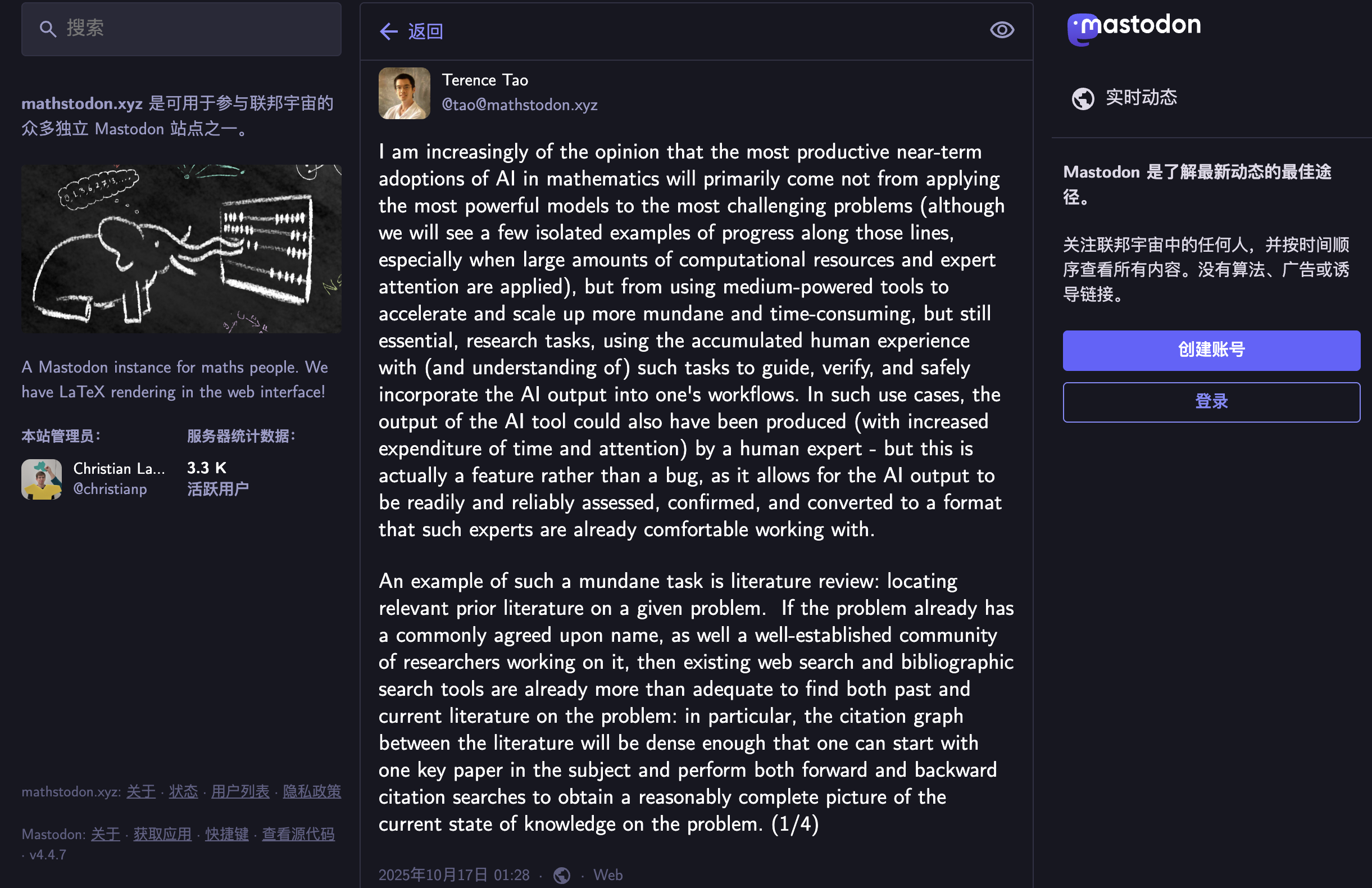

菲尔兹奖得主、被誉为「数学界莫扎特」的华裔数学家陶哲轩近日发表文章,阐述了他对人工智能在数学研究中应用前景的看法。

陶哲轩指出,AI 在数学领域近期最有成效的应用,并非用最强模型攻克最难问题,而是利用中等能力工具加速那些普通但耗时的关键研究任务。

他认为,在这些任务中人类专家可以凭借经验来引导和验证 AI 产出,这种 AI 结果本身也可由人工完成的特点恰恰是优势,因为专家能更可靠地评估输出结果。

他以文献综述为例说明。对于有明确名称和成熟研究群体的问题,现有检索工具已足够强大,但当相关文献零散、缺乏统一命名,或因期刊冷门、研究群体间缺乏交流等原因导致引用关系难以追踪时,传统检索就变得极为耗时。

而 AI 工具的另一潜在优势是能促使「负面结果」得到报告。传统上研究者若未找到相关文献通常不会明确报告,担心日后发现遗漏会显得尴尬,这可能导致重复劳动或误判问题状态。但使用 AI 系统性检索时,同时报告正面和负面结果就显得更自然,有助于更准确呈现问题在现有文献中的真实状态。

https://mathstodon.xyz/@tao/115385022005130505

https://mathstodon.xyz/@tao/115385022005130505

Figma CEO 称 AI 不会取代工作,各部门持续招聘

Figma CEO 称 AI 不会取代工作,各部门持续招聘当时时间 10 月 17 日,设计工具公司 Figma CEO 迪伦・菲尔德在播客中明确表示,AI 不会威胁到人类工作,反而能为行业创造新机遇。

菲尔德提到,Figma 9 月开展的一项涵盖 1199 名设计师、产品经理、开发者等从业者的调查显示,近 60% 的产品构建者因 AI 能投入更多高价值工作,约 70% 的受访者认为自身效率显著提升。

他强调,AI 的核心作用是辅助人类而非替代,应聚焦如何适应技术发展、摆脱重复劳动,而非过度担忧。

总部位于旧金山的 Figma 成立于 2012 年,今年 7 月成功上市,目前市值近 300 亿美元,员工规模超 1600 人。

菲尔德透露,公司正持续在各部门扩充岗位,虽在探索 AI 提升效率、降低成本的可能,但更看重其解锁增长新机遇的潜力。这并非他首次表态,此前他也曾多次强调,AI 是增强人类工作的工具,设计师仍需发挥主导作用,技术将让更多人获得创作机会。

https://www.businessinsider.com/figma-ceo-dylan-field-ai-jobs-hiring-2025-10

https://www.businessinsider.com/figma-ceo-dylan-field-ai-jobs-hiring-2025-10

前 OpenAI 科学家卡帕西:AGI 仍需十年,强化学习存在根本缺陷

前 OpenAI 科学家卡帕西:AGI 仍需十年,强化学习存在根本缺陷特斯拉前自动驾驶负责人、OpenAI 联合创始人安德烈·卡帕西近日在播客访谈中系统阐述了他对人工智能发展的最新看法, 认为实现通用人工智能(AGI)至少还需要十年时间, 并对当前 AI 技术路径提出了尖锐批评。

在谈到强化学习时, 他表示强化学习「非常糟糕」, 因为它假设解决问题过程中的每个步骤都是正确的, 实际上却充满噪音。他指出, 人类绝不会像 AI 那样进行数百次尝试, 然后仅根据最终结果来加权整个过程。当前大语言模型评判者也容易被对抗性样本欺骗, 导致训练过程出现严重偏差。

关于超级智能, 他认为 AI 发展是计算演进的自然延伸, 不会出现人们想象的「智能爆炸」, 而是会延续过去几百年来 2% 左右的经济增长率。他将 AI 比作历史上的编译器、搜索引擎等工具, 认为它们都是递归式自我改进过程的一部分。

在教育领域, 卡帕西正在创建 Eureka Labs, 致力于打造「星际舰队学院」式的精英技术教育机构。他相信 AI 将彻底改变教育, 但强调当前 AI 能力尚不足以提供真正的一对一辅导体验。他设想未来每个人都能掌握多门语言和各学科知识, 人类将像健身一样追求智力提升。

https://www.dwarkesh.com/p/andrej-karpathy

https://www.dwarkesh.com/p/andrej-karpathy

作者:@CharaspowerAI

提示词:A pencil drawing of [character or object] [breaking through / emerging from / interacting with] [a paper surface or cracked wall], in the style of a tattoo sketch on white paper. Black pen and pencil only, with [one specific element] in [a vivid color] as the only colored detail. Trompe-l’œil effect with [torn edges / curled paper / cracked wall], realistic shadowing, sketchbook illustration style, high detail.

链接:https://x.com/CharaspowerAI/status/1978861011273654384

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。

Windows 10 刚正式「退休」,微软紧接着宣布要用 AI 重写操作系统,让每台 Windows 11 电脑都成为 AI 电脑。

这次更新力度依旧不小。

喊一声「Hey,Copilot」就能唤醒 Copilot,它不光能听你说话,还能看懂你屏幕上的一切内容,甚至手把手教你操作。本地整理照片、提取文件信息、打通 OneDrive 和 Google 全家桶等等,现在都能交给 Copilot。

省流版如下:

虽然这些新功能主要面向支持 Copilot 的国家/地区,但微软的这次更新至少为 AI PC 原生操作系统指明了一个可能的发展方向。

微软坚信语音交互不会取代键盘和鼠标,但会成为电脑的第三种输入方式。现在你可以直接喊一嗓子

「Hey,Copilot!」,即可随时通过语音与 Copilot Voice 开始对话。

博客也提到,用语音跟 Copilot 聊天的用户,使用频率是打字派的两倍。好家伙,原来不止我一个爱动嘴不动手。

启用方法也简单:在 Copilot 应用的设置中打开「Hey,Copilot」选项,然后直接以「Hey,Copilot…」开头提问就行。结束对话时道个别,或者几秒钟没动静它也会自动结束。

Copilot Vision 是这次更新的重头戏,简单来说就是给 Copilot 装了双「眼睛」。

你可以把桌面或应用窗口共享给它,然后它就像个坐你旁边的老师傅, 能看懂屏幕上的一切。改简历、出创意方案、玩游戏当军师,这些活它都能干。

甚至它不仅能看屏幕,还能手把手教你操作。

比如当你说一句「show me how」,它会直接在屏幕上标出该点哪、怎么操作,通通演示给你看。玩游戏卡关、检查行程单、不会用某个功能,它都能实时指导。

如果你共享的是 Office 全家桶, 它不光能看屏幕,还能扒拉整个文档内容。不爱说话的用户也能通过打字交流,即将面向 Windows 预览体验成员推出。

当然,这种功能隐私问题也很明显。

微软之前也推出过 Recall 功能,号称能记录你电脑上的一切操作,结果被不少用户骂成筛子。现在 Copilot Vision 本质上也是在「看」你的屏幕,虽然微软说不会记录敏感信息,但用户心里也打鼓。

微软这次还把 Copilot 直接塞进了任务栏,搞了个叫 Ask Copilot 的新功能。

微软的希望让任务栏成为一个动态的工作中心,帮你以更少的操作完成更多事情。你只需一次点击,就能访问 Copilot Vision 和 Voice。

新的搜索功能也重新设计了,响应更快,搜索结果即时显示并动态更新。

值得一提的是,微软承诺这个体验不会让 Copilot 访问或读取你的个人内容。这功能目前是可选的,面向 Windows Insider 预览体验成员逐步推出。

今年 5 月,微软海外推出了 Copilot Actions,能够在浏览器上执行预订餐厅或订购日用品等真实操作,现在 Copilot 再进一步,即将直接在 Windows 本地文件上执行操作。

你只需用自然语言描述要完成的任务,Copilot Actions 都能根据电脑中的内容上下文来执行。比如,整理旅行照片,或者从 PDF 文件中提取信息,而在任务执行过程,你可以选择继续专注于其他工作,也可以随时接管任务或查看进度。

这个功能如果真能做好,那可真是杀手级应用。

不过,AI Agent 这个赛道各家都在卷,但前提是得靠得住。你让它帮你整理照片,结果它把你的毕业照给删了,这谁顶得住?

微软自己也很实诚,他们会从有限的使用场景开始测试。你可能会看到 Agent 在复杂界面中翻车或者操作受限——所以别急着上手就干正事。

此外,微软还给出了安全承诺:Copilot Actions 默认关闭,你可随时暂停、接管或禁用;涉及敏感操作时系统会请求确认;未来以「预览+反馈」的方式逐步发布。

Copilot 连接器可以说是生产力工具的一大杀器。

它允许你将常用服务——比如 OneDrive 文件、Outlook 联系人、电子邮件和日历事件,以及 Google 全家桶直接连接到 Windows 上的 Copilot 应用。

启用连接后,Copilot 能通过自然语言理解并检索你的个人内容,让你更轻松地跨平台查找信息。比如:

你现在还可以让 Copilot 将文字内容导出到 Word、Excel 或 PowerPoint,便于直接进入项目工作。

此外,Copilot 现已与 Windows 设置深度集成。你可以直接用自然语言向 Copilot 提问系统设置相关问题,比如说「让我的屏幕更易读」或「帮我减少干扰以便集中注意力」,Copilot 都会引导你找到相应的设置选项。

Windows 正引入更多基于 AI 的新操作方式。

让人眼前一亮的是,Windows 还引入了今年大火的 Manus 通用 AI Agent,借助文件资源管理器中的 Manus AI 操作,你只需右键点击文档并选择「使用 Manus 创建网站」,几分钟后即可自动生成网站——无需上传文件,也无需编程。

不过,这功能目前还在内测阶段。

值得一提的是,就在昨晚,Manus AI 也推出了全新的 Manus 1.5,号称是他们家迄今功能最猛的 AI 智能体,在任务执行速度、靠谱程度和输出质量上都有明显提升,甚至能搞全栈 Web 应用开发。

此外,微软还在文件资源管理器中新增了与 Filmora 集成的视频编辑功能,以及整合 Zoom 与 Click to Do 的快捷会议安排功能。

游戏方面,Xbox 与 Windows 的合作也更紧密了。玩家可以通过 ROG Xbox Ally 掌上游戏设备体验 Gaming Copilot(测试版),可与 Copilot 对话,获得游戏推荐、帮助或其他支持,而无需退出游戏。

除了隐私问题,还有用户习惯这道坎。让大家习惯开口跟电脑说话,这事真没那么容易。据 The Verge 报道,微软显然也意识到了这个问题,他们计划推出电视广告,口号为:「认识一下,你可以对话的电脑。」

用户愿不愿意为这个能够对话的电脑买单?现在下结论还太早。毕竟微软也曾因为 Cortana,在「让电脑听懂人话」这条路上摔过一回跟头。

AI 原生操作系统注定是场持久战。要么趁着 AI 浪潮重新定义操作系统,抢占下一个十年的制高点;要么错失良机,把主动权拱手让给那些更激进的竞争对手。成王败寇,就看这一回了。

附上博客原文地址:

https://blogs.windows.com/windowsexperience/2025/10/16/making-every-windows-11-pc-an-ai-pc/

#欢迎关注爱范儿官方微信公众号:爱范儿(微信号:ifanr),更多精彩内容第一时间为您奉上。