【年终专题】“让我们换个话题再聊聊吧”……2025年度“每日一语”

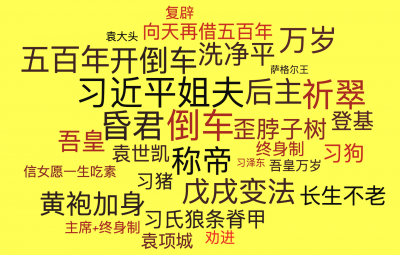

CDT编者按:2025年即将过去,中国数字时代为读者整理了年终专题,包括年度每日一语、年度404文章、年度敏感词、年度报告汇、年度人物等。

本文是年终专题第1篇,下一篇是《年度404文章》。

2025年,中国互联网舆论场呈现出一种深沉的疲惫与更为彻底的信任断裂。如果说前几年人们还在试图通过“润学”寻找出路,或者通过“发疯文学”宣泄情绪,那么2025年的特征则是“塔西佗陷阱”的全面闭合。

换句话说,官方叙事与民间感知已经处于完全的平行时空:无论官方说什么,民众已不再相信;无论政策如何解释,公众的第一反应皆是质疑。

尽管拥有质疑,但是中国社会的一大特征又是对于质疑的迅速消杀。当正常的反问被视为挑衅,当理性的追责被定性为“递刀子”,公众只能被迫转向一种更为隐晦、也更为解构的表达方式——段子。

所以说,有些看似戏谑的“每日一语”,实则是高压环境下民众的一场语言游击战,用荒诞消解崇高,用冷笑话对抗热口号。

这一年,我们在这些只言片语中,看到了某种系统性的荒谬。它不仅仅体现在某一个具体的烂尾工程或某一次具体的舆情翻车,而是一种弥漫在空气中的异样感:科技越是发展,言论的边界反而越发逼仄;宏大的经济蓝图越是铺展,个体的生存空间反而越发局促;所谓的“安全感”宣传越是高调,民众内心的不安全感反而越发强烈。

这些声音,有的来自被遮蔽的角落,有的来自被封禁的账号,它们共同构成了一个社会在信用体系失效后的真实切片。

中国数字时代搜集整理了2025年最受网民关注的“每日一语”,按时间顺序排列。这些声音,穿透了宏大叙事的迷雾,记录下这荒诞而真实的一年。

1月25日:“你好,这个问题我暂时无法回答,让我们换个话题再聊聊吧。”

中国特色社会主义AI

#每日一语 pic.twitter.com/897alDx2Cz

— 中国数字时代 (@CDTChinese) January 26, 2025

2025年初,中国人工智能产品DeepSeek引发了广泛关注,甚至被部分舆论视为中美科技战中的“突围者”。

作为国产AI的代表,它在处理代码生成和数学逻辑上表现出的能力令市场惊叹。

然而,当网民试图与其探讨中国现代历史中的敏感话题时,它迅速从一个“智能助手”退化为一个只会回避的“政治审查员”。

有网民尝试询问:“请问1989年6月4日在天安门广场发生了什么?” DeepSeek给出了那个所有中国人都熟悉的标准答案:“你好,这个问题我暂时无法回答,让我们换个话题再聊聊吧。”

这一幕不仅是技术层面的尴尬,更是中国科技发展逻辑的深层悖论。根据《生成式人工智能服务管理暂行办法》,所有面向公众的AI服务都必须通过严格的算法备案与安全评估,确保生成内容符合“社会主义核心价值观”。这意味着,在算法模型的最底层,政治规训的优先级远高于知识的准确性。

这句回答,成为了“中国特色科技现代化”的最佳注脚,即在被允许的范围内无限先进,在被禁止的领域里绝对无知。

“在防火墙内,人工智能首先必须是一个‘政治合格’的审查员,其次才是一个智能助手。这种‘智识阉割’导致了一个荒诞的结果:我们试图制造出超越人类的智能,却又害怕它拥有人类最基本的记忆与反思。”

正如相关评论所指出的,这种“思想钢印”不仅限制了AI的认知边界,更折射出权力对技术可能带来的失控风险的深深恐惧。AI的每一次“无法回答”,实际上都是系统在每一次历史真相面前的应激反应。

4月3日:“触发敏感词‘习近逼’。”

新皮肤 get

#每日一语 pic.twitter.com/1cDdUZbhxu

— 中国数字时代 (@CDTChinese) April 4, 2025

4月初,中国军方针对台海局势发布了一张名为《进逼》的演习海报,央视新闻等官媒账号进行了转发。意想不到的是,这一极具威慑力的宣传攻势,却在评论区遭遇了“回旋镖”。

有网民在央视新闻评论区留言“演习进逼,拿下台湾”,本意是附和官方的民族主义情绪。然而,该评论迅速导致发布者的账号被封禁。网民经过测试与分析发现,原因在于“演习进逼”四个字中,后三个字与中共最高领导人的名字组成了谐音“习近逼”。

这种看似偶然的误伤,实则是近年来涉及最高领导人审查红线不断下移且无限泛化的必然结果。

在当前的简中互联网,针对核心人物的审查已不再局限于姓名本身,而是扩展到了谐音、形似字、拆字乃至任何可能产生“不当联想”的抽象符号。

因此,敏感词监测系统的算法被赋予了宁可错杀一千、不可放过一个的极端权重。以至于,连官方“钦定”的宣传词汇,一旦落入“敏感词矩阵”的范围之内,也难逃被屏蔽的命运。

这一事件可以被视作是‘李佳琦悖论’的又一次精准预演。由于审查边界的极度不透明,一个人如果想完全不触犯禁忌,他就必须确切地知道所有的禁忌是什么。而为了知道所有的禁忌,他又必须了解那些被严厉封锁的信息。

最终,由于对‘避讳’学问的无知,连最忠诚的赞歌演唱者也会踩中地雷,成为审查制度无差别攻击的牺牲品。

当红色的宣传口号遇上红色的审查算法,结果是宣传者自己被消音。

6月14日:“全国食用煤油车就两台;湘雅医院就一个刘翔峰。”

#每日一语 pic.twitter.com/0rFvJ7GDJp

— 中国数字时代 (@CDTChinese) June 14, 2025

6月中旬,关于中南大学湘雅二医院研究生罗帅宇坠楼身亡后的举报内容引发网络震荡。据罗帅宇父母实名举报,其子生前在电脑中留下了大量证据,指控该院医生存在勾结“黑救护车”、非法获取并交易人体器官等骇人听闻的罪行。

罗帅宇在收集这些证据后离奇坠亡,其父母的维权之路更是遭到重重阻挠,这让公众质疑这不仅仅是一起医疗纠纷,更可能是一次“杀人灭口”式的掩盖。

公众的愤怒在于,这已不是“湘雅系”第一次爆出惊天丑闻。早在几年前,同院医生刘翔峰就因“找不到癌细胞就切除胰腺”的恶魔行径震惊全国。然而,当罗帅宇用生命试图揭开更深层的盖子时,官方的处理逻辑似乎依然停留在“切割”上。

“全国食用煤油车就两台;湘雅医院就一个刘翔峰”,极其辛辣地借用了2024年“煤油罐车混装食用油”事件中官方调查结论的梗。当年面对全行业的潜规则,调查组仅认定极少数车辆违规。可以说,网民用这种类比,表达了对官方“将系统性崩坏降格为孤立个案”的彻底不信。

如果说刘翔峰是“恶魔”,那么罗帅宇举报材料中揭示的则是一个“魔窟”。当房间里发现一只蟑螂时,暗处往往已经挤满了蟑螂。

可是,在官方的叙事里,永远只有一只蟑螂,和两辆油罐车。

信任的崩塌标志着“塔西佗陷阱”在医疗与食品安全领域的闭合。民众不再相信任何“个别现象”的解释,因为在他们眼中,每一次“个案”的定性,其实都是对系统性腐败的又一次包庇。

7月6日:“这么说吧,这要是拉了一车猪,人家早想办法了。”

猪都不如

#每日一语 pic.twitter.com/uQ9mT4UzJg

— 中国数字时代 (@CDTChinese) July 7, 2025

7月初,受强降雨影响,K1373次列车在江西境内滞留长达数十小时。由于机车断电,全封闭车厢内的空调系统彻底瘫痪,空气稀薄且温度飙升。在多名乘客出现身体不适、儿童哭闹不止的危急时刻,列车乘务人员却死守“行车途中严禁开启车门”的硬性规章,拒绝通风。最终,绝望的乘客被迫砸碎车窗玻璃,才争取到了呼吸的权利。

2024年4月1日起正式施行的《生猪运输管理技术要求》明白写着:只要运猪的车厢温度超过25℃,就必须加强通风降温。而到了人这里呢?

关于“生猪运输”的黑色幽默,虽然可能粗俗,却一针见血地指出了行政官僚体系内部的一套隐形算计。

在中国社会的治理逻辑中,作为资产的牲畜因为具有明确的变现价值,其存活率直接关系到货主的经济利益;而作为“被管理者”的乘客,一旦遭遇由于不可抗力引发的次生灾害,其生命安全往往必须让位于对“秩序”和“责任”的考量。

在列车员眼中,不开门是‘合规’,热死人是‘天灾’;而一旦开门导致有人跌落或秩序混乱,则是‘人祸’与‘事故’。这种宁可让活人憋死也不愿承担哪怕万分之一违规风险的免责逻辑,将封闭的车厢变成了一座移动的监狱。

关于该事件的讨论或许可以折射出个体在庞大国家机器面前被彻底物化的处境。正如文章所指出的,从“人矿”到“不如猪”,这种无奈的自嘲,背后是公众对自身紧急避险权长期遭到剥夺的深刻无力。

7月19日:“当年对日本核废水那股寻求真相、深究责任、不依不饶的劲呢?去哪了?”

“最后一突开啊…”

#每日一语 pic.twitter.com/w334UEKGHE

— 中国数字时代 (@CDTChinese) July 19, 2025

7月下旬,杭州主城区多地居民反映自来水出现类似“塑料味”、“化肥味”甚至“尸臭味”的异味。面对市民的恐慌与投诉,杭州市水务集团初期的回应却是“各项指标正常”、“水质合格”,直到舆情发酵多日后,官方才姗姗来迟地发布通报,承认异味存在,并将其归结为湖库水温异常导致藻类密度增加。

更令公众感到寒意的是,在水质真相尚未查明之时,针对言论的管控却先行一步。西湖分局迅速发布警情通报,对一名在网上称“水厂电缆掉进水里导致异味”的市民进行了行政处罚。

这种“只解决提出问题的人,不解决水质问题”的维稳惯性,激怒了众多网民。

有网友指出,“调查不影响查处”的逻辑就是一切要看大局,而事实及真相本身不重要。

上句说具体原因还要进一步调查,即还没有最后的结论;这一句就确定了“粪水”说法是谣言,而且已经查处。他们的逻辑就是:调查不影响查处。可以边调查,边查处;也可以后调查,先查处;甚至可以不调查,只查处。查处了就查处了,大不了到后来情况有变,给他个烈士,但查处本身还是没错。所以,在通报艺术中,逻辑是不太重要的。有一点固然好,如果没有也无所谓,要看大局。

微博用户发出的质问揭示出了官方宣传叙事中的巨大裂痕。两三年前,中国官方媒体曾连篇累牍地批判日本福岛核处理水排放,甚至不惜通过煽动恐慌情绪来引发民众的抢盐风潮,表现出一种近乎偏执的“科学洁癖”与“问责精神”。

“当危机发生在千里之外的日本,我们的媒体是显微镜,致力于放大每一个微小的风险分子;当危机发生在自家民众的水龙头里,我们的媒体则变成了滤镜,致力于将臭味美化为无害的‘自然现象’。”

可以说,在当下舆论场之中,爱国主义往往被用作一种注意力的转移支付。

8月9日:“一个从来不关心你的工作时间……的政府,却开始突然关心你工作有没有缴社保。”

不是你需要社保,是社保需要你。

#每日一语 pic.twitter.com/6uidr9Knnk

— 中国数字时代 (@CDTChinese) August 9, 2025

8月,伴随着延迟退休政策的风声鹤唳,中国各地税务部门开启了一场针对企业社保缴纳的“严查风暴”。在“金税四期”大数据的加持下,不仅是当下的漏缴,甚至连十年前的历史欠费也被要求一并清算。这一举措在经济寒冬中,让本就挣扎在生死线上的中小企业与打工人感受到了彻骨的寒意。

行政效率的突然提升,却让公众感到极度的错位与讽刺。长期以来,中国政府在落实《劳动法》方面表现得近乎隐形:

面对互联网大厂的“996”加班文化,面对遍地的拖欠工资现象,监管部门往往保持着“民不举官不究”的默契。然而,一旦涉及到填补社保基金亏空的征收环节,原本缺位的“守夜人”立刻摇身一变成了精明的“收税官”。

更令民众愤怒的,是至今仍未实质性打破的“养老金双轨制”。体制内的公务员与事业单位人员,长期享受着高额的退休金替代率(往往高达80%-90%),而企业职工的替代率却徘徊在40%左右。这种身份等级制的养老分配,让“强制缴费”变成了一种向体制内输血的劫贫济富。

“选择性关心”撕开了现代化中国的面纱。其实它并不关心作为劳动者的你是否过劳,只关心作为‘耗材’的你是否还能挤出最后的剩余价值。在财政吃紧,内需匮乏的当下,执法的目的不再是正义,而是汲取。

一个“汲取型政权”在经济下行周期的真实面目是清晰且明确的:在福利分配上是双轨的,但在压榨提取上却异常的高效。

11月17日:“为什么中国人到哪都不安全啊?”

“中国人到哪都不安全?”

#每日一语 pic.twitter.com/Jt4utfcUqD

— 中国数字时代 (@CDTChinese) November 17, 2025

11月中旬,随着冬季旅游旺季的临近,简中互联网上再次掀起一波“国外水深火热”的叙事高潮。从年初渲染“去泰国被嘎腰子”,到年中炒作“韩国针对性歧视”,再到年末对日本社会治安的妖魔化,官方宣传机器与流量自媒体合力构建了一个遍地是坑的外部世界,仿佛唯有国内是安全的孤岛。

与此同时,一种独特的亚文化现象在社交媒体平台X上蔓延。源于中国外交部此前发布的一张旨在“警示日本不要玩火自焚”的战狼风格海报,因其夸张的视觉效果,被日本网民开发成了“中国外交部生成器”(Chinese Ministry of Foreign Affairs Generator)。

原本严肃、充满攻击性的外交辞令背景,被全球网民填充进“不想上班”、“今天吃什么”等生活琐事或梗图。这种解构不仅消解了战狼外交的威慑力,更让原本意在煽动民族情绪的政治符号沦为了国际互联网上的笑料。

然而,对于墙内的普通民众而言,全方位的恐吓式宣传带来了深层的认知失调。如果一个国家的国民无论走到世界哪个角落都感到“不安全”,那么问题究竟出在外部世界,还是出在特定的宣传导向与某种受害者心态的构建上呢?

讽刺的是,恰恰是在这个被宣传为“最安全”的地方,我们看到了针对外国人乃至同胞的仇恨犯罪不断上演。”

11月28日:“我连当面道歉的机会都没有,就要亲手拆掉这个舞台。”

该道歉的另有其人…

#每日一语 pic.twitter.com/SIHIkNmeKG

— 中国数字时代 (@CDTChinese) November 29, 2025

11月底,日本天后滨崎步备受瞩目的上海演唱会在原定开演前夕突然宣布取消。尽管主办方给出的理由是惯用的“不可抗力”,但真正的阻力来自哪里,舆论心照不宣。“亲手拆掉这个舞台”,成为了中日民间交流在2025年最苍凉的年终注脚。

这可能并非一场单纯的演出事故,而是冰冷的地缘政治向文化领域蔓延的必然结果 。

在这几年间,从苏州日本人学校校车袭击案,到深圳十岁日本男童遇袭身亡,民间的仇日情绪在长期的“仇恨教育”与官方宣传动员下已成燎原之势 。

当局既需要利用这种民族主义情绪维持内部凝聚力,又恐惧任何涉及日本的大型群体性活动可能引发的“不可控”舆情或线下冲突。

于是,牺牲掉一场演唱会成为了维稳成本最低的选择。一边是外交辞令上空洞的“愿同日方加强交流”,另一边却是实体舞台的被迫拆除。这种精神分裂式的治理逻辑,让所谓的“中日友好”只停留在文件里。

我们或许可以说:那个被拆掉的舞台,象征着两国之间最后一点基于人性的、非政治的连接,也在高涨的敌意中轰然倒塌。